O que é o Prompting de Cadeia de Pensamento (CoT)?

Os modelos de linguagem de grande dimensão (LLM) demonstram capacidades notáveis no processamento e geração de linguagem natural (PNL). No entanto, quando confrontados com tarefas de raciocínio complexas, estes modelos podem ter dificuldade em produzir resultados exactos e fiáveis. É aqui que entra em jogo o estímulo da Cadeia de Pensamento (CoT), que oferece uma técnica poderosa para melhorar as capacidades de resolução de problemas dos LLMs.

- Compreender o estímulo da cadeia de pensamento

- A mecânica do estímulo da cadeia de pensamento

- Aplicações do estímulo à cadeia de pensamento

- Benefícios da implementação do CoT Prompting

- Limitações e considerações

- O ponto principal do CoT Prompting

- Perguntas frequentes (FAQ)

- 1. Como é que o estímulo de cadeia de pensamento melhora a precisão dos modelos linguísticos?

- 2. O estímulo da cadeia de pensamento pode ser utilizado para outras tarefas para além dos puzzles aritméticos e lógicos?

- Quais são os desafios mais comuns quando se implementa a sugestão de cadeia de pensamento?

- De que forma é que o Auto-CoT difere do tradicional estímulo da cadeia de pensamento?

- Há algum modelo linguístico específico que tenha um melhor desempenho com a solicitação de cadeia de raciocínio?

Compreender o estímulo da cadeia de pensamento

O estímulo da cadeia de pensamento é uma engenharia rápida técnica concebida para guiar os LLM através de um processo de raciocínio passo a passo. Ao contrário dos métodos normais de solicitação que visam respostas diretas, a solicitação CoT incentiva o modelo a gerar passos de raciocínio intermédios antes de chegar a uma resposta final. Esta abordagem imita os padrões de raciocínio humano, permitindo que os sistemas de IA lidem com tarefas complexas com maior precisão e transparência.

Na sua essência, a CoT envolve a estruturação de pedidos de entrada de forma a obter uma sequência lógica de pensamentos do modelo. Ao dividir problemas complexos em passos mais pequenos e manejáveis, a CoT permite que os LLMs naveguem por caminhos de raciocínio complexos de forma mais eficaz. Isto é particularmente importante em tarefas que requerem a resolução de problemas em várias etapas, tais como problemas matemáticos, desafios de raciocínio lógico e cenários complexos de tomada de decisão.

A evolução da indução da cadeia de pensamento no domínio da IA está intimamente ligada ao desenvolvimento de modelos de linguagem cada vez mais sofisticados. À medida que os LLM cresciam em tamanho e capacidade, os investigadores observaram que modelos de linguagem suficientemente grandes podiam exibir capacidades de raciocínio quando corretamente solicitados. Esta observação levou à formalização da CoT como uma técnica de estímulo distinta.

Inicialmente introduzido por investigadores da Google em 2022A técnica CoT ganhou rapidamente força na comunidade de IA. A técnica demonstrou melhorias significativas no desempenho do modelo em várias tarefas de raciocínio complexas, incluindo:

Raciocínio aritmético

Raciocínio de senso comum

Manipulação simbólica

Resposta a perguntas multi-hop

O que distingue a CoT de outras técnicas de engenharia rápida é o facto de se concentrar em gerar não apenas a resposta, mas todo o processo de pensamento que conduz a essa resposta. Esta abordagem oferece várias vantagens:

Melhoria da resolução de problemas: Ao dividir tarefas complexas em passos mais pequenos, os modelos podem resolver problemas que anteriormente estavam fora do seu alcance.

Melhoria da interpretabilidade: O processo de raciocínio passo-a-passo fornece informações sobre a forma como o modelo chega às suas conclusões, tornando a tomada de decisões da IA mais transparente.

Versatilidade: A CoT pode ser aplicada a uma vasta gama de tarefas e domínios, o que a torna uma ferramenta valiosa no conjunto de ferramentas da IA.

À medida que nos aprofundamos na mecânica e nas aplicações do estímulo da Cadeia de Pensamento, torna-se claro que esta técnica representa um salto significativo na nossa capacidade de aproveitar todo o potencial dos grandes modelos de linguagem para tarefas de raciocínio complexas.

A mecânica do estímulo da cadeia de pensamento

Vamos explorar a mecânica por detrás do estímulo CoT, os seus vários tipos e a forma como difere das técnicas de estímulo normais.

Como funciona o CoT

Na sua essência, a solicitação de CoT orienta os modelos linguísticos através de uma série de passos de raciocínio intermédios antes de chegar a uma resposta final. Este processo envolve normalmente:

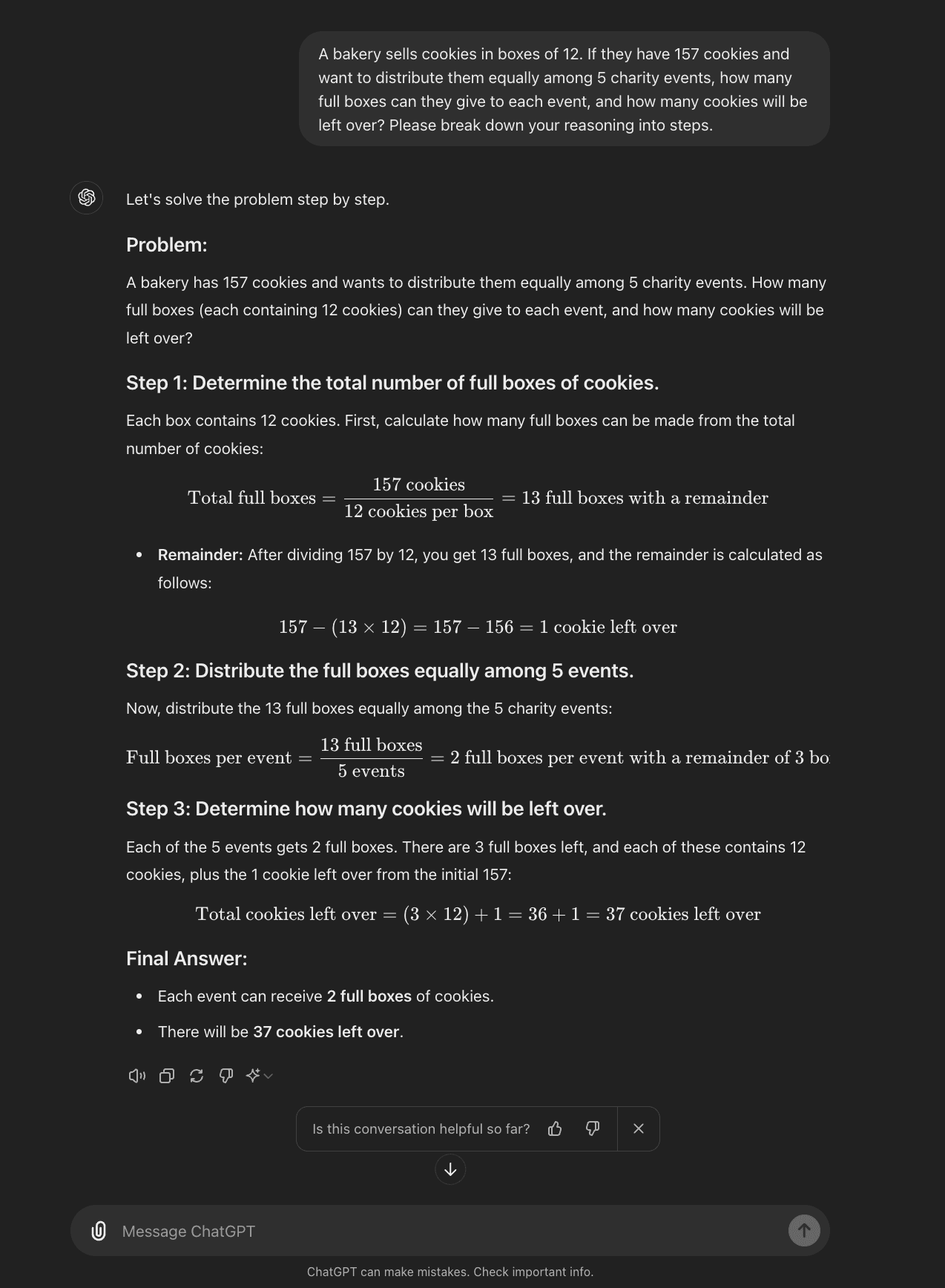

Decomposição de problemas: A tarefa complexa é dividida em etapas mais pequenas e fáceis de gerir.

Raciocínio passo a passo: O modelo é convidado a refletir explicitamente sobre cada etapa.

Progressão lógica: Cada passo baseia-se no anterior, criando uma cadeia de pensamentos.

Desenho de conclusão: A resposta final é obtida a partir das etapas de raciocínio acumuladas.

Ao encorajar o modelo a "mostrar o seu trabalho", o estímulo CoT ajuda a reduzir os erros que podem ocorrer quando um modelo tenta saltar diretamente para uma conclusão. Esta abordagem é particularmente eficaz para tarefas de raciocínio complexas que requerem vários passos lógicos ou a aplicação de conhecimentos específicos de um domínio.

Tipos de CoT Prompting

O estímulo da cadeia de pensamento pode ser implementado de várias formas, destacando-se dois tipos principais:

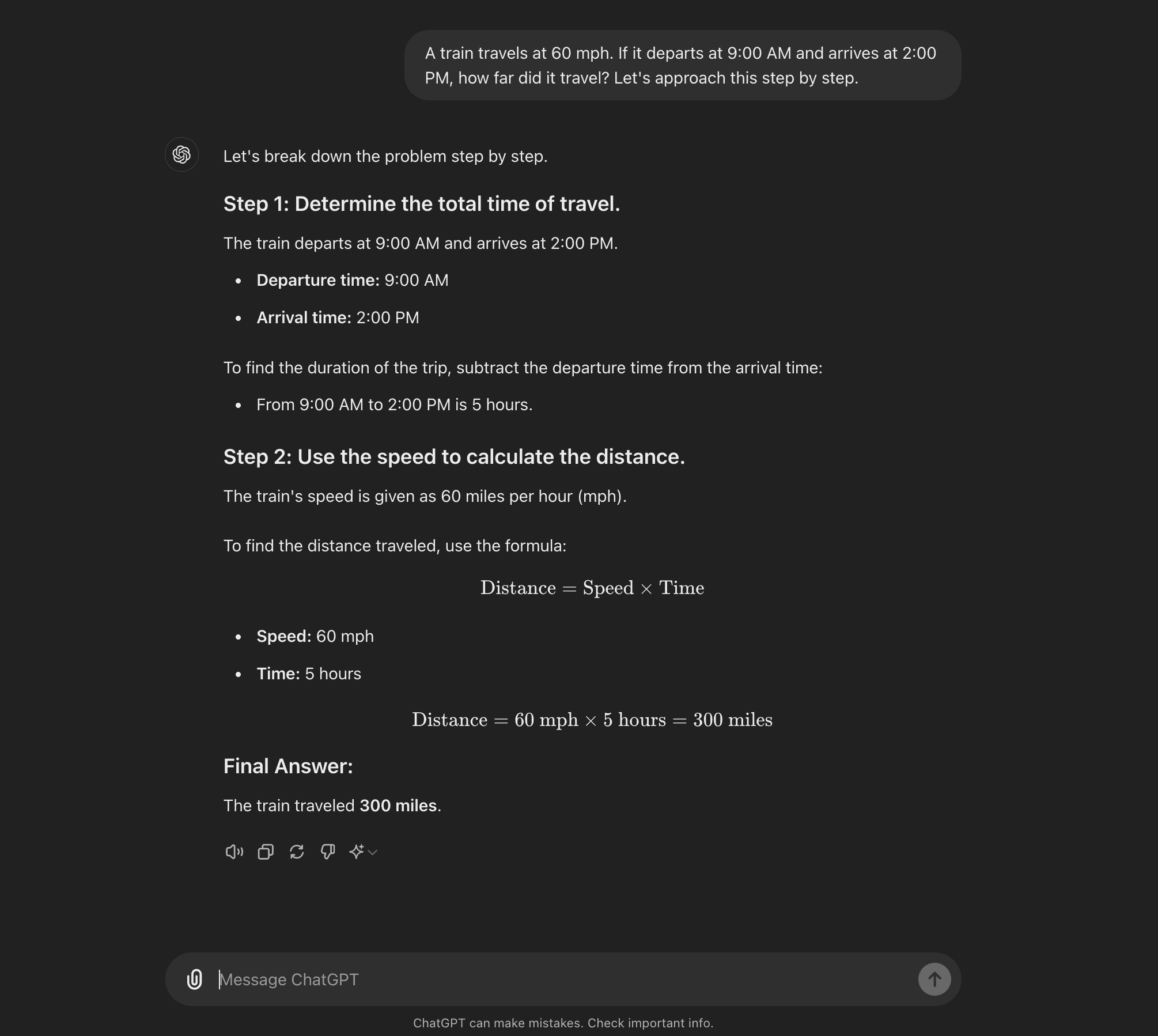

1. CoT de disparo zero

A CoT de disparo zero é uma variante poderosa que não requer exemplos específicos da tarefa. Em vez disso, utiliza um simples aviso como "Vamos abordar isto passo a passo" para incentivar o modelo a decompor o seu processo de raciocínio. Esta técnica demonstrou uma eficácia notável na melhoria do desempenho do modelo numa vasta gama de tarefas, sem necessidade de formação adicional ou de afinação.

Principais caraterísticas da CoT de disparo zero:

Não requer exemplos de tarefas específicas

Utiliza o conhecimento existente do modelo

Altamente versátil em diferentes tipos de problemas

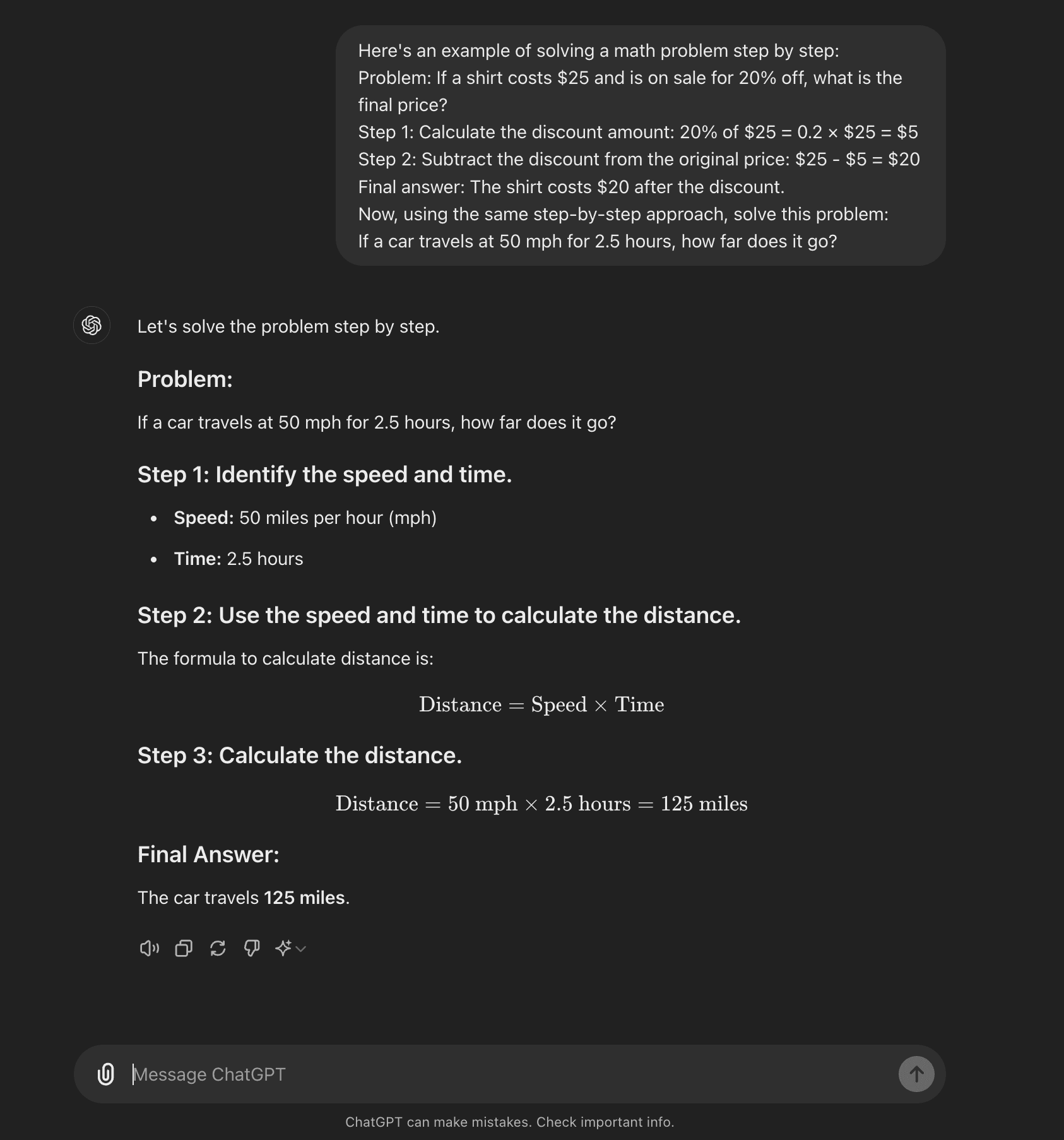

2. CoT de poucos disparos

A CoT de poucas oportunidades envolve fornecer ao modelo um pequeno número de exemplos que demonstram o processo de raciocínio desejado. Estes exemplos servem de modelo para o modelo seguir quando estiver a lidar com problemas novos e inéditos.

Caraterísticas do CoT de poucos disparos:

Fornece 1-5 exemplos do processo de raciocínio

Ajuda a orientar o padrão de pensamento do modelo de forma mais explícita

Pode ser adaptada a tipos específicos de problemas ou domínios

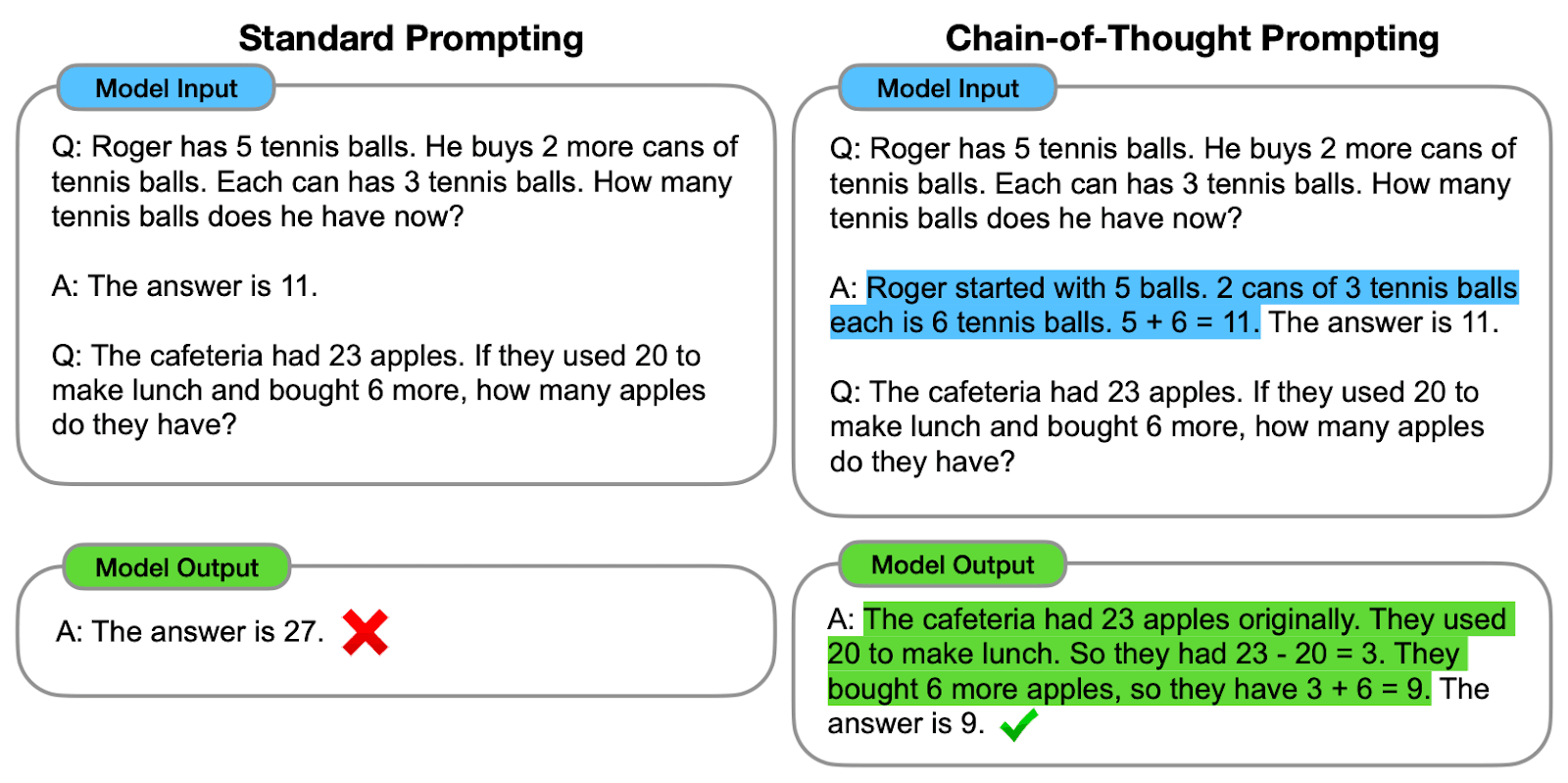

Comparação com técnicas de solicitação padrão

Para apreciar o valor do estímulo da Cadeia de Pensamento, é essencial compreender como é que ele difere das técnicas de estímulo padrão:

Transparência de raciocínio:

Prompting padrão: Muitas vezes resulta em respostas diretas sem explicação.

CoT Prompting: Gera etapas intermédias, fornecendo informações sobre o processo de raciocínio.

Tratamento de problemas complexos:

Prompting padrão: Pode ter dificuldades em tarefas de raciocínio complexo ou em várias etapas.

CoT Prompting: É excelente na decomposição e resolução sistemática de problemas complexos.

Deteção de erros:

Prompting padrão: Os erros de raciocínio podem ser difíceis de identificar.

CoT Prompting: Os erros são mais facilmente detectados no processo passo-a-passo.

Adaptabilidade:

Prompting padrão: Podem ser necessários avisos específicos para diferentes tipos de problemas.

CoT Prompting: Mais adaptável a vários domínios problemáticos com um mínimo de ajustamento imediato.

Raciocínio semelhante ao humano:

Prompting padrão: Produz frequentemente respostas diretas e semelhantes às de uma máquina.

CoT Prompting: Imita processos de pensamento semelhantes aos humanos, tornando os resultados mais relacionáveis e compreensíveis.

Ao tirar partido do poder dos passos de raciocínio intermédios, o prompting Chain-of-Thought permite que os modelos de linguagem lidem com tarefas complexas com maior precisão e transparência. Quer utilize abordagens de disparo zero ou de poucos disparos, a CoT representa um avanço significativo nas técnicas de engenharia de sugestões, alargando os limites do que é possível com grandes modelos de linguagem em cenários de raciocínio complexos.

Aplicações do estímulo à cadeia de pensamento

O CoT prompting provou ser uma técnica versátil com aplicações em vários domínios que requerem um raciocínio complexo. Vamos explorar algumas áreas-chave em que o CoT prompting se destaca:

Tarefas de raciocínio complexas

Os estímulos CoT destacam-se em cenários que exigem a resolução de problemas em várias etapas e a dedução lógica. Algumas aplicações notáveis incluem:

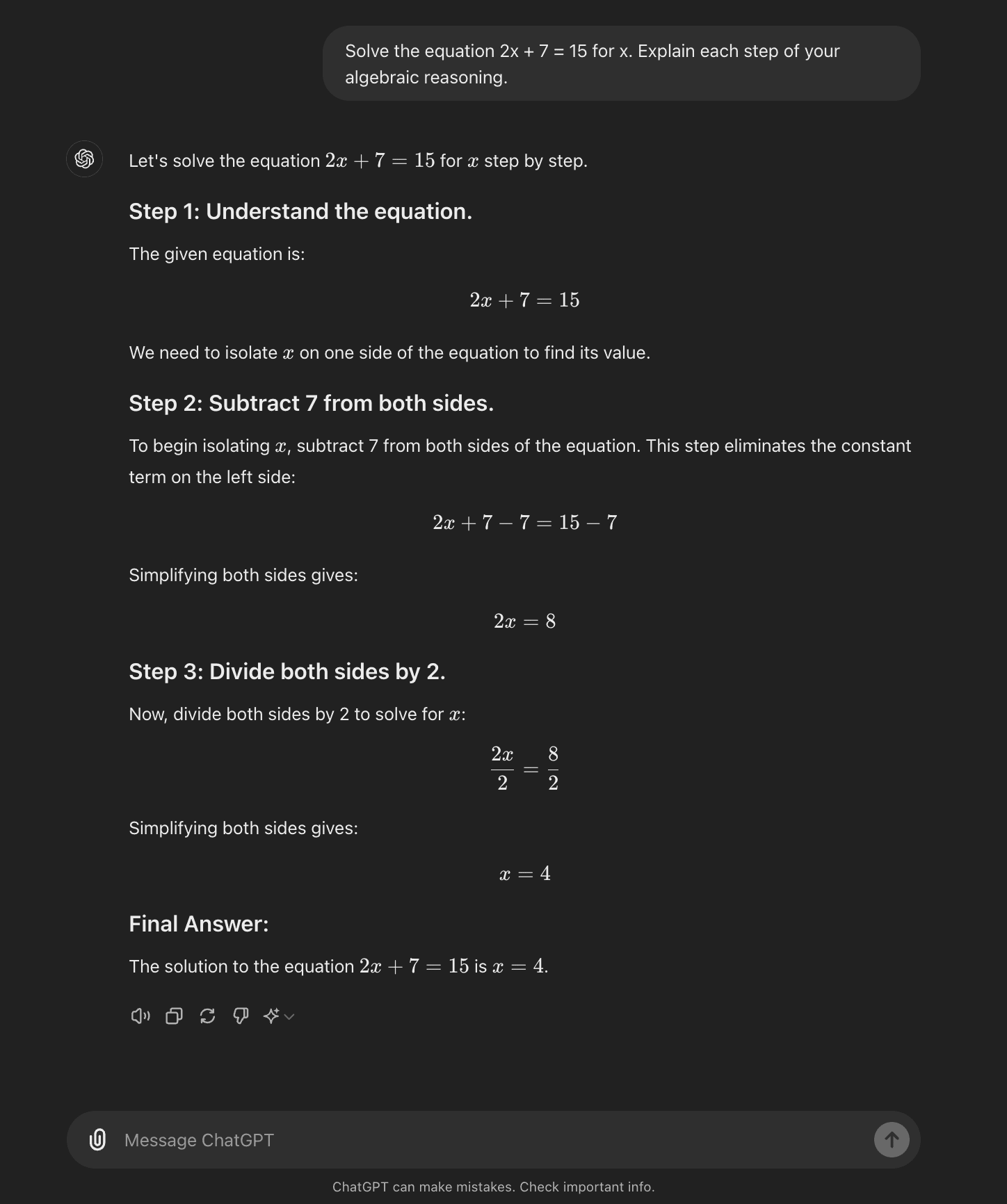

Problemas matemáticos de palavras: O CoT orienta os modelos através das etapas de interpretação do problema, identificação da informação relevante e aplicação das operações matemáticas adequadas.

Análise científica: Em domínios como a física ou a química, a CoT pode ajudar os modelos a decompor fenómenos complexos em princípios fundamentais e passos lógicos.

Planeamento estratégico: Para tarefas que envolvem múltiplas variáveis e consequências a longo prazo, o CoT permite que os modelos considerem sistematicamente vários factores.

Processo de Raciocínio Simbólico

As tarefas de raciocínio simbólico, que implicam a manipulação de símbolos e conceitos abstractos, beneficiam muito com o estímulo do CoT:

Álgebra e resolução de equações: O CoT ajuda os modelos a navegar pelas etapas de simplificação e resolução de equações.

Provas lógicas: Na lógica formal ou nas provas matemáticas, o CoT guia o modelo através de cada passo do argumento.

Reconhecimento de padrões: Para tarefas que envolvem padrões ou sequências complexas, o CoT permite que os modelos articulem as regras e relações que identificam.

Desafios do processamento de linguagem natural

A solicitação de CoT tem-se mostrado promissora na abordagem de alguns dos desafios mais matizados do processamento de linguagem natural:

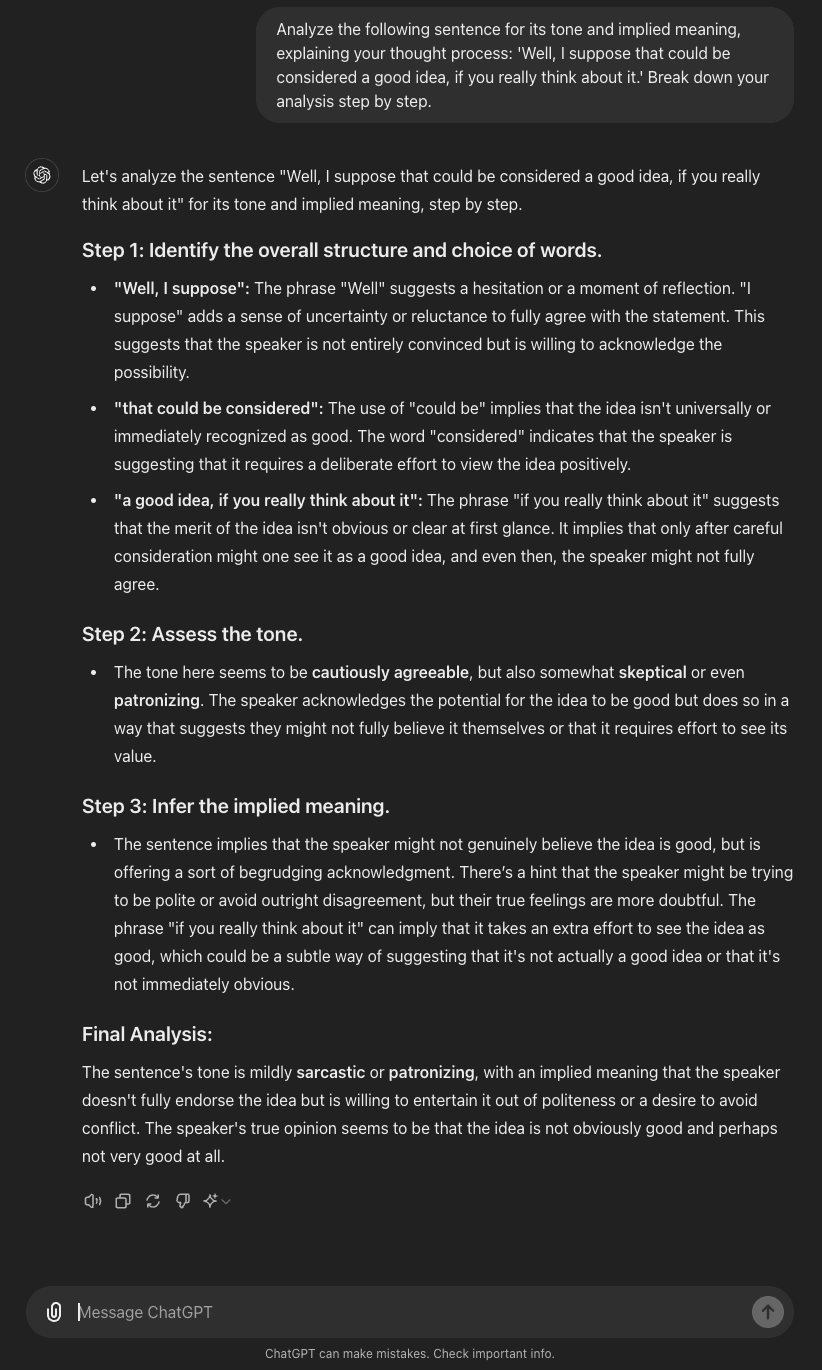

Raciocínio de senso comum: Ao dividir os cenários em passos lógicos, o CoT ajuda os modelos a fazer inferências com base em conhecimentos gerais sobre o mundo.

Sumarização de textos: O CoT pode orientar os modelos através do processo de identificação de pontos-chave, organização da informação e elaboração de resumos concisos.

Tradução de línguas: No caso de expressões complexas ou idiomáticas, o CoT pode ajudar os modelos a refletir sobre o significado e o contexto antes de fornecer uma tradução.

Benefícios da implementação do CoT Prompting

A adoção do prompting Chain-of-Thought oferece várias vantagens significativas que melhoram as capacidades dos modelos linguísticos de grande dimensão em tarefas de raciocínio complexas.

Uma das principais vantagens é maior precisão na resolução de problemas. Ao encorajar o raciocínio passo-a-passo, a solicitação de CoT conduz frequentemente a resultados mais exactos, especialmente em tarefas complexas. Esta melhoria resulta da redução da propagação de erros, uma vez que é menos provável que os erros se acumulem quando cada passo é explicitamente considerado. Além disso, o CoT promove a exploração abrangente do problema, orientando o modelo para considerar todos os aspectos relevantes antes de concluir.

Outra vantagem crucial é a maior interpretabilidade das decisões da IA. A solicitação de CoT aumenta significativamente a transparência dos processos de tomada de decisão da IA, fornecendo um caminho de raciocínio visível. Os utilizadores podem seguir o processo de raciocínio do modelo, obtendo informações sobre a forma como este chegou a uma determinada conclusão. Esta transparência não só facilita a depuração quando ocorrem erros, como também promove uma maior confiança nos sistemas de IA entre os utilizadores e as partes interessadas.

O CoT é particularmente excelente na abordagem de problemas de raciocínio em várias etapas. Em cenários que requerem uma série de passos lógicos, tais como árvores de decisão complexas ou tarefas de resolução de problemas sequenciais, CoT ajuda os modelos a navegar sistematicamente através de várias possibilidades. Para tarefas que se baseiam em resultados anteriores, o CoT garante que cada passo é cuidadosamente considerado e se baseia logicamente no último, conduzindo a resultados mais coerentes e fiáveis.

Limitações e considerações

Embora o estímulo da Cadeia de Pensamento ofereça inúmeros benefícios, é importante estar ciente das suas limitações e potenciais desafios para o utilizar eficazmente.

Uma limitação significativa é dependência de modelos. A eficácia das instruções CoT pode variar significativamente consoante o modelo linguístico subjacente. De um modo geral, o CoT tende a funcionar melhor com modelos linguísticos suficientemente grandes que tenham capacidade para raciocínios complexos. Os dados de pré-treino do modelo também podem afetar a sua capacidade de gerar cadeias de pensamento significativas em domínios específicos. Isto significa que o sucesso do estímulo CoT está intimamente ligado às capacidades e à formação do modelo linguístico que está a ser utilizado.

Engenharia rápida apresenta outro desafio na implementação das CoT. A elaboração de instruções de CoT eficazes requer competências e envolve frequentemente tentativa e erro. Os guiões devem fornecer orientações suficientes sem serem demasiado prescritivos, e a criação de guiões eficazes para áreas especializadas pode exigir conhecimentos especializados. Manter a coerência ao longo da cadeia de pensamento pode ser um desafio, especialmente para tarefas de raciocínio mais complexas.

Também vale a pena referir que a solicitação de CoT nem sempre é a abordagem ideal. Para tarefas simples, pode introduzir complexidade desnecessária e sobrecarga computacional. Existe também o risco de explicação excessivaO processo de raciocínio detalhado pode obscurecer a resposta direta que o utilizador procura. Além disso, uma cadeia de pensamento coerente não garante uma conclusão correta, podendo levar a excesso de confiança em resultados incorrectos.

O ponto principal do CoT Prompting

A solicitação Chain-of-Thought representa um avanço significativo nas técnicas de engenharia de solicitação, ultrapassando os limites do que é possível com grandes modelos de linguagem. Ao permitir processos de raciocínio passo-a-passo, a CoT melhora a capacidade dos sistemas de IA para lidar com tarefas de raciocínio complexas, desde o raciocínio simbólico até aos desafios do processamento de linguagem natural. Embora ofereça uma maior precisão, uma melhor interpretabilidade e a capacidade de lidar com problemas de várias etapas, é crucial considerar as suas limitações, como a dependência do modelo e os desafios da engenharia de prontidão.

À medida que a IA continua a evoluir, a solicitação de CoT é uma ferramenta poderosa para desbloquear todo o potencial dos modelos linguísticos, fazendo a ponte entre a computação automática e o raciocínio humano. O seu impacto em domínios que exigem a resolução de problemas complexos é crucial, abrindo caminho a aplicações de IA mais sofisticadas e transparentes em vários domínios.

Perguntas frequentes (FAQ)

1. Como é que o estímulo de cadeia de pensamento melhora a precisão dos modelos linguísticos?

Incentiva os modelos a decompor problemas complexos em etapas, reduzindo os erros e melhorando o raciocínio lógico. Esta abordagem passo a passo permite um melhor tratamento de tarefas multifacetadas.

2. O estímulo da cadeia de pensamento pode ser utilizado para outras tarefas para além dos puzzles aritméticos e lógicos?

Sim, é aplicável a uma vasta gama de tarefas, incluindo o processamento de linguagem natural, cenários de tomada de decisão e raciocínio científico. Qualquer tarefa que exija um pensamento estruturado pode beneficiar dos estímulos CoT.

Quais são os desafios mais comuns quando se implementa a sugestão de cadeia de pensamento?

Entre os principais desafios contam-se a elaboração de sugestões eficazes, a garantia de coerência ao longo de toda a cadeia de raciocínio e o tratamento de requisitos computacionais acrescidos. Também requer uma análise cuidadosa das capacidades e limitações do modelo.

De que forma é que o Auto-CoT difere do tradicional estímulo da cadeia de pensamento?

O Auto-CoT automatiza o processo de geração de passos de raciocínio, reduzindo a necessidade de engenharia manual de avisos. Utiliza técnicas de agrupamento e amostragem para criar automaticamente avisos diversos e específicos para cada tarefa.

Há algum modelo linguístico específico que tenha um melhor desempenho com a solicitação de cadeia de raciocínio?

Em geral, os modelos de linguagem maiores, como o GPT-4 e o Claude, apresentam um melhor desempenho com a solicitação CoT. Os modelos com pré-treino extensivo em diversos domínios tendem a beneficiar mais desta técnica.