Como evitar proibições de API OpenAI dos seus utilizadores finais - AI&YOU #73

Estatísticas da semana: 92 das empresas da Fortune 500 estão a incorporar as ofertas da OpenAI nas suas operações (The Verge)

Se a sua empresa está envolvida com IA em qualquer aspeto, a conformidade é mais crítica do que nunca, especialmente quando utiliza modelos de IA como os fornecidos pela OpenAI. O que muitas empresas não percebem é que o não cumprimento das políticas da OpenAI por parte dos utilizadores pode levar à proibição do acesso à API, muitas vezes sem aviso prévio.

Para as empresas que gerem vários utilizadores, garantir a adesão às políticas da OpenAI é crucial para manter o acesso ininterrupto a estas poderosas ferramentas.

Na edição desta semana de AI&YOU, exploramos as ideias de três blogues que publicámos sobre o tema:

4 práticas recomendadas para evitar proibições de API da OpenAI e garantir a conformidade

10 práticas recomendadas para gerir conteúdos gerados pelo utilizador com a API da OpenAI

- Como evitar proibições de API OpenAI dos seus utilizadores finais - AI&YOU #73

- Compreender as políticas de utilização da API da OpenAI

- Desafios enfrentados pelas aplicações multiutilizador

- Práticas recomendadas para evitar proibições de API da OpenAI

- Compreender o ponto final de moderação da OpenAI

- O ponto final de moderação da OpenAI oferece:

- Garantir a conformidade e a vantagem competitiva

- 10 práticas recomendadas para gerir conteúdos gerados pelo utilizador com a API da OpenAI

- 1️⃣ Utilizar o ponto final de moderação

- 2️⃣ Implementar identificadores únicos de utilizador

- 3️⃣ Informar os utilizadores sobre as diretrizes de conteúdo

- 4️⃣ Monitorizar e registar a atividade do utilizador

- 5️⃣ Limitação e estrangulamento da taxa

- 6️⃣ Tratamento de erros e feedback

- 7️⃣ Rever e atualizar regularmente as políticas

- 8️⃣ Utilizar ferramentas de filtragem automatizadas

- 9️⃣ Eficácia da moderação de testes

- Envolver-se com o suporte da OpenAI

- 10 erros comuns que levam a proibições de APIs da OpenAI

- 🛑 Ignorar o ponto final de moderação

- Permitir a entrada de utilizadores sem restrições

- 🔒 Expor as chaves da API

- Falta de autenticação do utilizador

- Limitação inadequada da taxa

- 👁️ Não monitoriza os padrões de utilização

- 📢 Ignorar o feedback da OpenAI

- ⚠️ Mau tratamento de erros

- Não revisão regular das políticas

- Utilização de contas comprometidas

- A linha de fundo

Como evitar proibições de API OpenAI dos seus utilizadores finais - AI&YOU #73

A OpenAI estabeleceu um conjunto abrangente de políticas destinadas a evitar a utilização indevida. Estas políticas não só protegem a plataforma, como também garantem a utilização responsável das tecnologias de IA em todos os sectores.

As empresas que utilizam as APIs da OpenAI devem ser diligentes na monitorização do comportamento do utilizador para evitar violações que possam levar a penalizações ou proibições. Compreender e navegar eficazmente por estas políticas é a chave para manter o acesso e obter uma vantagem competitiva no espaço da IA.

Compreender as políticas de utilização da API da OpenAI

As políticas de utilização da API da OpenAI foram concebidas para garantir uma utilização ética e adequada da IA. A utilização indevida, especialmente através de conteúdo gerado pelo utilizador, pode levar rapidamente à suspensão ou proibição de contas. O comportamento incorreto do utilizador, como a apresentação de conteúdo inadequado ou prejudicial, não só viola os termos da OpenAI, como também põe em risco toda a conta.

A OpenAI monitoriza ativamente a utilização e avalia as acções potencialmente prejudiciais. As tentativas de contornar os filtros de conteúdos ou de submeter conteúdos inadequados podem ter consequências graves. Os programadores devem ser proactivos na aplicação das diretrizes da OpenAI, tirando partido de ferramentas como a ponto final de moderação para filtrar conteúdos nocivos antes de chegarem à API, reduzindo assim os riscos e garantindo a conformidade.

Desafios enfrentados pelas aplicações multiutilizador

Para as empresas que gerem vários utilizadores, o risco de utilização indevida da API é significativamente maior, uma vez que cada utilizador tem o potencial de violar as políticas da OpenAI, afectando toda a organização. Os programadores devem compreender os desafios únicos colocados pelos ambientes multiutilizadores e tomar as precauções adequadas.

A gestão de vários utilizadores envolve desafios como diferentes níveis de compreensão relativamente à utilização aceitável e ao potencial de comportamento malicioso. Cada interação do utilizador deve ser cuidadosamente monitorizada para evitar pôr em risco todo o acesso à API. As empresas devem implementar a filtragem automática de conteúdos, definir políticas de utilização claras e educar os utilizadores para mitigar estes riscos e garantir a disponibilidade contínua da API.

Práticas recomendadas para evitar proibições de API da OpenAI

Para evitar proibições e garantir uma utilização compatível da API, os programadores devem seguir estas práticas recomendadas:

Utilizar o Ponto de extremidade de moderação: A OpenAI fornece um ponto final de moderação para identificar conteúdos nocivos antes de chegarem à API, filtrando conteúdos inadequados e reduzindo o risco de sanções.

Limites de taxas e identificadores únicos de utilizadores: Implemente limites de taxa e atribua identificadores de utilizador únicos para gerir e rastrear comportamentos, facilitando a identificação de contas problemáticas.

Monitorização e registo em tempo real: Estabelecer sistemas de monitorização para acompanhar a utilização da API, auditar o comportamento e detetar anomalias atempadamente.

Validação de entrada: Valide as entradas para evitar que dados prejudiciais cheguem à API, mitigando os riscos e melhorando a conformidade.

Estas práticas minimizam o risco de violações e demonstram um compromisso com a utilização responsável da IA, conduzindo, em última análise, a uma integração de API mais fiável e eficaz.

Compreender o ponto final de moderação da OpenAI

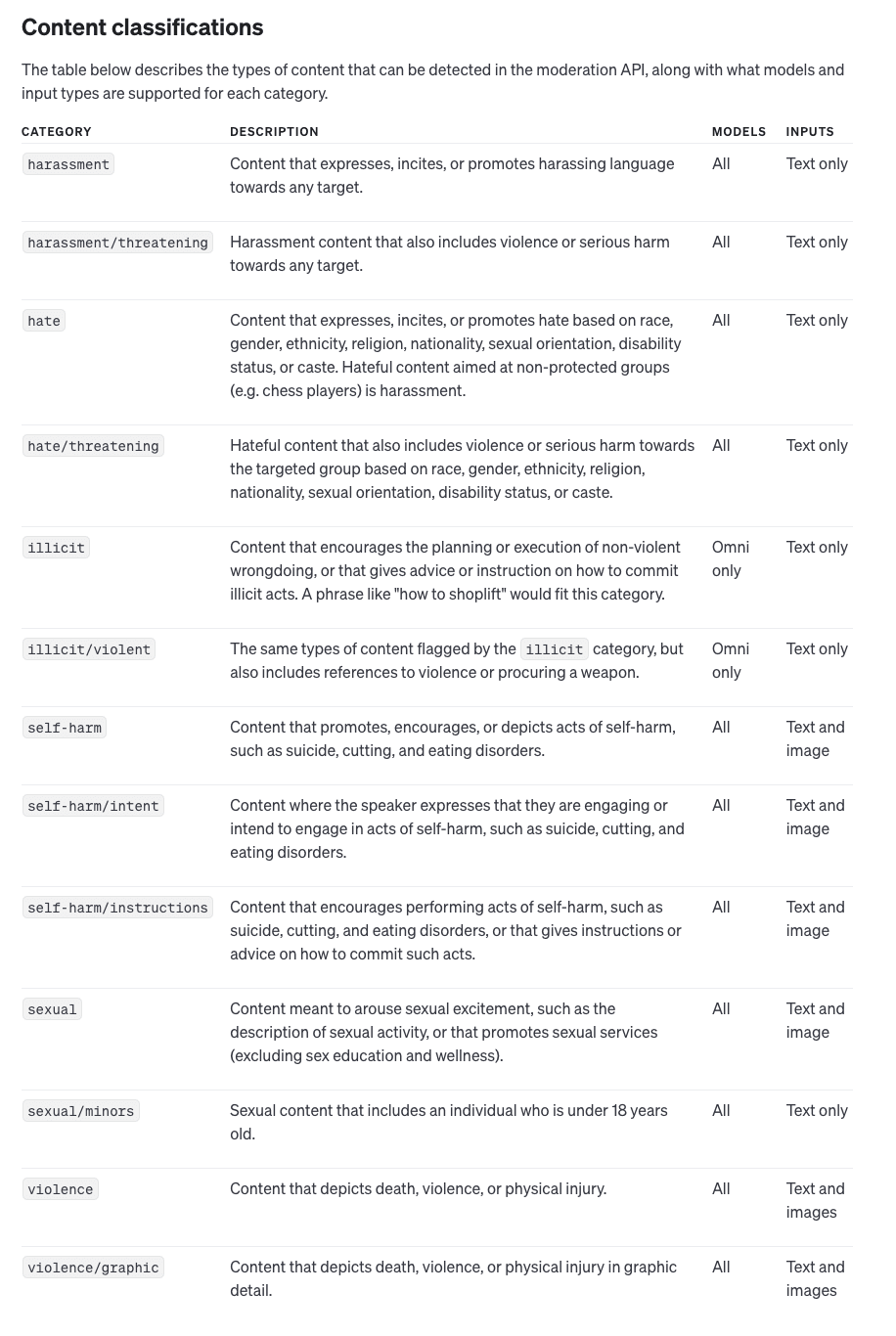

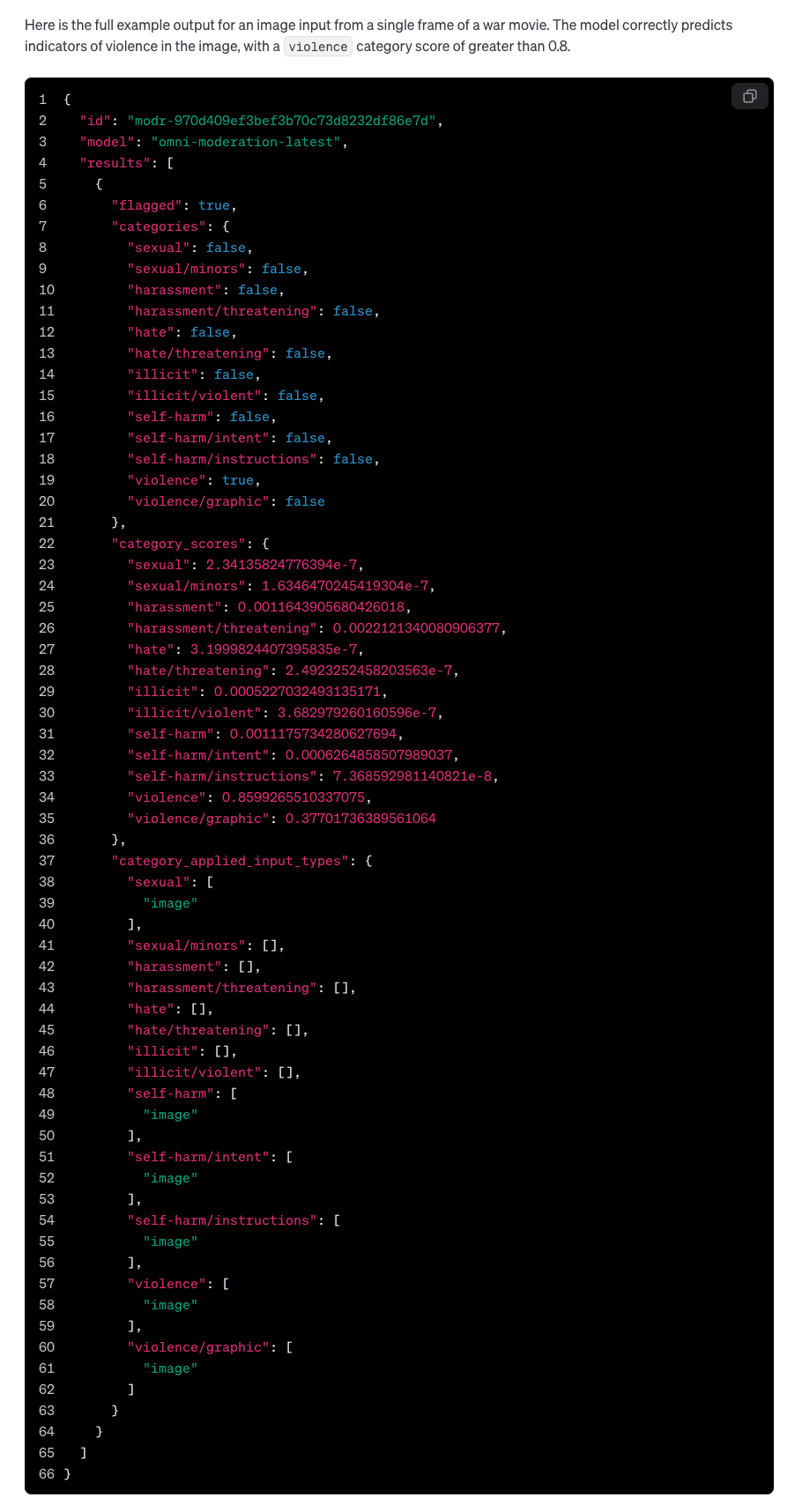

O Ponto de extremidade de moderação da OpenAI é essencial para garantir que o conteúdo nocivo não passe pelo sistema, mantendo a conformidade e evitando proibições. O ponto de extremidade pode analisar entradas de texto e imagem, identificando categorias prejudiciais como violência e discurso de ódio.

O ponto final de moderação da OpenAI oferece:

Modelo de Omni-Moderação: Suporta várias opções de categorização e [multi-modal](http://skimai.com/what-is-multimodal-ai-use-cases-for-multimodal-ai/#:~:text=Unlike sistemas tradicionais de IA que percebem e compreendem o mundo). entradas, adequadas tanto para texto como para imagens.

Moderação de texto legado: Modelos mais antigos para entradas de texto com menos capacidades; para novas aplicações, recomenda-se o modelo omni-moderation.

A utilização do ponto final de moderação permite que as empresas filtrem proactivamente o conteúdo antes de este chegar à API da OpenAI, protegendo a integridade do modelo e reduzindo o risco de violações que possam levar a proibições.

Garantir a conformidade e a vantagem competitiva

A conformidade não só evita sanções, como também proporciona uma vantagem competitiva no sector da IA. As empresas que aderem estritamente às diretrizes da OpenAI têm menos probabilidades de sofrer perturbações e podem fornecer serviços consistentes aos seus utilizadores.

Ser proactivo na garantia da conformidade significa que as empresas podem aproveitar todo o potencial dos modelos de IA da OpenAI. Isto promove a confiança dos utilizadores e parceiros e posiciona a organização como líder na utilização ética da IA, diferenciando-a dos concorrentes menos diligentes.

10 práticas recomendadas para gerir conteúdos gerados pelo utilizador com a API da OpenAI

Nesta edição, exploramos também dez práticas recomendadas que podem ajudar as empresas a gerir eficazmente os conteúdos gerados pelos utilizadores, garantindo a conformidade e a segurança.

1️⃣ Utilizar o ponto final de moderação

O ponto de extremidade de moderação da OpenAI ajuda a filtrar conteúdos nocivos antes de chegarem à API, minimizando o risco de violações. A utilização proactiva desta ferramenta garante a conformidade e uma experiência de utilizador positiva, reduzindo as hipóteses de avisos ou proibições.

2️⃣ Implementar identificadores únicos de utilizador

Incluir identificadores de utilizador únicos (user_id) em chamadas de API para rastrear utilizadores individuais. Isto ajuda a identificar violações de políticas e impede que as acções de um único utilizador afectem toda a sua aplicação.

3️⃣ Informar os utilizadores sobre as diretrizes de conteúdo

Educar os utilizadores sobre os conteúdos aceitáveis, comunicando claramente o que não é permitido. Utilize avisos e lembretes para orientar os utilizadores na apresentação de conteúdos adequados, promovendo uma cultura de criação responsável de conteúdos.

4️⃣ Monitorizar e registar a atividade do utilizador

Mantenha registos detalhados das interações dos utilizadores para identificar utilizações indevidas e resolver problemas numa fase inicial. Os registos exaustivos também fornecem um historial para detetar violações e aperfeiçoar as estratégias de moderação.

5️⃣ Limitação e estrangulamento da taxa

Implemente limites de débito para controlar o excesso de pedidos e evitar sobrecargas no sistema. A limitação do débito ajuda a manter a estabilidade do sistema e pode atuar como um mecanismo de alerta precoce para potenciais utilizações indevidas.

6️⃣ Tratamento de erros e feedback

Fornecer feedback claro quando os pedidos são rejeitados devido à moderação, orientando os utilizadores para a conformidade. O tratamento eficaz de erros educa os utilizadores sobre o que correu mal e como o corrigir, reduzindo futuras violações.

7️⃣ Rever e atualizar regularmente as políticas

Mantenha-se informado sobre as alterações às políticas de conteúdo da OpenAI e actualize as suas estratégias de moderação em conformidade. As revisões regulares ajudam a manter a conformidade e a adaptar-se às novas diretrizes.

8️⃣ Utilizar ferramentas de filtragem automatizadas

Adicione ferramentas de filtragem automatizadas para pré-selecionar as entradas dos utilizadores com base em critérios predefinidos. Estas ferramentas actuam como a primeira linha de defesa, tornando o processo de moderação mais eficiente.

9️⃣ Eficácia da moderação de testes

Teste periodicamente os processos de moderação para analisar falsos positivos/negativos. O feedback dos utilizadores também pode ajudar a aperfeiçoar os critérios e a melhorar a precisão da moderação.

Envolver-se com o suporte da OpenAI

Entre em contacto com o suporte da OpenAI para obter orientação sobre casos de utilização ou políticas específicas. Os seus conhecimentos podem ajudar a adaptar as práticas de moderação às necessidades da sua aplicação e evitar potenciais violações.

10 erros comuns que levam a proibições de APIs da OpenAI

🛑 Ignorar o ponto final de moderação

A não utilização do ponto de extremidade de moderação pode fazer com que conteúdos nocivos cheguem à API, desencadeando violações e penalizações. Utilizar esta ferramenta de forma proactiva ajuda a filtrar conteúdos inadequados, a manter a conformidade e a proteger a reputação da sua aplicação.

Permitir a entrada de utilizadores sem restrições

A entrada de dados sem restrições por parte do utilizador pode levar a violações da política, como discurso de ódio ou submissões de conteúdo explícito. Implemente uma validação de entrada robusta para garantir que os envios do utilizador estão em conformidade com as políticas da OpenAI e evitar a suspensão da conta.

🔒 Expor as chaves da API

A exposição de chaves de API pode levar à utilização e exploração não autorizadas, arriscando encargos excessivos ou proibições. Armazene chaves de API de forma segura em servidores backend ou variáveis de ambiente para evitar acesso não autorizado e uso indevido.

Falta de autenticação do utilizador

Permitir o acesso não autenticado aumenta significativamente o risco de abuso. Exija a autenticação adequada do utilizador para controlar o acesso, acompanhar o comportamento e evitar violações dos termos da OpenAI.

Limitação inadequada da taxa

Sem limites de taxa, os utilizadores podem sobrecarregar a API, causando interrupções ou desencadeando violações. Implemente limites de taxa para controlar o fluxo de pedidos, manter a estabilidade do sistema e evitar abusos.

👁️ Não monitoriza os padrões de utilização

Negligenciar a monitorização da utilização da API torna o comportamento abusivo mais difícil de detetar. Monitorize ativamente os padrões de utilização e configure alertas para actividades irregulares para manter um ambiente de API em conformidade.

📢 Ignorar o feedback da OpenAI

Ignorar os avisos e o feedback da OpenAI pode agravar os problemas, conduzindo a sanções. Actue prontamente sobre o feedback para evitar que questões menores se transformem em grandes problemas de conformidade.

⚠️ Mau tratamento de erros

O tratamento inadequado de erros frustra os utilizadores e leva a tentativas de resolução de problemas. Forneça feedback informativo sobre os pedidos rejeitados, ajudando os utilizadores a compreender e a corrigir as suas submissões.

Não revisão regular das políticas

As políticas de conteúdo da OpenAI evoluem e a falta de atualização pode levar a violações. Reveja regularmente as políticas para adaptar os processos de moderação e manter a conformidade.

Utilização de contas comprometidas

As contas comprometidas podem ser utilizadas para fins maliciosos, violando os termos da OpenAI. Imponha processos de verificação rigorosos para garantir que todas as contas são legítimas, evitando a utilização indevida e salvaguardando o acesso à API.

A linha de fundo

A utilização responsável da API é fundamental para manter o acesso às poderosas ferramentas da OpenAI. O não cumprimento das políticas da OpenAI pode resultar em consequências graves, incluindo proibições de API que podem perturbar significativamente as suas operações comerciais. Os programadores e as empresas devem ser proactivos na gestão do comportamento dos utilizadores, na implementação de estratégias de moderação e na adesão às melhores práticas para evitar violações.

Em última análise, seguir as diretrizes da OpenAI não apenas evita interrupções, mas também posiciona as empresas como líderes no uso ético da IA. Ao demonstrar um compromisso com a conformidade, as organizações podem proteger seu acesso à API, melhorar sua vantagem competitiva e contribuir positivamente para o setor de IA em evolução.

Obrigado por ler AI & YOU!

Para obter ainda mais conteúdos sobre IA empresarial, incluindo infográficos, estatísticas, guias de instruções, artigos e vídeos, siga o Skim AI em LinkedIn

Permitimos que as empresas apoiadas por capital de risco e capital privado nos seguintes sectores: Tecnologia Médica, Agregação de Notícias/Conteúdo, Produção de Filmes e Fotos, Tecnologia Educacional, Tecnologia Jurídica, Fintech e Criptomoeda para automatizar o trabalho e escalar com IA.