LLMの費用を削減する10の実証済みの戦略

顧客サービスのチャットボットからコンテンツ生成まで、さまざまな用途で大規模言語モデル(LLM)への依存が高まる中、LLMのコスト管理という課題が最前線に浮上しています。LLMの導入と維持に関連する運用コストは、適切な監視と最適化戦略がなければ、すぐに制御不能に陥る可能性があります。予期せぬコストの高騰は予算を狂わせ、こうした強力なツールの普及を妨げる可能性がある。

このブログでは、企業がLLMのコストを効果的に管理するための10の実証済みの戦略を紹介し、コスト効率と経費管理を維持しながら、これらのモデルの可能性を最大限に活用できるようにします。

戦略1:スマートなモデル選択

LLMのコスト管理で最も効果的な戦略のひとつは、それぞれのタスクに適したモデルを選択することです。すべてのアプリケーションが、利用可能な最も高度で最大のモデルを必要とするわけではありません。モデルの複雑さをタスクの要件に合わせることで、パフォーマンスを犠牲にすることなくコストを大幅に削減することができます。

LLMアプリケーションを実装する場合、各タスクの複雑さを評価し、その特定のニーズを満たすモデルを選択することが極めて重要です。例えば、単純な分類タスクや基本的な質問応答では、GPT-4oやその他の大規模でリソース集約的なモデルの全機能は必要ないかもしれません。

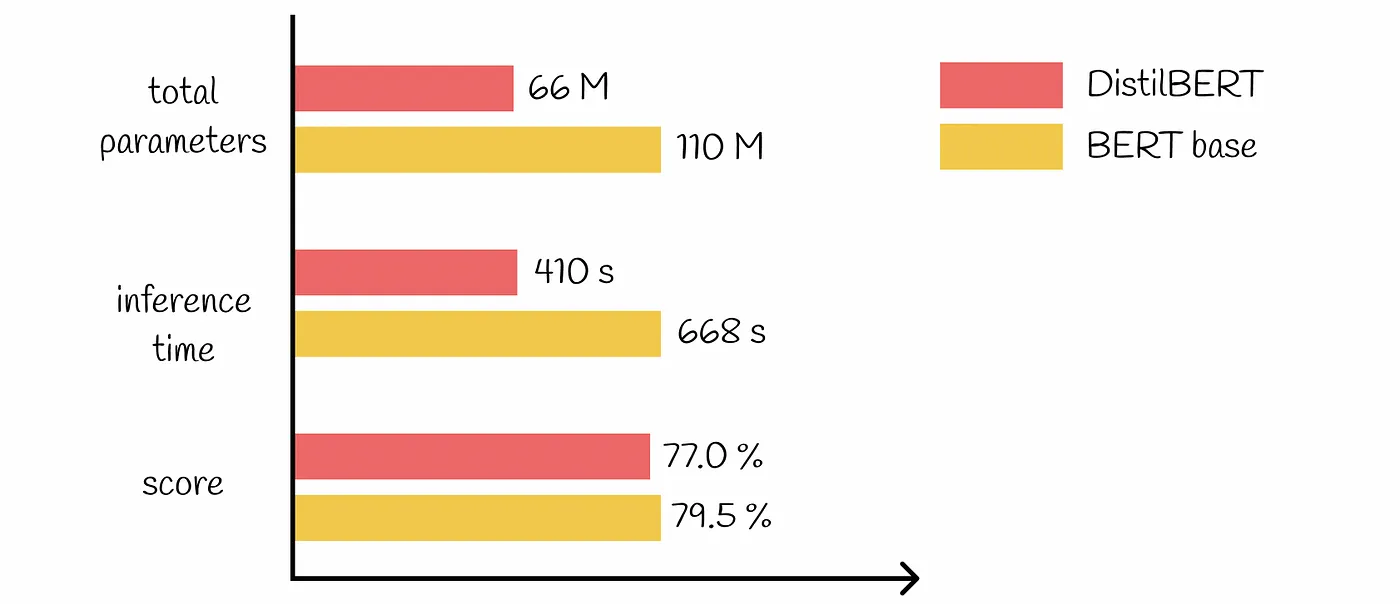

多くの訓練済みモデルが、様々なサイズと複雑さで利用可能です。単純なタスクには、より小さく効率的なモデルを選択することで、大幅なコスト削減につながります。例えば、次のような軽量モデルを使うことができます。 ディスティルバート のような複雑なモデルではなく、センチメント分析のためのものである。 バート・ラージ.

戦略2:堅牢な利用状況追跡の導入

効果的なLLMコスト管理は、これらのモデルが組織全体でどのように使用されているかを明確に理解することから始まる。非効率な領域や最適化の機会を特定するためには、強固な利用追跡メカニズムを導入することが不可欠である。

総合的な視野を得るために LLMの利用複数のレベルで指標を追跡することが重要である:

会話レベル: トークンの使用状況、応答時間、個々のインタラクションのモデルコールを監視します。

ユーザーレベル: 異なるユーザーや部署間でのモデルの使用パターンを分析する。

会社のレベル データを集計し、LLM全体の消費量と傾向を把握する。

LLMの利用状況を効率的に把握するためのツールやプラットフォームがいくつかあります。以下のようなものがある:

LLMサービスプロバイダーが提供する内蔵分析ダッシュボード

AIおよびMLアプリケーション専用に設計されたサードパーティ製監視ツール

既存のインフラと統合されたカスタムメイドのトラッキングソリューション

使用データを分析することで、コスト削減戦略につながる貴重な洞察を発見することができます。例えば、特定の部門が、より低コストの代替ツールで処理できるタスクに対して、より高価なモデルを過剰に使用していることを発見するかもしれません。また、キャッシュやその他の最適化技術によって対処できる冗長なクエリのパターンを特定できるかもしれません。

戦略3:プロンプト・エンジニアリングの最適化

迅速なエンジニアリング はLLMを使用する上で非常に重要な要素であり、パフォーマンスとコストの両方に大きな影響を与えます。プロンプトを最適化することで、トークンの使用量を減らし、LLMアプリケーションの効率を向上させることができます。

APIコールの回数を最小限に抑え、関連コストを削減する:

プロンプトには明確で具体的な指示を使う

LLMクエリを追加することなく、一般的な問題に対処するためのエラー処理を実装する。

特定のタスクに効果的であることが証明されているプロンプト・テンプレートを活用する

プロンプトをどのように構成するかによって、モデルによって処理されるトークンの数が大きく変わります。ベストプラクティスをいくつか紹介します:

簡潔であること、不必要な文脈を避けること

箇条書きや番号付きリストなどの書式テクニックを使って、情報を効率的に整理する

LLMサービスが提供する組み込み関数やパラメータを活用して、出力の長さや形式を制御する。

これらの迅速な最適化テクニックを実装することにより、トークンの使用量を大幅に削減し、その結果、LLMアプリケーションに関連するコストを削減することができます。

戦略4:専門化のための微調整の活用

LLMのコスト管理では、事前に訓練されたモデルを特定のタスクに合わせて微調整することが強力なテクニックとなります。独自のニーズに合わせてモデルを調整することで、より小さく効率的なモデルでより優れたパフォーマンスを達成し、大幅なコスト削減につなげることができます。

大規模で汎用的なLLMだけに頼るのではなく、特殊なタスクのために小規模なモデルを微調整することを検討してください。このアプローチでは、特定のユースケースに最適化しながら、事前に訓練されたモデルの知識を活用することができます。

微調整には初期投資が必要だが、長期的にはかなりの節約につながる。微調整されたモデルは、多くの場合、同じかそれ以上の結果を得るために必要なトークンの数を減らし、推論コストを削減します。また、精度が向上するため、再試行や訂正の回数が減り、さらにコストが削減されることもあります。さらに、特化されたモデルはより小さくなることが多く、計算オーバーヘッドと関連費用を削減することができます。

ファインチューニングの利点を最大化するには、ベースとなる事前学習済みの小規模モデルから開始します。ファインチューニングには高品質でドメイン固有のデータを使用し、モデルのパフォーマンスとコスト効率を定期的に評価します。この継続的な最適化プロセスにより、微調整されたモデルがコストを抑えながら価値を提供し続けることが保証されます。

戦略5:無料・低コストの選択肢を探る

多くの企業にとって、特に開発およびテスト段階では、次のような利点があります。 無料または低コストのLLMオプション は、品質に妥協することなく費用を大幅に削減することができます。これらのオプションは、新しいLLMアプリケーションのプロトタイプ作成、LLM実装に関する開発者のトレーニング、クリティカルでないサービスや内部向けのサービスの実行に特に有効です。

しかし、無料のオプションはコストを大幅に削減することができますが、トレードオフを考慮することが重要です。特に機密情報を扱う場合は、データのプライバシーとセキュリティへの影響を慎重に評価する必要があります。さらに、モデル機能やカスタマイズ・オプションに制限がある可能性にも注意が必要だ。コスト削減策が将来の成長の障害にならないよう、長期的な拡張性と移行経路を考慮する。

戦略6:コンテキスト・ウィンドウ管理の最適化

LLMにおけるコンテキストウィンドウのサイズは、パフォーマンスとコストの両方に大きな影響を与える可能性がある。コンテキストウィンドウを効果的に管理することは、出力品質を維持しながらコストをコントロールするために極めて重要である。コンテキスト・ウィンドウを大きくすると、より包括的な理解が可能になるが、クエリごとのトークン使用量が増え、計算要件が高くなるため、コストが高くなる。

コンテキストウィンドウの使用を最適化するために、タスクの複雑さに基づいた動的なコンテキストのサイジングの実装を検討する。関連する情報を要約するために要約テクニックを使い、長い文書や会話にはスライディングウィンドウアプローチを採用する。これらの方法は、理解度とコスト効率の間のスイートスポットを見つけるのに役立ちます。

コンテキストサイズと出力品質の関係を定期的に分析し、アプローチを微調整する。特定のタスク要件に基づいてコンテキスト・ウィンドウを調整し、必要な場合にのみ大きなコンテキストを使用する階層化アプローチの導入を検討する。コンテキスト・ウィンドウを注意深く管理することで、LLM出力の品質を犠牲にすることなく、トークンの使用量と関連コストを大幅に削減できます。

戦略7:マルチ・エージェント・システムの導入

マルチエージェントシステムは、LLMアプリケーションの効率と費用対効果を高める強力なアプローチを提供する。タスクを特化したエージェントに分散することで、企業はリソースの割り当てを最適化し、LLM全体のコストを削減することができます。

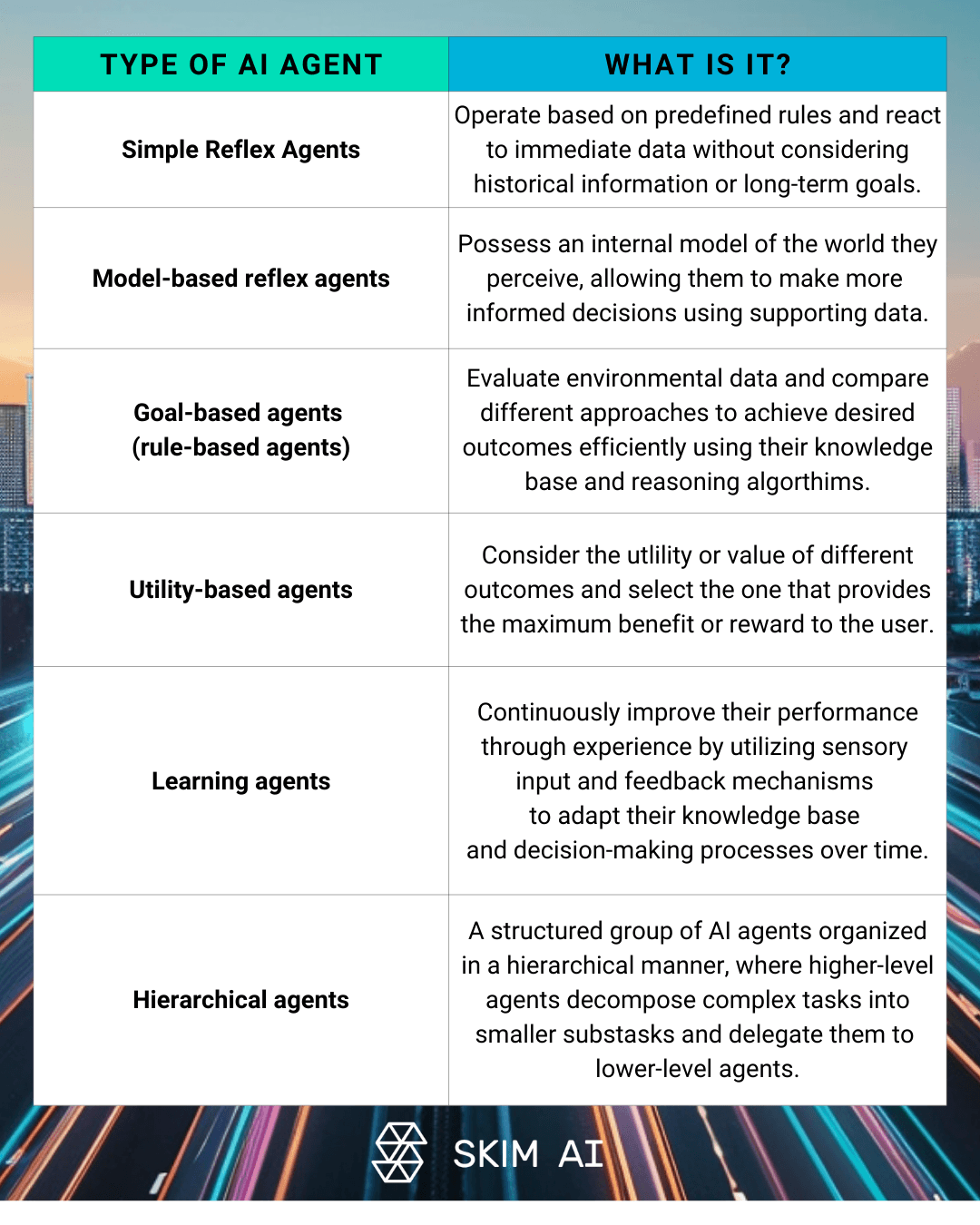

マルチエージェントLLMアーキテクチャは、複数の AIエージェント 複雑な問題を共同で解決する。このアプローチには、タスクの異なる側面に特化したエージェント、監督エージェントと作業エージェントによる階層構造、複数のLLMによる協調的な問題解決などがある。このようなシステムを導入することで、組織はすべてのタスクについて高価で大規模なモデルへの依存を減らすことができる。

分散タスク処理のコストメリットは大きい。マルチエージェントシステムは以下を可能にする:

タスクの複雑性に基づいて最適化されたリソース割り当て

システム全体の効率と応答時間の改善

ターゲットを絞ったモデル展開によるトークン使用量の削減

しかし、マルチエージェントシステムのコスト効率を維持するためには、堅牢なデバッグメカニズムを実装することが極めて重要です。これには、エージェント間の通信をログに記録して監視すること、トークンの使用パターンを分析して冗長なやり取りを特定すること、エージェント間の役割分担を最適化して不要なトークンの消費を最小限に抑えることなどが含まれます。

戦略8:出力フォーマットツールの活用

適切な出力フォーマットは、LLMコスト管理の重要な要素である。トークンの効率的な使用を保証し、追加処理の必要性を最小限に抑えることで、企業は運用コストを大幅に削減することができます。

これらのツールは、強制関数出力のための強力な機能を提供し、開発者はLLM応答のための正確なフォーマットを指定することができます。このアプローチにより、出力のばらつきを抑え、モデルが必要な情報のみを生成するようにすることで、トークンの無駄を最小限に抑えることができます。

LLM出力のばらつきを減らすことは、関連コストに直接的な影響を与える。一貫性があり、適切に構造化された応答は、不正な形式や使用不可能な出力の可能性を減少させ、その結果、情報を明確にしたり再フォーマットするための追加のAPI呼び出しの必要性を減少させる。

JSON出力を実装することは、効率性において特に効果的である。JSONは、構造化されたデータをコンパクトに表現し、パースやさまざまなシステムとの統合が容易で、自然言語レスポンスに比べてトークンの使用量を削減できます。これらの出力フォーマットツールを活用することで、企業はLLMワークフローを合理化し、トークンの使用量を最適化することができます。

戦略9:LLM以外のツールを統合する

LLMは強力ではあるが、必ずしもすべてのタスクに対して最も費用対効果の高いソリューションではない。非LLMツール をワークフローに組み込むことで、高品質のアウトプットを維持しながら、運用コストを大幅に削減することができます。

LLMの全機能を必要としない特定のタスクを処理するためにPythonスクリプトを組み込むことは、大幅なコスト削減につながります。例えば、単純なデータ処理やルールベースの意思決定は、従来のプログラミングアプローチでより効率的に処理できることが多い。

ワークフローにおいてLLMと従来のツールのバランスを取る場合、タスクの複雑さ、要求される精度、潜在的なコスト削減を考慮する。LLMと従来のツールの両方の長所を活用するハイブリッド・アプローチは、多くの場合、パフォーマンスとコスト効率の面で最良の結果をもたらします。

ハイブリッド・アプローチのコスト・ベネフィット分析を徹底的に行うことは極めて重要である。この分析では、以下のような要素を考慮すべきである:

カスタムツールの開発・保守コスト

処理時間とリソース要件

アウトプットの正確性と信頼性

長期的な拡張性と柔軟性

戦略10:定期的な監査と最適化

LLMコスト管理手法の確立は、継続的なプロセスであり、絶え間ない警戒と最適化が必要です。LLMの使用量とコストを定期的に監査することは、非効率を特定し、コスト管理のための改善を実施する上で極めて重要です。

継続的なコスト管理とコスト削減の重要性は、いくら強調してもしすぎることはありません。LLMアプリケーションが進化し、規模が拡大するにつれて、新たな課題と最適化の機会が現れます。LLMの使用状況を一貫して監視・分析することで、潜在的なコスト超過を未然に防ぎ、AI投資が最大限の価値をもたらすようにすることができます。

無駄なトークンを特定するには、堅牢な追跡および分析ツールを導入する。冗長なクエリ、過剰なコンテキストウィンドウ、非効率的なプロンプトデザインなどのパターンを探します。このデータを使用してLLM戦略を改善し、不要なトークン消費を排除します。

最後に、LLMの効率的なリソース管理を長期的に成功させるには、組織内にコスト意識の文化を醸成することが鍵となる。LLMの利用がコストに与える影響を考慮し、最適化の機会を積極的に探し、経費を抑制するようチームに奨励しましょう。コスト効率を共有責任とすることで、LLMテクノロジーのメリットを最大限に享受しながら、経費を抑制することができます。

結論

大規模な言語モデルが企業のAIアプリケーションに影響を与え続ける中、LLMコスト管理をマスターすることは長期的な成功のために極めて重要になります。スマートなモデルの選択から定期的な監査と最適化まで、この記事で紹介する10の戦略を実施することで、組織はパフォーマンスを維持、あるいは向上させながら、LLMコストを大幅に削減することができます。効果的なコスト管理は、継続的なモニタリング、分析、適応を必要とする継続的なプロセスであることを忘れてはならない。コストを意識する文化を醸成し、適切なツールとテクニックを活用することで、運用コストを抑制しながらLLMの可能性を最大限に活用し、AI投資が企業に最大限の価値をもたらすようにすることができます。

LLMのコスト管理についてもっと知りたい方は、遠慮なくご連絡ください。