Che cos'è Stable Audio 2.0? + la tecnologia alla base del modello generativo AI Text-to-Audio di Stable Diffusion

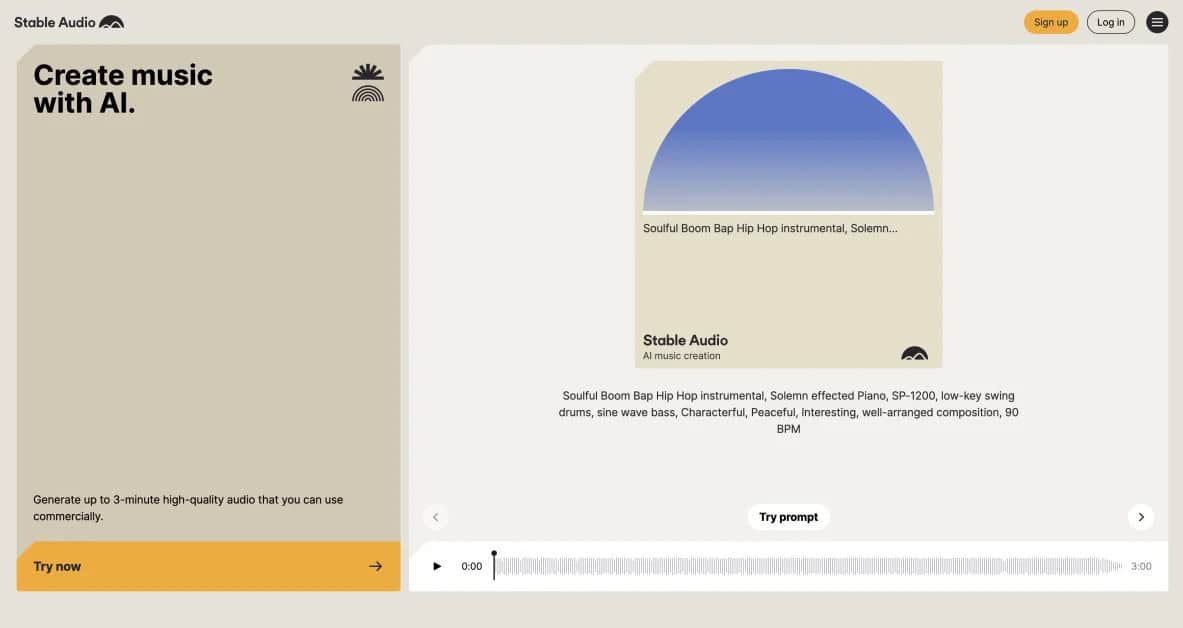

L'intelligenza artificiale ha fatto passi da gigante in diversi settori creativi, offrendo nuovi strumenti e tecniche per la produzione di contenuti. Stabilità AI, un'azienda nota per il suo lavoro sui contenuti generati dall'intelligenza artificiale, ha recentemente pubblicato Audio stabile 2.0, una versione aggiornata della sua piattaforma audio generata dall'intelligenza artificiale. Questa nuova iterazione promette di portare una serie di capacità avanzate nel campo della generazione audio, potenzialmente in grado di rimodellare il modo in cui vengono creati musica, effetti sonori e contenuti audio.

Stabilità AI Stability AI ha una storia di sviluppo di strumenti innovativi basati sull'intelligenza artificiale, come Stable Diffusion, che è stato ben accolto per la sua capacità di generare immagini di alta qualità da descrizioni testuali. Con il rilascio di Stable Audio 2.0, l'azienda intende estendere la propria esperienza al settore dell'audio, fornendo una piattaforma in grado di soddisfare le esigenze di musicisti, sound designer e creatori di contenuti.

Esplorazione delle capacità di Stable Audio 2.0

Stable Audio 2.0 offre una serie di funzioni progettate per migliorare la generazione e la manipolazione dell'audio:

Generazione di tracce estesa: Stable Audio 2.0 è in grado di generare tracce audio più lunghe e coese rispetto alle versioni precedenti. Questa funzione consente agli utenti di creare composizioni musicali complete con più sezioni, come intro, strofe, ritornelli e outro. La possibilità di generare tracce estese può essere utile a musicisti e compositori che desiderano sperimentare nuove idee o snellire il proprio flusso di lavoro.

Trasformazione audio-audio con suggerimenti in linguaggio naturale: La piattaforma consente agli utenti di caricare i propri campioni audio e di trasformarli utilizzando suggerimenti in linguaggio naturale. Ad esempio, l'utente può inserire una registrazione di pianoforte e chiedere a Stable Audio 2.0 di "aggiungere uno strato di synth pad" o "cambiare il pianoforte con un suono di violino". Questa funzione mira a rendere la manipolazione dell'audio più intuitiva e accessibile, per soddisfare gli utenti con diversi livelli di competenza tecnica.

Produzione di effetti sonori: Stable Audio 2.0 è in grado di generare una varietà di effetti sonori, dai rumori ambientali a complessi paesaggi sonori. Questa capacità può essere utile per gli sviluppatori di giochi, i registi e i creatori multimediali che necessitano di effetti sonori di alta qualità per i loro progetti. La piattaforma consente agli utenti di iterare sui progetti audio e di messa a punto i risultati in base alle loro esigenze specifiche.

Trasferimento di stile: La funzione di trasferimento dello stile di Stable Audio 2.0 consente agli utenti di applicare le caratteristiche di una traccia audio o di un genere di riferimento al proprio input audio. Analizzando gli elementi stilistici del riferimento, il modello può trasformare l'audio dell'utente in modo che corrisponda allo stile desiderato. Questa funzione può essere utile per i creatori di contenuti che desiderano mantenere la coerenza tra i progetti o sperimentare diversi generi musicali.

Stable Audio 2.0 si propone di fornire una piattaforma completa e facile da usare per la generazione e la manipolazione dell'audio. La combinazione di capacità estese di generazione di tracce, trasformazione audio-audio, produzione di effetti sonori e trasferimento di stili ne fa uno strumento potenzialmente prezioso per i professionisti e gli appassionati del settore audio.

La tecnologia alla base dell'audio stabile 2.0

Stable Audio 2.0 si avvale di tecnologie AI avanzate che ne consentono la generazione e la manipolazione audio. Al centro della piattaforma si trova un'architettura a modello di diffusione latente, che consiste in due componenti principali: un autoencoder altamente compresso e un trasformatore di diffusione.

L'autoencoder è responsabile della compressione delle forme d'onda audio grezze in una rappresentazione compatta e latente. Questo processo di compressione consente al modello di catturare le caratteristiche essenziali dell'audio, riducendo al contempo i requisiti computazionali. La rappresentazione compressa serve come base per le successive attività di generazione e manipolazione dell'audio.

Il trasformatore di diffusione, un componente chiave di Stable Audio 2.0, è progettato per gestire gli aspetti temporali dei dati audio. Prende la rappresentazione latente compressa e genera nuovi campioni audio in base alle richieste o alle trasformazioni fornite. L'architettura del trasformatore di diffusione consente al modello di catturare le dipendenze a lungo raggio e di mantenere la coerenza dell'audio generato.

Stable Audio 2.0 mira a trovare un equilibrio tra efficienza computazionale e qualità dell'output. La combinazione dell'autoencoder compresso e del trasformatore di diffusione consente alla piattaforma di generare audio di alta qualità mantenendo i requisiti computazionali gestibili. Questo equilibrio è fondamentale per rendere la piattaforma accessibile a un'ampia gamma di utenti con risorse computazionali diverse.

Rispetto al suo predecessore e ad altre piattaforme audio generate dall'intelligenza artificiale, Stable Audio 2.0 introduce diversi progressi tecnologici. L'architettura migliorata del modello di diffusione latente e l'integrazione del trasformatore di diffusione contribuiscono alla capacità della piattaforma di generare tracce audio più lunghe e coerenti. Inoltre, le efficienti tecniche di compressione della piattaforma consentono una più rapida elaborazione e manipolazione dei dati audio.

Dare potere ai creatori rispettando i loro diritti

Stabilità AI Stability AI riconosce l'importanza di utilizzare set di dati autorizzati nello sviluppo di modelli di intelligenza artificiale. Stable Audio 2.0 viene addestrato su un set di dati accuratamente curato che include un'ampia gamma di campioni audio, come musica, effetti sonori e registrazioni di strumenti. L'azienda si è impegnata a garantire che il set di dati provenga da fonti autorizzate e consentite, rispettando i diritti di proprietà intellettuale dei creatori originali.

Per dare ulteriore potere ai creatori e proteggere i loro diritti, Stable Audio 2.0 prevede un meccanismo di opt-out per gli artisti le cui opere sono state incluse nel set di dati di addestramento. Ciò consente ai creatori di avere il controllo sul loro contributo al modello e garantisce che il loro lavoro venga utilizzato solo con il loro consenso. Stability AI si impegna a mantenere aperti i canali di comunicazione con i creatori e a rispondere a qualsiasi dubbio sull'uso delle loro opere.

Oltre al meccanismo di opt-out, Stability AI ha implementato delle misure per garantire un equo compenso ai creatori il cui lavoro ha contribuito allo sviluppo di Stable Audio 2.0. L'azienda riconosce il valore del lavoro dei creatori e mira a stabilire un sistema di compensazione equo e trasparente. Questo può comportare il pagamento di royalties, accordi di licenza o altre forme di compensazione, a seconda del caso d'uso specifico e delle preferenze dei creatori.

Per prevenire la violazione del copyright e proteggere i diritti dei proprietari dei contenuti, Stable Audio 2.0 incorpora tecnologie di riconoscimento dei contenuti. Queste tecnologie aiutano a identificare e segnalare qualsiasi materiale protetto da copyright che possa essere caricato sulla piattaforma, impedendo l'uso e la distribuzione non autorizzati. Stability AI ha collaborato con i principali fornitori di riconoscimento dei contenuti per garantire l'efficacia e l'affidabilità di queste misure.

Stability AI sta cercando di assicurarsi un posto nel futuro dell'audio AI

L'introduzione di Stable Audio 2.0 ha il potenziale per cambiare il modo in cui vengono creati e prodotti i contenuti audio. Sfruttando la potenza dell'intelligenza artificiale, la piattaforma offre nuove possibilità a musicisti, sound designer e creatori di contenuti, consentendo loro di esplorare territori creativi inesplorati.

Uno degli impatti più significativi di Stable Audio 2.0 è il suo potenziale nel semplificare e accelerare i flussi di lavoro della produzione musicale e del sound design. Grazie alla possibilità di generare composizioni musicali estese e di manipolare campioni audio utilizzando suggerimenti in linguaggio naturale, i creatori possono iterare rapidamente le idee e sperimentare suoni e stili diversi. Questo può portare a processi di produzione più rapidi ed efficienti, consentendo agli artisti di concentrarsi maggiormente sulla loro visione creativa e meno sui vincoli tecnici.

Inoltre, Stable Audio 2.0 apre nuove strade ai creatori di contenuti in diversi settori. Registi, sviluppatori di giochi e produttori multimediali possono utilizzare le capacità di generazione di effetti sonori della piattaforma per migliorare l'esperienza audio dei loro progetti. Generando effetti sonori coinvolgenti e realistici, i creatori possono aggiungere profondità e dimensionalità ai loro contenuti visivi, creando esperienze più coinvolgenti e memorabili per il loro pubblico.

Le funzionalità di trasferimento degli stili di Stable Audio 2.0 offrono anche interessanti opportunità di personalizzazione dell'audio. I creatori di contenuti possono facilmente adattare gli stili audio all'estetica e al tono dei loro progetti, garantendo un'esperienza audiovisiva coesa e coerente. Questa funzione può essere particolarmente preziosa per il branding e la pubblicità, dove è fondamentale mantenere un'identità sonora specifica su diversi supporti.

Con il continuo progresso dell'IA, piattaforme come Stable Audio 2.0 hanno il potenziale per favorire una maggiore collaborazione tra IA e creatività umana. Piuttosto che sostituire gli artisti umani, l'IA può servire come un potente strumento che aumenta e migliora il loro processo creativo. Lavorando in tandem con l'intelligenza artificiale, i creatori possono spingersi oltre i confini del possibile nella creazione audio, scoprendo nuovi paesaggi sonori e superando i limiti della loro immaginazione.