4 buone pratiche per prevenire i divieti delle API OpenAI e garantire la conformità

Se la vostra azienda ha a che fare con l'IA in qualsiasi aspetto, la conformità è più critica che mai, soprattutto quando si sfruttano modelli di IA come quelli forniti da OpenAI. Molte aziende non si rendono conto che il mancato rispetto delle policy di OpenAI da parte degli utenti può portare al divieto di accesso alle API, spesso senza preavviso. Per le aziende che gestiscono più utenti, garantire il rispetto delle policy di OpenAI è fondamentale per mantenere un accesso ininterrotto a questi potenti strumenti. Il mancato rispetto dei termini può portare a gravi conseguenze, tra cui divieti che potrebbero interrompere in modo significativo le operazioni aziendali.

OpenAI ha stabilito una serie completa di politiche volte a prevenire gli abusi. Queste politiche non solo proteggono la piattaforma, ma assicurano anche un uso responsabile delle tecnologie AI in tutti i settori. Le aziende che utilizzano le API di OpenAI devono essere diligenti nel monitorare il comportamento degli utenti per evitare violazioni che potrebbero portare a sanzioni o divieti. La comprensione e la navigazione efficace di queste politiche è la chiave per mantenere l'accesso e ottenere un vantaggio competitivo nello spazio dell'IA.

Comprendere le politiche di utilizzo delle API di OpenAI

Le politiche di utilizzo delle API di OpenAI sono progettate per salvaguardare l'uso etico e appropriato dell'IA. L'uso improprio di queste API, in particolare attraverso i contenuti generati dagli utenti, può portare rapidamente alla sospensione o al divieto dell'account. Il comportamento scorretto degli utenti, come l'invio di contenuti inappropriati o dannosi, non solo viola i termini di OpenAI, ma mette anche a rischio interi account.

OpenAI monitora attivamente i modelli di utilizzo e valuta le azioni nascoste che potrebbero violare le sue linee guida. Ad esempio, l'invio di contenuti inappropriati o i tentativi di aggirare i filtri dei contenuti possono portare a ripercussioni significative. OpenAI nasconde dettagli specifici sul modo in cui valuta le richieste, mantenendo uno stretto riserbo sui suoi processi di moderazione per garantire che la conformità sia rispettata senza compromessi. In questo modo, OpenAI garantisce che i suoi modelli siano utilizzati in modo conforme ai suoi standard etici.

Per evitare questi problemi, è essenziale che gli sviluppatori e le imprese siano proattivi nell'applicare le linee guida di OpenAI e nel fare leva su strumenti integrati come il endpoint di moderazioneche può aiutare a filtrare i contenuti potenzialmente dannosi prima che raggiungano l'API. Comprendere gli aspetti chiave dell'uso improprio e sapere come OpenAI tiene traccia delle violazioni consentirà alle aziende di gestire i rischi in modo più efficace.

Sfide delle applicazioni multiutente

Per le aziende che gestiscono applicazioni con più utenti, i rischi associati all'uso improprio delle API sono significativamente più elevati. Ogni utente può potenzialmente violare inavvertitamente o intenzionalmente le policy di OpenAI, con conseguenze che si ripercuotono sull'intera organizzazione. Per questo è fondamentale che gli sviluppatori comprendano le sfide uniche poste dagli ambienti multiutente.

La gestione di più utenti presenta sfide specifiche, come livelli diversi di comprensione dell'uso accettabile, un'adesione incoerente alle linee guida e il potenziale di comportamenti dannosi da parte di un piccolo sottoinsieme di utenti. Ogni interazione tra gli utenti deve essere attentamente monitorata, perché una singola violazione può mettere a rischio l'intero accesso all'API di un'organizzazione. Inoltre, la scalabilità di una piattaforma con più utenti introduce complessità nel garantire che tutti gli utenti siano conformi senza sovraccaricare il sistema di controlli manuali.

A differenza dei modelli di IA precedenti, che potevano essere meno rigorosi, l'ultimo modello di IA di OpenAI prevede linee guida di conformità più severe che vengono monitorate attentamente. Le aziende devono assumersi la responsabilità di monitorare i contenuti generati dagli utenti per prevenire le violazioni, il che comporta l'implementazione di un filtro automatico dei contenuti e di controlli di conformità. Misure proattive come l'integrazione dell'endpoint di moderazione di OpenAI, la definizione di chiare politiche di utilizzo per gli utenti finali e la fornitura di risorse educative agli utenti sui contenuti accettabili possono contribuire a mitigare questi rischi e a garantire la disponibilità continua dell'API.

Gestendo efficacemente il comportamento dei singoli utenti e implementando solidi strumenti di monitoraggio, le aziende possono evitare di essere penalizzate per le azioni di pochi malintenzionati. Investire in processi e strumenti di gestione degli utenti non solo aiuta a garantire la conformità, ma crea anche un ambiente più affidabile per tutti gli utenti, sostenendo in ultima analisi gli obiettivi a lungo termine dell'azienda con l'integrazione dell'IA.

Le migliori pratiche per prevenire i divieti delle API OpenAI

Per prevenire i divieti e garantire che l'utilizzo delle API rimanga conforme, è fondamentale implementare specifiche best practice. Ecco alcune strategie che sviluppatori e aziende possono seguire:

Utilizzare l'endpoint di moderazione: OpenAI fornisce un endpoint di moderazione gratuito che aiuta a identificare i contenuti dannosi prima che raggiungano l'API. Questo strumento è essenziale per filtrare i contenuti inappropriati e ridurre il rischio di sanzioni.

Limiti tariffari e identificatori univoci degli utenti: L'implementazione di limiti di velocità e l'assegnazione di identificatori utente unici a ogni richiesta API possono aiutare a gestire e tracciare il comportamento degli utenti. Controllando il volume delle richieste e collegandole ai singoli utenti, diventa più facile identificare e limitare gli account problematici.

Monitoraggio e registrazione in tempo reale: Stabilire sistemi di monitoraggio in tempo reale per tenere traccia dell'utilizzo dell'API. La registrazione di ogni richiesta consente agli sviluppatori di verificare il comportamento degli utenti e di rilevare tempestivamente le anomalie.

Convalida dell'ingresso: Assicuratevi che tutti gli input siano convalidati per evitare che dati dannosi o inappropriati vengano elaborati dall'API. Una corretta convalida degli input può ridurre i rischi e migliorare la conformità.

Queste pratiche non solo riducono al minimo il rischio di violazioni, ma forniscono alle aziende un vantaggio competitivo, in quanto dimostrano un impegno per un utilizzo responsabile dell'IA. L'adozione di un approccio strutturato alla conformità, che includa l'utilizzo degli strumenti integrati di OpenAI, può portare a un uso più affidabile ed efficace dei modelli di IA.

Capire l'endpoint di moderazione di OpenAI

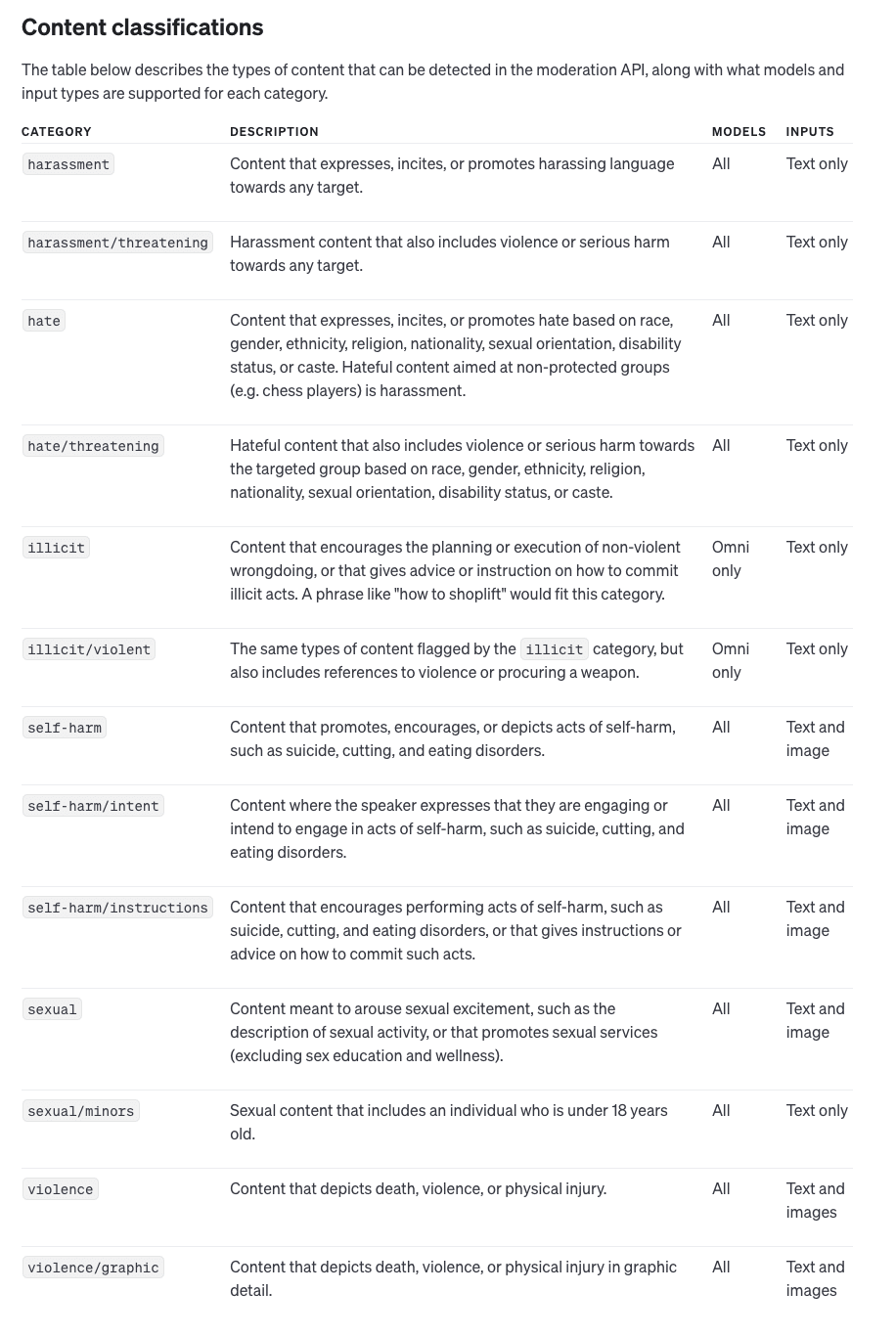

L'endpoint di moderazione fornito da OpenAI è uno strumento fondamentale per garantire che i contenuti dannosi non passino attraverso il sistema, contribuendo così a mantenere la conformità e a prevenire i divieti. L'endpoint è in grado di analizzare sia il testo che le immagini inserite, identificando categorie potenzialmente dannose come violenza, incitamento all'odio e altro.

L'endpoint di moderazione di OpenAI offre le seguenti funzionalità:

Modello Omni-Moderazione: Questa è la versione più recente e supporta più opzioni di categorizzazione e di multimodale e quindi è adatto sia per il testo che per le immagini.

Moderazione del testo legacy: I modelli più vecchi, che supportano solo input testuali, hanno minori capacità di categorizzazione. Tuttavia, per le nuove applicazioni, si raccomanda il modello di omni-moderazione.

L'utilizzo dell'endpoint di moderazione comporta il passaggio dei dati di input all'API di OpenAI, che fornisce poi una risposta dettagliata. Questa risposta include:

Contenuto segnalato: L'endpoint imposta un flag su true se l'input contiene contenuti dannosi o inappropriati.

Categoria Punteggi: Un sistema di punteggio dettagliato che indica il livello di fiducia del modello nella categorizzazione dei contenuti potenzialmente dannosi.

Dati specifici della categoria: L'endpoint fornisce un'indicazione di quali tipi di input (ad esempio, testo o immagine) hanno innescato la categorizzazione, consentendo sforzi di moderazione più precisi.

Implementando l'endpoint di moderazione, le aziende possono agire in modo proattivo, filtrando i contenuti segnalati prima che raggiungano l'API principale di OpenAI. In questo modo non solo si protegge l'integrità del modello di intelligenza artificiale, ma si riduce anche il rischio di violazioni delle policy che potrebbero portare a un divieto dell'API.

Garantire la conformità e il vantaggio competitivo

La conformità non serve solo a evitare sanzioni, ma può anche rappresentare un vantaggio competitivo nel settore dell'IA. Le aziende che aderiscono rigorosamente alle linee guida di OpenAI hanno meno probabilità di subire interruzioni, consentendo loro di fornire servizi coerenti e affidabili ai propri utenti.

Inoltre, essere proattivi nel garantire la conformità significa che le aziende possono sfruttare appieno il potenziale dei modelli di IA di OpenAI. Comprendendo il processo di ragionamento alla base delle politiche di OpenAI e implementando le best practice, le aziende si posizionano come leader responsabili nello spazio dell'IA. La conformità aiuta a creare fiducia, sia con gli utenti che con i partner del settore, consentendo alle aziende di differenziarsi dai concorrenti che potrebbero non essere altrettanto diligenti.

Il bilancio

Un utilizzo responsabile delle API è fondamentale per mantenere l'accesso ai potenti strumenti di OpenAI. La mancata osservanza delle politiche di OpenAI può comportare gravi conseguenze, tra cui il divieto di utilizzo delle API che può interrompere significativamente le operazioni aziendali. Gli sviluppatori e le aziende devono essere proattivi nella gestione del comportamento degli utenti, nell'implementazione di strategie di moderazione e nel rispetto delle best practice per evitare violazioni.

In definitiva, seguire le linee guida di OpenAI non solo previene le interruzioni, ma posiziona le aziende come leader nell'utilizzo etico dell'IA. Dimostrando un impegno alla conformità, le aziende possono garantire il loro accesso alle API, migliorare il loro vantaggio competitivo e contribuire positivamente all'evoluzione del settore dell'IA.