Top 5 des outils et plateformes d'IA multimodale

Le paysage de l'intelligence artificielle est en constante évolution. IA multimodale Les outils et les plates-formes de l'IA émergent comme des acteurs importants. Ces solutions innovantes vont au-delà de l'IA traditionnelle à mode unique en intégrant différents types de données - telles que le texte, les images, la parole et la vidéo - pour créer des systèmes plus intelligents, plus efficaces et plus intuitifs. Cette intégration permet une compréhension et une interaction plus complètes avec les données, reflétant ainsi la façon dont les humains perçoivent et traitent l'information.

Dans ce blog, nous allons explorer quelques-uns des meilleurs outils et plateformes d'IA multimodale qui font des vagues dans le monde de la technologie. Ces plateformes ne révolutionnent pas seulement la façon dont les machines apprennent et interagissent avec les données, mais aussi la façon dont les entreprises et les particuliers exploitent l'IA pour des applications plus complexes et plus précises.

1. Piste Gen-2

Défilé Runway Gen-2, développé par Runway, marque une évolution significative dans le domaine de la recherche et du développement. IA générativeCet outil démontre la puissance de l'intelligence artificielle multimodale. Cet outil démontre la puissance de l'IA multimodale en permettant aux utilisateurs de générer des vidéos inédites à partir d'un mélange de textes, d'images ou de clips vidéo. Runway Gen-2 vous permet de créer des produits multimédias précis, réalistes et contrôlables qui repoussent les limites de la créativité numérique.

Les dernières mises à jour de Gen-2 sont particulièrement remarquables pour leurs avancées majeures en termes de fidélité et de cohérence des vidéos qu'elles produisent. Ce saut de qualité a fait tourner les têtes dans la communauté de l'IA, les utilisateurs le qualifiant de moment charnière dans l'évolution de l'IA générative. La capacité de l'outil à générer des vidéos grandeur nature à partir de simples invites textuelles, d'images ou de vidéos existantes est une caractéristique révolutionnaire qui offre de nouvelles possibilités en matière de narration et de médias numériques. De telles capacités ont donné lieu à des comparaisons avec l'invention de l'appareil photo, suggérant que l'IA est en train de devenir un nouveau moyen de capturer et de créer des récits visuels.

Les principales caractéristiques de Runway Gen-2 sont les suivantes

La possibilité de créer des vidéos et des images sur mesure.

Téléchargement facile du contenu généré pour diverses utilisations.

Accessibilité sur les plateformes web et mobile de Runway, offrant polyvalence et commodité.

Une conception qui place l'utilisateur au premier plan de l'activité de l'entreprise les développements de l'IA générativeet garantissent une innovation constante.

Runway Gen-2 inaugure une nouvelle ère dans les médias numériques, où la narration, la créativité et l'IA convergent pour ouvrir des voies inimaginables dans la création de contenu.

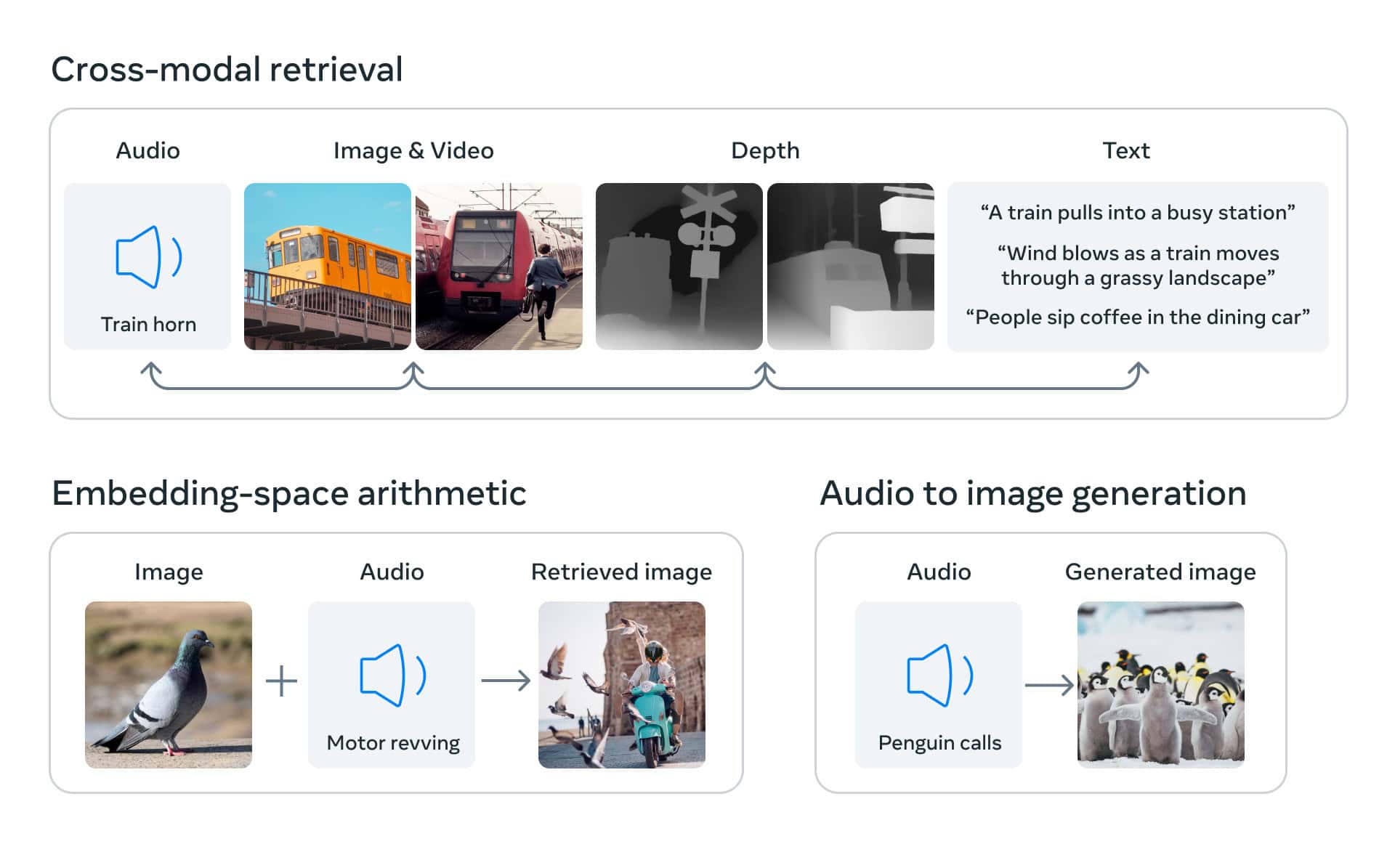

2. ImageBind de Meta AI

ImageBind, développé par Meta AI, est à la pointe de l'innovation en matière d'intelligence artificielle multimodale et représente une avancée significative dans l'intégration et l'interprétation de divers types de données. Ce modèle novateur combine de manière unique des informations provenant de six modalités différentes : images, texte, audio, profondeur, données thermiques et IMU. Cette intégration facilite l'intégration conjointe de ces différents types de données, créant ainsi des opportunités sans précédent pour la recherche multimodale, la composition arithmétique des modalités, la détection et la génération.

L'essence de l'innovation d'ImageBind réside dans l'extension des modèles de langage visuel à grande échelle. Elle améliore les capacités de ces modèles à ne pas prendre de clichés, ce qui leur permet de s'adapter de manière transparente à de nouvelles modalités. Cette caractéristique permet de développer de nouvelles applications dès le départ, ce qui élargit considérablement les cas d'utilisation potentiels des systèmes d'intelligence artificielle. ImageBind a démontré des performances supérieures dans les tâches émergentes de reconnaissance à partir de zéro dans toutes ces modalités et a établi de nouvelles références dans le domaine de la reconnaissance à partir de quelques images.

Le développement d'ImageBind s'inscrit dans le cadre des efforts plus larges déployés par Meta pour créer des systèmes d'intelligence artificielle multimodaux qui apprennent à partir d'une variété de types de données. Sa capacité à combiner six formes différentes de données dans un seul espace d'intégration est sans précédent. Cette capacité permet non seulement d'imiter plus fidèlement la perception humaine, mais aussi de permettre aux machines d'analyser plus efficacement différentes formes d'informations.

Les principales caractéristiques d'ImageBind sont les suivantes

Intégration de six modalités (images, texte, audio, profondeur, thermique, IMU) dans un modèle unique.

Amélioration des capacités de prise de vue zéro, étendant la fonctionnalité des modèles vision-langage.

Performances supérieures dans les tâches de reconnaissance à zéro coup et à quelques coups.

Disponibilité d'une source ouverte, contribuant aux progrès dans le domaine de l'IA multimodale.

Grâce à son approche novatrice, ImageBind peut révolutionner l'IA et donner naissance à des produits innovants. applications dans le domaine de l'image et la génération de vidéos, la synthèse audio et les expériences virtuelles immersives. Il témoigne de l'évolution des capacités de l'IA à imiter les processus cognitifs humains et à interpréter le monde qui nous entoure.

3. ChatGPT

ChatGPT a fait un grand pas en avant en intégrant des fonctions multimodales, améliorant ses capacités d'interaction au-delà du texte pour inclure la reconnaissance de la voix et de l'image. Cette expansion représente une évolution significative de la technologie des chatbots.

L'une des améliorations les plus notables concerne les capacités de reconnaissance d'images de ChatGPT. ChatGPT peut désormais comprendre et interpréter des images, y compris du texte manuscrit. Les utilisateurs peuvent télécharger une image et dialoguer avec le chatbot sur son contenu, qu'il s'agisse d'identifier des objets dans l'image, comme un nuage, ou de créer un plan de repas à partir d'une photo du contenu de leur réfrigérateur. Cette fonctionnalité fait de ChatGPT un outil incroyablement polyvalent, capable de fournir des réponses plus contextuelles et pertinentes basées sur des données visuelles.

Outre la reconnaissance d'images, ChatGPT s'est également lancé dans les interactions vocales. Équipé d'un modèle de synthèse vocale, il offre aux utilisateurs le choix entre cinq options vocales différentes, ajoutant ainsi une nouvelle dimension à l'expérience du chat. L'intégration du système de reconnaissance vocale Whisper d'OpenAI renforce encore cette capacité. Whisper peut transcrire les mots prononcés en texte, facilitant ainsi un dialogue transparent et intuitif entre l'utilisateur et ChatGPT. Cette approche multimodale permet une expérience conversationnelle plus naturelle et plus engageante.

Les principales caractéristiques du ChatGPT multimodal sont les suivantes

Des capacités multimodales, permettant de traiter non seulement le texte, mais aussi les images et la voix.

Reconnaissance d'images, permettant d'interpréter des images et du texte manuscrit.

Reconnaissance vocale grâce à un modèle de synthèse vocale et à cinq options vocales différentes.

Intégration de Whisper d'OpenAI pour une transcription efficace de la parole au texte.

L'incursion de ChatGPT dans les fonctionnalités multimodales marque une étape importante dans le développement de l'IA. Elle met en évidence le potentiel des grands modèles pour traiter et interpréter un large éventail de types de données, ouvrant ainsi la voie à des applications d'IA plus sophistiquées et interactives.

4. Inworld AI

Inworld représente une avancée significative dans le domaine de l'intelligence artificielle, en particulier pour les personnages non jouables (PNJ) dans les jeux et les environnements interactifs. Développé par l'équipe à l'origine du Dialogflow de Google, ce moteur de caractères va au-delà des grands modèles de langage conventionnels (LLM), en introduisant une série de fonctionnalités qui élèvent les PNJ IA à de nouveaux sommets de réalisme et d'interaction.

Ce qui distingue Inworld, c'est son approche globale du développement des personnages. Il permet aux utilisateurs de créer des PNJ IA dotés de personnalités distinctes, renforcées par une compréhension approfondie du contexte et de la narration. Cela permet de s'assurer que les personnages restent fidèles aux rôles qui leur sont assignés dans l'univers du jeu, offrant ainsi aux joueurs une expérience plus immersive. La configurabilité de l'outil s'étend à des aspects tels que la sécurité, les connaissances, la mémoire et les contrôles narratifs, ce qui en fait une solution polyvalente pour diverses applications.

Inworld n'est pas seulement une percée dans le domaine des jeux. Il est également utilisé dans d'autres domaines, comme la création d'ambassadeurs de marque et d'agents de service à la clientèle empathiques, la facilitation d'expériences d'apprentissage personnalisées et l'amélioration des simulations interactives et de l'apprentissage par le jeu. L'utilisation de l'IA générative en temps réel permet de créer des personnages riches, nuancés et attachants, offrant ainsi une nouvelle norme pour les personnalités, les dialogues et les réactions alimentés par l'IA.

Les principales caractéristiques d'Inworld sont les suivantes

Paramètres de sécurité, de connaissance et de mémoire configurables pour un développement personnalisé des personnages.

Conception évolutive et prête à la production, ne nécessitant aucune configuration supplémentaire en cas de croissance.

Optimisation pour les expériences en temps réel, ce qui en fait un outil idéal pour l'intégration dans des applications dynamiques.

Polyvalence des applications, du jeu au service client en passant par les outils éducatifs.

Grâce à son approche innovante de l'IA des PNJ, Inworld établit une nouvelle référence pour les moteurs de personnages, offrant des possibilités inégalées de créer des personnages attachants et réalistes dans une multitude de contextes.

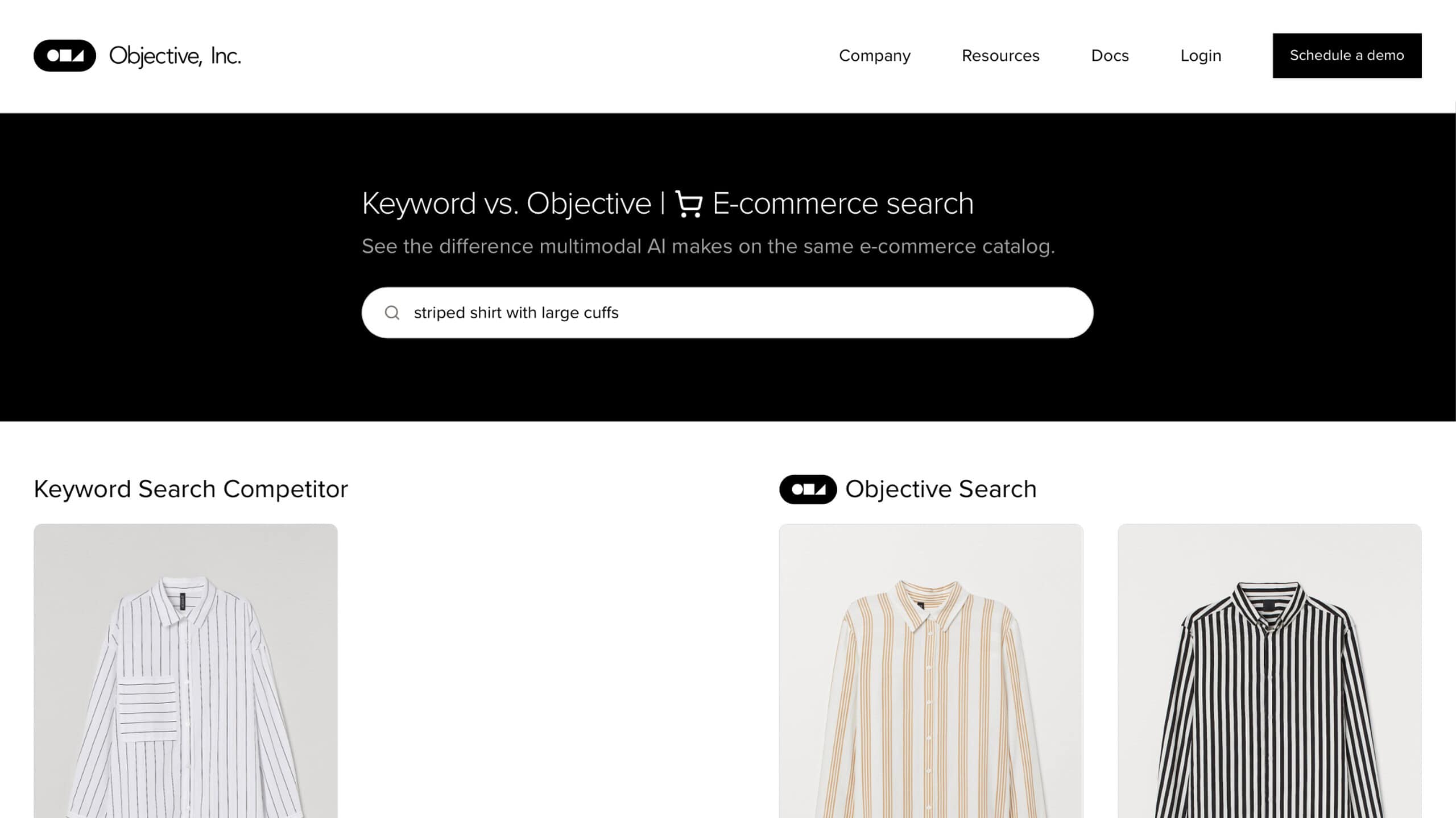

5. Objectif (anciennement Kailua Labs)

Objective (anciennement Kailua Labs) révolutionne le processus de recherche grâce à ses capacités d'IA avancées. Cet outil s'appuie sur le traitement du langage naturel (NLP) pour permettre aux utilisateurs de rechercher intuitivement un large éventail de types de données, y compris des images, des vidéos et des sons. Ce qui distingue Objective, c'est sa capacité à démocratiser le processus de recherche, en supprimant les barrières des connaissances spécialisées ou de l'expertise technique avancée.

Objectif interface conviviale L'interface conviviale d'Objective permet aux individus d'effectuer des recherches à l'aide de requêtes en langage naturel, ce qui le rend accessible et efficace pour les utilisateurs de tous niveaux. La force de l'outil réside dans sa prise en charge de la recherche multimodale, qui permet aux utilisateurs de trouver du contenu dans diverses applications en utilisant un mélange de langage naturel et de différents types de données. Cette approche améliore considérablement la précision et la pertinence des résultats de la recherche.

Les principales caractéristiques de l'objectif sont les suivantes

Conception conviviale et accessible, répondant aux besoins d'utilisateurs ayant divers degrés d'expertise technique.

Des capacités de recherche multimodales, permettant d'obtenir des résultats de recherche plus complets et plus pertinents.

L'utilisation du traitement du langage naturel pour simplifier et améliorer l'expérience de la recherche.

L'engagement d'Objective à fournir des outils d'IA innovants et faciles à utiliser illustre sa volonté d'améliorer l'expérience de la recherche. En simplifiant le processus et en garantissant des résultats précis, Objective rend la recherche avancée en IA accessible à un public plus large, changeant ainsi la façon dont nous interagissons avec les données.

Transformer l'interaction numérique grâce à des systèmes d'IA multimodaux

Comme nous l'avons exploré dans ce blog, le paysage de l'IA est en train d'être remodelé par l'avènement d'outils et de plateformes multimodales. De la synthèse vidéo révolutionnaire de Runway Gen-2 au moteur de caractères innovant d'Inworld AI, chaque outil apporte un ensemble unique de capacités qui repoussent les limites de ce que l'IA peut réaliser. Objective a révolutionné notre approche de la recherche de données, tandis qu'ImageBind a établi de nouvelles références en matière d'intégration et d'interprétation des données. Enfin, l'expansion de ChatGPT dans le domaine de la reconnaissance vocale et d'images témoigne de la nature évolutive de l'IA conversationnelle, qui devient plus polyvalente et plus conviviale.

Ces outils ne représentent pas seulement des avancées technologiques, mais un changement de paradigme dans la manière dont nous interagissons avec l'IA et l'utilisons. Ils démontrent l'immense potentiel de l'intégration de multiples types de données, ce qui permet de créer des systèmes d'IA plus riches, plus intuitifs et plus conscients du contexte. Au fur et à mesure de l'évolution de ces outils et de l'apparition de nouvelles innovations, nous pouvons nous attendre à des développements encore plus passionnants qui combleront le fossé entre l'intelligence humaine et l'intelligence de la machine.

L'avenir de l'IA est sans aucun doute multimodal, et ces outils ne sont que le début d'un voyage vers des systèmes plus holistiques, interactifs et intelligents. À mesure que nous avançons, les possibilités sont infinies et le potentiel de transformation des applications dans divers secteurs est immense. L'ère de l'IA multimodale est arrivée et promet de remodeler notre monde numérique.