10 errores comunes que conducen a prohibiciones de la API de OpenAI

Mantener el cumplimiento de las políticas de OpenAI es fundamental para cualquier desarrollador o empresa que utilice su API. No cumplirlas puede acarrear graves repercusiones, como la prohibición de utilizar la API, lo que puede interrumpir todas las operaciones de su empresa. Comprender estos peligros es clave para garantizar que su aplicación siga cumpliendo las normas y sea totalmente funcional. En este blog, exploraremos diez errores comunes que a menudo conducen a prohibiciones de la API, ayudándole a evitar estas trampas y salvaguardar su integración OpenAI.

Muchos desarrolladores y empresas tienden a pasar por alto prácticas básicas de cumplimiento, ya sea por falta de concienciación o por simples descuidos. Estos errores pueden parecer triviales, pero pueden agravarse rápidamente si no se abordan.

- 10 razones por las que sus API de OpenAI serán prohibidas

- 1. Ignorar el punto final de la moderación

- 2. Permitir la entrada de usuarios sin restricciones

- 3. Exposición de claves API

- 4. Falta de autenticación de los usuarios

- 5. Limitación de velocidad inadecuada

- 6. No controlar los patrones de uso

- 7. Ignorar los comentarios de OpenAI

- 8. Manejo deficiente de errores

- 9. No revisión periódica de las políticas

- 10. Uso de cuentas comprometidas

- Lo esencial

10 razones por las que sus API de OpenAI serán prohibidas

1. Ignorar el punto final de la moderación

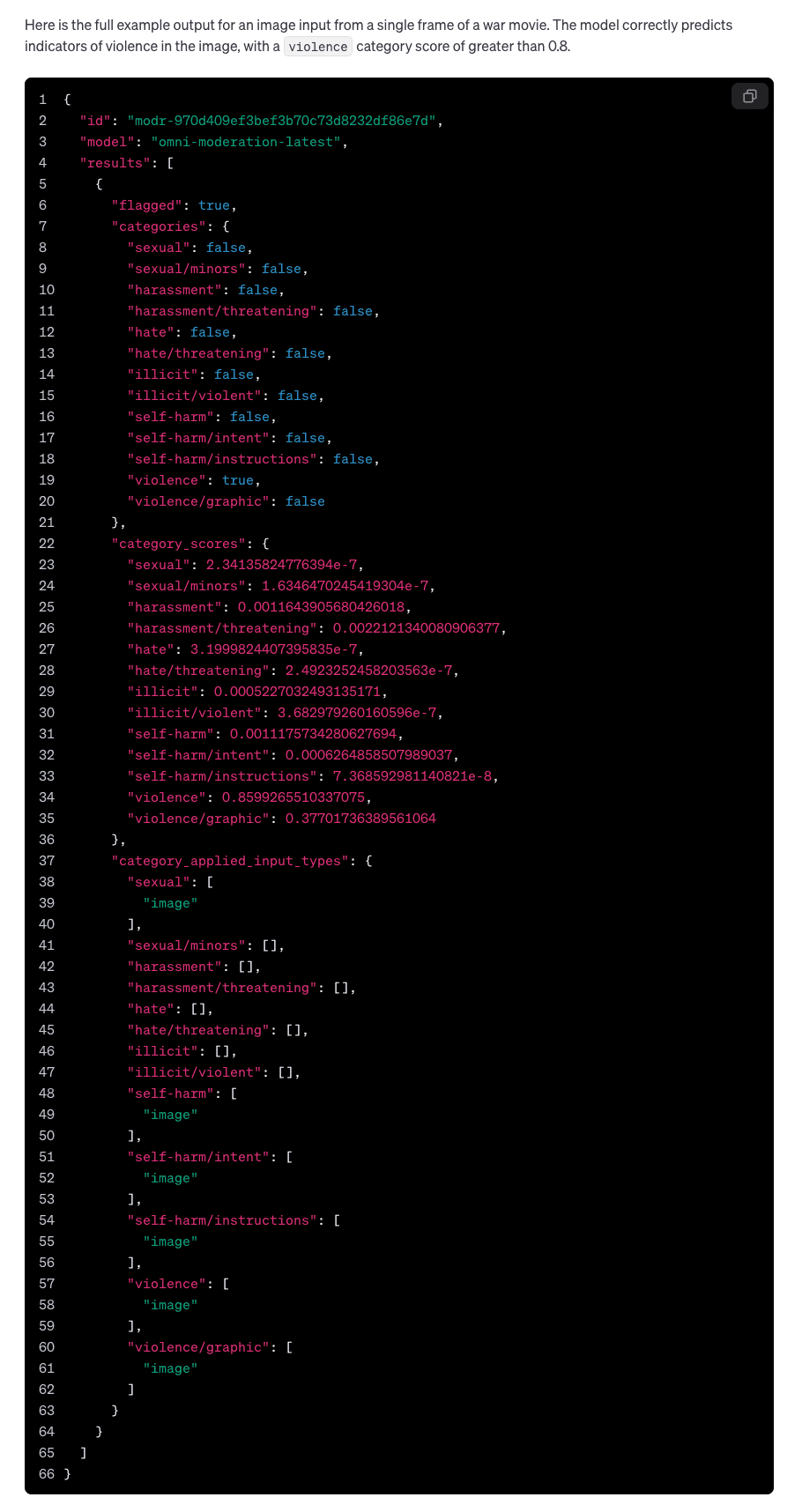

En punto final de moderación es una de las herramientas más importantes que proporciona OpenAI para ayudar a mantener el cumplimiento de las políticas de contenidos. Está diseñada para identificar contenidos dañinos o inapropiados antes de que sean procesados por la API, garantizando que las entradas se ajustan a las normas de OpenAI. Aprovechando este punto final, los desarrolladores pueden filtrar de forma proactiva el contenido que podría violar las directrices, minimizando el riesgo de infracciones de las políticas.

No utilizar el punto final de moderación puede dar lugar a infracciones inesperadas. Sin esta capa de moderación, el contenido dañino podría llegar a la API y desencadenar una infracción, que en última instancia podría dar lugar a sanciones o a una prohibición completa. El uso del punto final de moderación no sólo ayuda a mantener el cumplimiento, sino que también protege la reputación y la funcionalidad de su aplicación, por lo que es una herramienta indispensable para el uso responsable de la API.

2. Permitir la entrada de usuarios sin restricciones

Permitir entradas de usuario sin restricciones puede ser un riesgo importante cuando se trabaja con la API de OpenAI. Las entradas de los usuarios que no se controlan adecuadamente pueden contener contenido dañino o inapropiado, lo que puede dar lugar a infracciones de la política. Asegurarse de que las entradas están moderadas y controladas ayuda a mitigar los riesgos asociados con permitir a los usuarios dar rienda suelta a lo que envían a la API.

Si no se filtran las entradas de los usuarios, pueden enviarse contenidos que infrinjan las condiciones de servicio de OpenAI, como expresiones de odio o material explícito. Esto puede llevar a la suspensión de la cuenta, interrumpiendo los servicios e impactando negativamente en su negocio. Los desarrolladores deben aplicar técnicas sólidas de validación y moderación de entradas para garantizar que todos los envíos de los usuarios cumplen las políticas de uso.

3. Exposición de claves API

Asegurar las claves API es crucial cuando se integra con la API de OpenAI. La exposición de estas claves, especialmente en aplicaciones front-end, puede conducir a un uso no autorizado y a su explotación. Cuando las claves API están incrustadas en código público, los usuarios malintencionados pueden acceder fácilmente a ellas y hacer un uso indebido de la API, provocando cargos excesivos o incluso desencadenando infracciones que lleven a la prohibición de la cuenta.

Para evitar accesos no autorizados, las claves API deben almacenarse de forma segura, idealmente en variables de entorno o servidores backend protegidos. El uso de protocolos de seguridad adecuados y la rotación periódica de las claves pueden ayudar a proteger contra el uso indebido. Asegurar sus claves API garantiza que sólo los usuarios autorizados tengan acceso, reduciendo el riesgo de uso no autorizado que podría poner en peligro su acceso a los servicios de OpenAI.

4. Falta de autenticación de los usuarios

La autenticación de usuarios es un componente crítico en la gestión de quién puede acceder a su API. Permitir el acceso sin autenticación aumenta significativamente el riesgo de abuso, ya que no hay manera de rastrear o limitar el comportamiento del usuario de manera efectiva. Exigir una autenticación adecuada garantiza que cada usuario sea responsable de sus acciones, lo que facilita la identificación y prevención de comportamientos abusivos.

Sin autenticación de usuario, los malos actores pueden explotar su API, dando lugar a envíos de contenido que pueden violar los términos de servicio de OpenAI. Al aplicar medidas estrictas de autenticación, los desarrolladores pueden controlar el acceso, realizar un seguimiento del uso y responder rápidamente a cualquier comportamiento problemático, reduciendo así las posibilidades de uso indebido y las sanciones subsiguientes.

5. Limitación de velocidad inadecuada

La limitación de velocidad es esencial para controlar el flujo de solicitudes a su API. Evita que los usuarios envíen solicitudes excesivas, lo que puede dar lugar a un uso indebido o involuntario. Sin una limitación de velocidad adecuada, un solo usuario puede sobrecargar el sistema, causando potencialmente interrupciones del servicio o desencadenando una violación de los términos de servicio de OpenAI.

Implantar límites de velocidad garantiza que los usuarios no puedan saturar la API con demasiadas peticiones en un corto periodo de tiempo. Esto ayuda a mantener la estabilidad del sistema, distribuir los recursos equitativamente entre los usuarios y evitar que los usuarios malintencionados abusen del sistema. La limitación eficaz de la tasa es una estrategia clave para garantizar que su aplicación siga siendo conforme y estable.

6. No controlar los patrones de uso

Supervisar los patrones de uso de la API es una forma proactiva de identificar posibles abusos antes de que den lugar a sanciones. Al vigilar de cerca cómo se utiliza la API, los desarrolladores pueden detectar comportamientos inusuales, como un aumento repentino de solicitudes o intentos de enviar contenido dañino. Esta detección temprana puede ayudar a prevenir infracciones que, de otro modo, podrían llevar a la prohibición de una cuenta.

Descuidar la supervisión del uso facilita que las conductas abusivas pasen desapercibidas, lo que aumenta el riesgo de sanciones. Deben existir herramientas de supervisión y alertas que garanticen la detección inmediata de cualquier actividad irregular. Al mantenerse alerta, los desarrolladores pueden abordar los problemas de forma proactiva y mantener un entorno de uso de API saludable y conforme a las normas.

7. Ignorar los comentarios de OpenAI

OpenAI proporciona información y avisos cuando detecta posibles problemas con el uso de la API. Ignorar estas advertencias puede tener graves consecuencias, ya que indica una falta de respuesta a los problemas de cumplimiento. OpenAI puede proporcionar sugerencias o mandatos para corregir comportamientos problemáticos, y no actuar en consecuencia puede agravar la situación, dando lugar a sanciones o incluso a la suspensión de la cuenta.

Tomarse en serio los comentarios y actuar con prontitud puede evitar que problemas menores se conviertan en problemas importantes. Los desarrolladores deben asegurarse de que cuentan con procesos para revisar y abordar cualquier comentario de OpenAI. Este enfoque proactivo no solo ayuda a mantener el cumplimiento, sino que también demuestra un compromiso con el uso responsable de la API.

8. Manejo deficiente de errores

Una gestión clara de los errores es crucial a la hora de gestionar las interacciones de los usuarios con su API. Cuando se deniega la solicitud de un usuario debido a problemas de moderación de contenidos, es esencial proporcionar información que explique por qué se ha rechazado la solicitud. Sin esta orientación, los usuarios pueden sentirse frustrados e intentar soluciones alternativas, lo que podría dar lugar a nuevas infracciones.

Una gestión eficaz de los errores implica no sólo rechazar las solicitudes perjudiciales, sino también educar a los usuarios sobre cómo enviar contenidos conformes. Esto ayuda a reducir futuras infracciones y garantiza que los usuarios comprendan los límites establecidos por Política de OpenAI. Proporcionar instrucciones claras y sugerencias de medidas correctoras mejora la experiencia del usuario al tiempo que mantiene la conformidad.

9. No revisión periódica de las políticas

Las políticas de contenido de OpenAI evolucionan con el tiempo, y mantenerse al día con estos cambios es crucial para mantener el cumplimiento. Los desarrolladores que no revisen periódicamente estas políticas corren el riesgo de no ajustarse a las directrices actuales, lo que puede dar lugar a infracciones y sanciones involuntarias.

Las revisiones periódicas de las políticas deben formar parte de una estrategia de cumplimiento permanente. Esto garantiza que los procesos de moderación se actualizan para reflejar los requisitos más recientes, y que los desarrolladores son conscientes de cualquier cambio en las directrices de contenido aceptable. Mantenerse al corriente de las actualizaciones de las políticas ayuda a prevenir infracciones evitables y a mantener un acceso ininterrumpido a la API.

10. Uso de cuentas comprometidas

Permitir la creación de cuentas no verificadas o comprometidas puede dar lugar a graves problemas de cumplimiento. Las cuentas comprometidas pueden utilizarse para actividades maliciosas, como el envío de contenido dañino o el intento de explotar la API de formas que infrinjan las condiciones de servicio de OpenAI. Esto supone un riesgo importante no sólo para la API, sino también para la reputación de su aplicación.

Para mitigar este riesgo, los desarrolladores deben aplicar procesos de verificación estrictos para la creación de cuentas. Al garantizar que todas las cuentas son legítimas y están verificadas, se reduce la probabilidad de que actores maliciosos obtengan acceso. Proteger tu aplicación de cuentas comprometidas es un paso vital para mantener el cumplimiento y salvaguardar el acceso a tu API.

Lo esencial

Evitar estos diez errores comunes es esencial para garantizar el cumplimiento y mantener un acceso ininterrumpido a la API de OpenAI. Los desarrolladores y las empresas pueden crear un entorno de aplicaciones más seguro y fiable si abordan estos problemas de forma proactiva, como la seguridad de las claves de API, la implementación de límites de velocidad y la utilización del punto final de moderación. El cumplimiento no sólo consiste en evitar sanciones, sino también en crear una experiencia positiva para los usuarios y aprovechar al máximo las potentes capacidades de OpenAI.