10 erreurs courantes qui conduisent à l'interdiction des API de l'OpenAI

Le maintien de la conformité avec les politiques d'OpenAI est essentiel pour tout développeur ou entreprise utilisant son API. Le non-respect de ces règles peut entraîner de graves répercussions, y compris l'interdiction de l'API, ce qui peut perturber l'ensemble de vos activités commerciales. Il est essentiel de comprendre ces pièges pour s'assurer que votre application reste conforme et pleinement fonctionnelle. Dans ce blog, nous allons explorer dix erreurs courantes qui conduisent souvent à des interdictions d'API, afin de vous aider à éviter ces pièges et à protéger votre intégration OpenAI.

De nombreux développeurs et entreprises ont tendance à négliger les pratiques de base en matière de conformité, soit par manque de sensibilisation, soit par simple oubli. Ces erreurs peuvent sembler anodines, mais elles peuvent s'aggraver rapidement si elles ne sont pas corrigées.

- 10 raisons pour lesquelles vos API OpenAI seront interdites

- 1. Ignorer la finalité de la modération

- 2. Permettre à l'utilisateur d'introduire des données sans restriction

- 3. Exposition des clés API

- 4. Absence d'authentification de l'utilisateur

- 5. Limitation inadéquate du débit

- 6. Ne pas surveiller les habitudes d'utilisation

- 7. Ignorer le retour d'information de l'OpenAI

- 8. Mauvaise gestion des erreurs

- 9. Absence de révision régulière des politiques

- 10. Utilisation de comptes compromis

- Le bilan

10 raisons pour lesquelles vos API OpenAI seront interdites

1. Ignorer la finalité de la modération

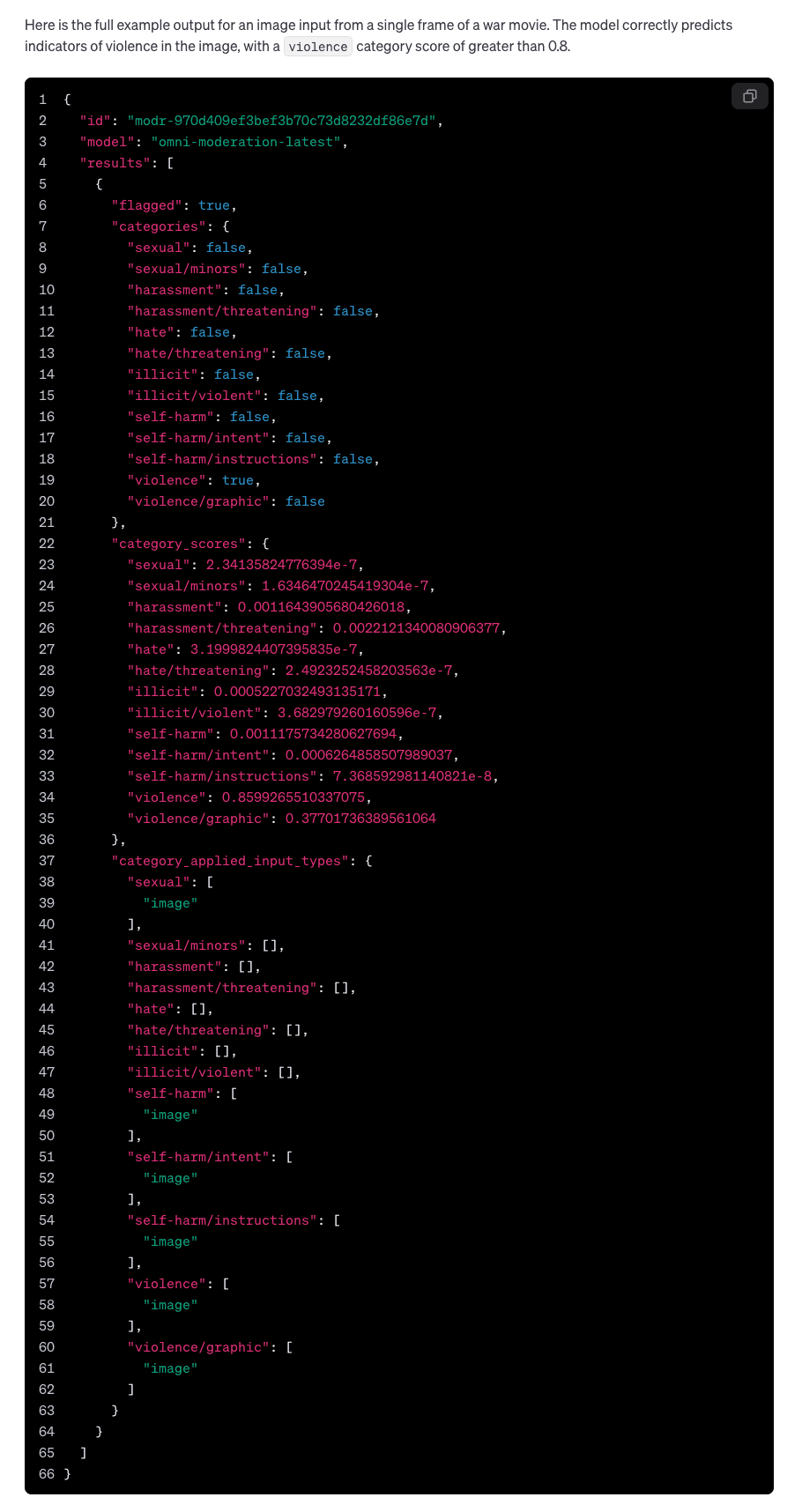

Les point final de la modération est l'un des outils les plus importants fournis par l'OpenAI pour aider à maintenir la conformité avec les politiques de contenu. Il est conçu pour identifier les contenus nuisibles ou inappropriés avant qu'ils ne soient traités par l'API, en s'assurant que les entrées sont conformes aux normes de l'OpenAI. En exploitant ce point d'accès, les développeurs peuvent filtrer de manière proactive les contenus susceptibles d'enfreindre les directives, minimisant ainsi le risque d'infractions à la politique.

Le fait de ne pas utiliser le point de terminaison de modération peut entraîner des violations inattendues. Sans cette couche de modération, un contenu préjudiciable pourrait atteindre l'API et déclencher une violation, qui pourrait finalement entraîner des pénalités ou une interdiction totale. L'utilisation du point de terminaison de modération permet non seulement de maintenir la conformité, mais aussi de protéger la réputation et la fonctionnalité de votre application, ce qui en fait un outil indispensable pour une utilisation responsable de l'API.

2. Permettre à l'utilisateur d'introduire des données sans restriction

L'autorisation d'une entrée utilisateur non restreinte peut constituer un risque majeur lorsque l'on travaille avec l'API de l'OpenAI. Les entrées des utilisateurs qui ne sont pas correctement contrôlées peuvent contenir des contenus nuisibles ou inappropriés, ce qui entraîne des violations potentielles de la politique. S'assurer que les entrées sont modérées et contrôlées permet d'atténuer les risques associés au fait de laisser les utilisateurs libres de ce qu'ils soumettent à l'API.

Le fait de ne pas filtrer les entrées des utilisateurs peut entraîner la soumission de contenus qui violent les conditions de service de l'OpenAI, tels que les discours haineux ou le matériel explicite. Cela peut conduire à la suspension du compte, perturber les services et avoir un impact négatif sur votre entreprise. Les développeurs doivent mettre en œuvre des techniques robustes de validation et de modération des entrées pour s'assurer que toutes les soumissions des utilisateurs sont conformes aux politiques d'utilisation.

3. Exposition des clés API

La sécurisation des clés d'API est cruciale lors de l'intégration avec l'API d'OpenAI. L'exposition de ces clés, en particulier dans les applications frontales, peut conduire à une utilisation et une exploitation non autorisées. Lorsque les clés d'API sont intégrées dans un code public, elles sont facilement accessibles aux utilisateurs malveillants qui peuvent utiliser l'API à mauvais escient, ce qui entraîne des frais excessifs ou même des violations qui conduisent à l'interdiction du compte.

Pour éviter tout accès non autorisé, les clés d'API doivent être stockées en toute sécurité, idéalement dans des variables d'environnement ou sur des serveurs dorsaux protégés. L'utilisation de protocoles de sécurité appropriés et la rotation régulière des clés peuvent contribuer à la protection contre les abus. La sécurisation de vos clés API garantit que seuls les utilisateurs autorisés y ont accès, réduisant ainsi le risque d'une utilisation non autorisée qui pourrait compromettre votre accès aux services d'OpenAI.

4. Absence d'authentification de l'utilisateur

L'authentification des utilisateurs est un élément essentiel de la gestion des personnes autorisées à accéder à votre API. L'autorisation d'un accès non authentifié augmente considérablement le risque d'abus, car il n'y a aucun moyen de suivre ou de limiter efficacement le comportement des utilisateurs. En exigeant une authentification appropriée, vous vous assurez que chaque utilisateur est responsable de ses actions, ce qui facilite l'identification et la prévention des comportements abusifs.

Sans authentification de l'utilisateur, de mauvais acteurs peuvent exploiter votre API, conduisant à des soumissions de contenu qui peuvent violer les conditions de service de l'OpenAI. En appliquant des mesures d'authentification strictes, les développeurs peuvent contrôler l'accès, suivre l'utilisation et répondre rapidement à tout comportement problématique, réduisant ainsi les risques d'utilisation abusive et les sanctions qui en découlent.

5. Limitation inadéquate du débit

La limitation du débit est essentielle pour contrôler le flux des demandes adressées à votre API. Elle empêche les utilisateurs de soumettre des requêtes excessives, ce qui peut conduire à une mauvaise utilisation ou à un abus involontaire. Sans une limitation de taux appropriée, un seul utilisateur peut surcharger le système, ce qui peut provoquer des interruptions de service ou déclencher une violation des conditions de service de l'OpenAI.

La mise en œuvre de limites de taux garantit que les utilisateurs ne peuvent pas submerger l'API avec un trop grand nombre de demandes dans un court laps de temps. Cela permet de maintenir la stabilité du système, de répartir équitablement les ressources entre les utilisateurs et d'empêcher les utilisateurs malveillants d'abuser du système. Une limitation de débit efficace est une stratégie clé pour garantir la conformité et la stabilité de votre application.

6. Ne pas surveiller les habitudes d'utilisation

La surveillance des schémas d'utilisation de l'API est un moyen proactif d'identifier les abus potentiels avant qu'ils n'entraînent des sanctions. En surveillant de près la façon dont l'API est utilisée, les développeurs peuvent détecter des comportements inhabituels, tels qu'une augmentation soudaine des demandes ou des tentatives de soumission de contenu nuisible. Cette détection précoce peut aider à prévenir les violations qui pourraient autrement conduire à l'interdiction d'un compte.

En négligeant le contrôle de l'utilisation, il est plus facile pour les comportements abusifs de passer inaperçus, ce qui augmente le risque de sanctions. Des outils de surveillance et des alertes doivent être mis en place pour s'assurer que toute activité irrégulière est immédiatement signalée. En restant vigilants, les développeurs peuvent traiter les problèmes de manière proactive et maintenir un environnement d'utilisation de l'API sain et conforme.

7. Ignorer le retour d'information de l'OpenAI

OpenAI fournit un retour d'information et des avertissements lorsqu'elle détecte des problèmes potentiels dans l'utilisation de l'API. Ignorer ces avertissements peut avoir de graves conséquences, car cela indique un manque de réactivité face aux problèmes de conformité. OpenAI peut fournir des suggestions ou des mandats pour corriger un comportement problématique, et le fait de ne pas agir en conséquence peut aggraver la situation, entraînant des pénalités ou même la suspension du compte.

Prendre le feedback au sérieux et agir rapidement peut éviter que des questions mineures ne deviennent des problèmes importants. Les développeurs doivent s'assurer qu'ils ont mis en place des processus pour examiner et traiter tout retour d'information de l'OpenAI. Cette approche proactive contribue non seulement à maintenir la conformité, mais démontre également un engagement en faveur d'une utilisation responsable de l'API.

8. Mauvaise gestion des erreurs

Une gestion claire des erreurs est cruciale lorsque vous gérez les interactions des utilisateurs avec votre API. Lorsque la demande d'un utilisateur est refusée en raison de problèmes de modération de contenu, il est essentiel de fournir un retour d'information qui explique pourquoi la demande a été rejetée. Sans ces conseils, les utilisateurs peuvent se sentir frustrés et tenter de trouver des solutions de contournement, ce qui peut entraîner d'autres violations.

Un traitement efficace des erreurs ne consiste pas seulement à rejeter les demandes nuisibles, mais aussi à apprendre aux utilisateurs comment soumettre un contenu conforme. Cela permet de réduire les violations futures et de s'assurer que les utilisateurs comprennent les limites fixées par le Politiques de l'OpenAI. Des instructions claires et des suggestions d'actions correctives améliorent l'expérience de l'utilisateur tout en préservant la conformité.

9. Absence de révision régulière des politiques

Les politiques de contenu de l'OpenAI évoluent au fil du temps, et il est essentiel de se tenir au courant de ces changements pour rester en conformité. Les développeurs qui n'examinent pas régulièrement ces politiques risquent de ne plus s'aligner sur les directives actuelles, ce qui peut entraîner des violations involontaires et des sanctions.

Des révisions régulières des politiques devraient faire partie d'une stratégie de conformité permanente. Cela permet de s'assurer que les processus de modération sont mis à jour pour refléter les exigences les plus récentes et que les développeurs sont au courant de tout changement dans les directives relatives aux contenus acceptables. Se tenir au courant des mises à jour de la politique permet d'éviter les violations évitables et de maintenir un accès ininterrompu à l'API.

10. Utilisation de comptes compromis

Permettre la création de comptes non vérifiés ou compromis peut entraîner de graves problèmes de conformité. Les comptes compromis peuvent être utilisés pour des activités malveillantes, telles que la soumission de contenu nuisible ou la tentative d'exploitation de l'API d'une manière qui viole les conditions de service de l'OpenAI. Cela représente un risque important non seulement pour l'API, mais aussi pour la réputation de votre application.

Pour atténuer ce risque, les développeurs doivent appliquer des processus de vérification stricts pour la création de comptes. En veillant à ce que tous les comptes soient légitimes et vérifiés, vous réduisez la probabilité que des acteurs malveillants y accèdent. La protection de votre application contre les comptes compromis est une étape essentielle du maintien de la conformité et de la protection de l'accès à votre API.

Le bilan

Il est essentiel d'éviter ces dix erreurs courantes pour garantir la conformité et maintenir un accès ininterrompu à l'API d'OpenAI. En s'attaquant de manière proactive à ces pièges - comme la sécurisation des clés d'API, la mise en œuvre de limites de taux et l'utilisation du point final de modération - les développeurs et les entreprises peuvent créer un environnement d'application plus sûr et plus fiable. La conformité ne consiste pas seulement à éviter les sanctions, mais aussi à créer une expérience positive pour les utilisateurs et à tirer le meilleur parti des puissantes capacités d'OpenAI.