AI&YOU #31: Die Bedeutung von multimodaler KI + zu berücksichtigende Tools und Plattformen

Statistik der Woche: Ein Drittel der Organisationen hat die Generative AI in mindestens einer Unternehmensfunktion. (McKinsey)

In dieser Ausgabe fassen wir die Erkenntnisse aus 3 Artikeln zusammen, die wir diese Woche veröffentlicht haben, und beleuchten sie unser Blog wie wir die Bedeutung der multimodalen KI diskutieren.

Die Bedeutung von multimodaler KI

5 Wege, wie Ihr Unternehmen können ChatGPT verwenden Vision

Top 5 Multimodale AI-Werkzeuge und Plattformen

Fragen Sie sich, wie Sie die Größe und Produktivität Ihres Unternehmens mit KI steigern können? Benötigen Sie einen Teil der KI-Hilfe, um Ihr derzeitiges Team zu unterstützen, oder wissen Sie nicht einmal, wo Sie anfangen sollen, aber Sie wissen, dass es wichtig ist? Wir sind hier, um zu helfen. Vereinbaren Sie noch heute einen Vorstellungstermin!

- AI&YOU#30: Die Bedeutung von multimodaler KI + zu berücksichtigende Tools und Plattformen

- Abgrenzung zu unimodalen AI-Systemen

- Die Grenzen von unimodalen KI-Systemen

- Wie wir zu multimodalen Lern- und KI-Modellen gekommen sind

- Auswirkungen der multimodalen KI in der realen Welt

- 5 Möglichkeiten, wie Ihr Unternehmen ChatGPT Vision nutzen kann

- Die 5 wichtigsten multimodalen AI-Tools und -Plattformen

AI&YOU#30: Die Bedeutung von multimodaler KI + zu berücksichtigende Tools und Plattformen

Die künstliche Intelligenz hat sich seit ihren Anfängen erheblich weiterentwickelt und ist von einfachen, regelbasierten Algorithmen zu komplexeren Systemen übergegangen, die bestimmte Aspekte der menschlichen Intelligenz genau nachahmen.

Ein entscheidender Schritt in dieser Entwicklung ist das Aufkommen der multimodalen KI, die einen großen Fortschritt in diesem Bereich darstellt.

Multimodale KI unterscheidet sich von der traditionellen KI durch ihre Fähigkeit, mehrere Arten von Dateneingaben - wie Text, Bilder und Töne - gleichzeitig zu verarbeiten und zu interpretieren.

Dieser Ansatz spiegelt eher wider, wie Menschen mit der Welt interagieren, indem sie eine Kombination von Sinneseindrücken nutzen.

Der Kern der multimodalen KI liegt in ihrer Fähigkeit, Daten aus verschiedenen Modalitäten zu verarbeiten und zu analysieren, einschließlich:

Text: Entnehmen und Interpretieren von Informationen aus der Schriftsprache.

Bilder: Analyse von visuellen Elementen auf Fotos oder Videos.

Geräusche: Verstehen von Audio-Eingängen, von Sprache bis hin zu Umgebungsgeräuschen.

Durch die Kombination dieser Modalitäten erhält ein multimodales KI-System eine ganzheitlichere Sichtweise, die es ihm ermöglicht, fundiertere und kontextbezogenere Entscheidungen zu treffen.

Abgrenzung zu unimodalen AI-Systemen

Herkömmliche KI-Systeme, die oft als unimodale Systeme bezeichnet werden, sind auf die Verarbeitung von Daten aus einer einzigen Modalität beschränkt. Eine textbasierte KI kann beispielsweise nur geschriebene Sprache verstehen und darauf reagieren, während eine BilderkennungskI sich ausschließlich auf visuelle Daten konzentriert.

Multimodale KI-Systeme hingegen überbrücken diese Lücke, indem sie diese verschiedenen Modalitäten kombinieren. Diese Integration verbessert nicht nur das Verständnis des Systems, sondern ermöglicht auch die Durchführung von Aufgaben, die ein multisensorisches Verständnis erfordern, wie z. B. die Identifizierung von Objekten in einem Video bei gleichzeitigem Verständnis des Kontexts aus begleitenden Audio- oder Textbeschreibungen.

Die Grenzen von unimodalen KI-Systemen

Unimodalen KI-Systemen sind erhebliche Grenzen gesetzt. Sie können zwar in ihrem spezifischen Bereich sehr effektiv sein, aber ihr singulärer Fokus kann zu Lücken im Verständnis und in der Interpretation führen. Diese Einschränkung wird deutlich, wenn diese Systeme mit Szenarien konfrontiert werden, die ein umfassenderes Verständnis erfordern, das sich über verschiedene Datentypen erstreckt.

Eine der größten Herausforderungen bei der unimodalen KI ist die Unfähigkeit, die komplexe sensorische Verarbeitung des Menschen nachzuahmen. Der Mensch nutzt eine Kombination von Sinnen - Sehen, Hören, Tasten, Schmecken und Riechen - um die Welt wahrzunehmen und mit ihr zu interagieren. Dieser multisensorische Ansatz ermöglicht ein umfassenderes und differenzierteres Verständnis unserer Umwelt.

Wie wir zu multimodalen Lern- und KI-Modellen gekommen sind

Die multimodale KI hat in den letzten Jahren erhebliche Fortschritte gemacht, vor allem durch die Verbesserung von KI-Modellen, die mehrere Arten von Daten verarbeiten und interpretieren können.

Multimodale KI-Schlüsseltechnologien:

Verarbeitung natürlicher Sprache (NLP): NLP hat sich so entwickelt, dass es nicht nur geschriebene und gesprochene Sprache versteht, sondern auch den Kontext und die Nuancen interpretieren kann, wenn es mit Daten aus verschiedenen Quellen kombiniert wird.

Bild- und Videoanalyse: KI-Modelle können nun visuelle Medien genauer analysieren und den Inhalt und den Kontext verstehen, insbesondere wenn sie mit textlichen Beschreibungen kombiniert werden.

Spracherkennung und -verarbeitung: Dank der verbesserten Spracherkennung können KI-Systeme gesprochene Sprache genauer verstehen, einschließlich Tonfall und emotionalem Kontext.

Auswirkungen der multimodalen KI in der realen Welt

Die Integration von multimodaler KI revolutioniert zahlreiche Branchen, indem sie ausgefeiltere und kontextbezogene Lösungen bietet.

Gesundheitswesen: Verbessert die Diagnosegenauigkeit und die Patientenversorgung durch Datenintegration und Analyse verbaler/nonverbaler Hinweise.

Einzelhandel und Kundendienst: Bietet personalisierte Erlebnisse durch die Analyse von Kundenanfragen, einschließlich Stimme und Gesichtsausdruck, und die Kombination von Text-, Browsing- und visuellen Daten für Produktempfehlungen.

Bildung: Erstellt anpassungsfähige und interaktive Lernmaterialien, die auf den individuellen Stil zugeschnitten sind, und analysiert das Engagement der Schüler, um den Unterricht zu verbessern.

Sicherheit und Bewachung: Verbessert die Überwachungsmöglichkeiten durch die Analyse von Video-, Audio- und Sensordaten zur genauen Erkennung von Bedrohungen und zur umfassenden Analyse von Vorfällen.

Dies sind nur einige der vielen Branchen, die von multimodaler KI betroffen sind.

Lesen Sie unseren Blog: "Was ist multimodale KI + Anwendungsfälle für multimodale KI“

5 Möglichkeiten, wie Ihr Unternehmen ChatGPT Vision nutzen kann

Wenn OpenAI Als ChatGPT Vision veröffentlicht wurde, war dies eine bahnbrechende Entwicklung, die die Fähigkeiten von ChatGPT in ein multimodales KI-System verwandelt. Diese innovative Funktion erweitert die Fähigkeiten von ChatGPT über textbasierte Interaktionen hinaus und ermöglicht es, Bilder zu interpretieren und zu analysieren, was neue Möglichkeiten für Unternehmen eröffnet.

Hier sind 5 Möglichkeiten, wie Ihr Unternehmen ChatGPT Vision nutzen kann:

Verbesserter Kundensupport und Fehlerbehebung: Verbessert den Kundenservice durch bildbasierte Problemerkennung und optimierte Fehlerbehebung, was zu einer schnelleren Lösung, weniger Fehlkommunikation und einem besseren Kundenerlebnis führt.

Fortgeschrittenes UI/UX-Feedback für Produktdesign: Revolutioniert das Design-Feedback durch die Analyse von Bildmaterial zur Verbesserung von UI/UX, unterstützt die schnelle Design-Iteration und verbessert die Reaktionsfähigkeit auf dem Markt.

3. Rationalisierte Dokumentation und Anleitung Vereinfacht den Zugriff auf die Dokumentation und verbessert die Tutorials durch intuitive visuelle Interaktionen, wodurch der Benutzersupport effektiver und benutzerfreundlicher wird.

Personalisiertes Feature Onboarding und Benutzerschulung: Bietet maßgeschneiderte Onboarding- und Schulungserfahrungen durch die Analyse von Benutzerinteraktionen mit neuen Funktionen und verbessert so die Lerneffizienz und das Engagement der Benutzer.

Wettbewerbsanalyse und Markteinblicke: Bietet detaillierte Produktanalysen von Mitbewerbern und Markteinblicke durch visuelle Daten, die als Grundlage für strategische Entscheidungen dienen und Unternehmen einen Vorsprung auf dem Markt sichern.

Lesen Sie unseren Blog: "5 Möglichkeiten, wie Ihr Unternehmen ChatGPT Vision nutzen kann“

Die 5 wichtigsten multimodalen AI-Tools und -Plattformen

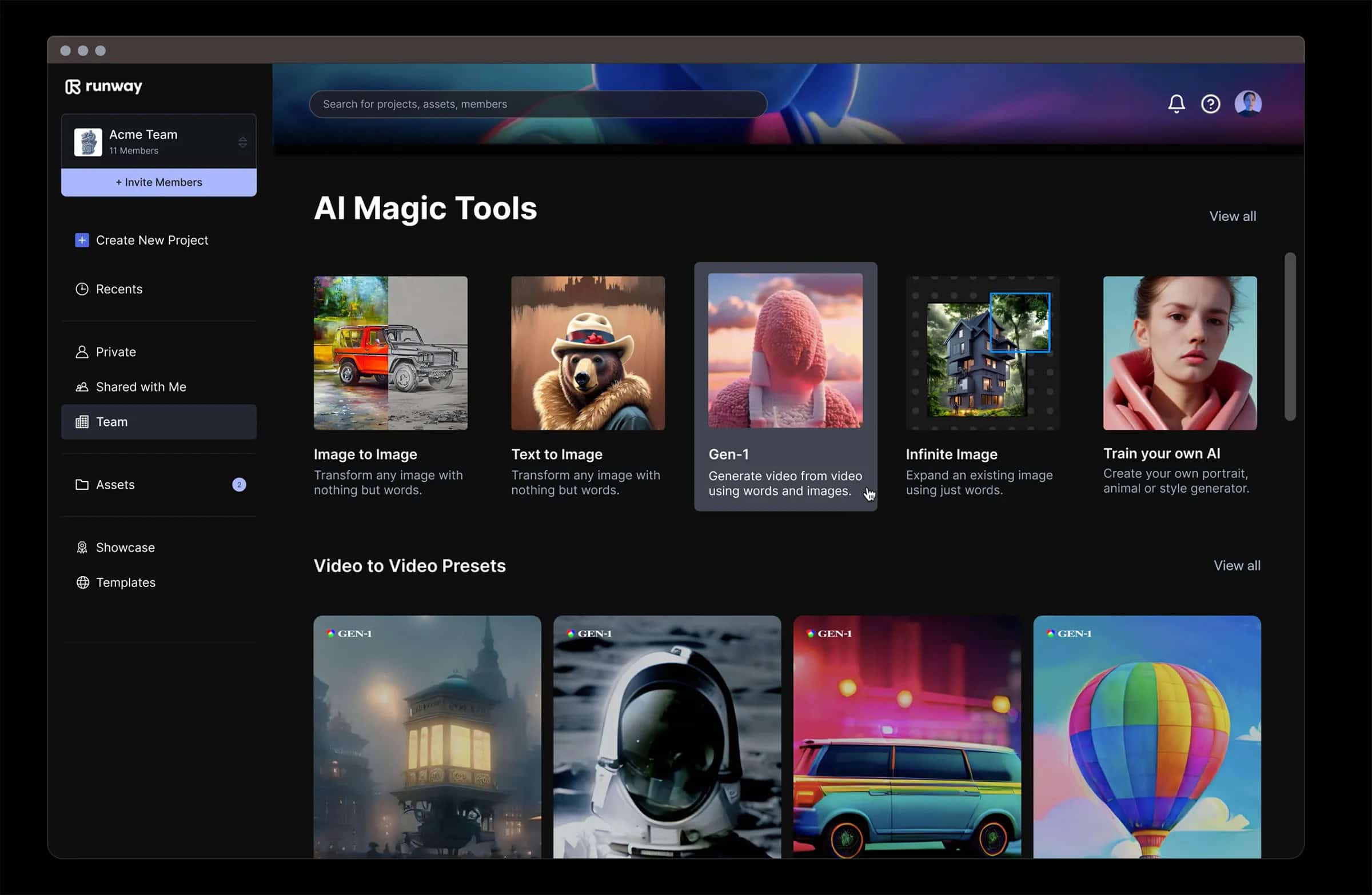

Diese Woche haben wir uns auch 5 der besten multimodalen KI-Tools und -Plattformen angesehen, mit besonderem Augenmerk auf einige große Namen wie Startbahn Gen-2 und ChatGPT.

1. Startbahn Gen-2

2. ImageBind von Meta

3. ChatGPT

4. KI in der Welt

5. Zielsetzung (ehemals Kailua Labs)

In diesem Newsletter wollen wir uns die #1 auf unserer Liste genauer ansehen: Startbahn Gen-2.

Runway Gen-2 markiert eine bedeutende Entwicklung im Bereich der generative KIinsbesondere bei der Video- und Bildsynthese. Dieses Tool demonstriert die Leistungsfähigkeit der multimodalen KI, indem es den Nutzern ermöglicht, neuartige Videos mit einer Mischung aus Text, Bildern oder Videoclips zu erstellen.

Runway Gen-2 ermöglicht es Ihnen, präzise, realistische und kontrollierbare Multimedia-Ausgaben zu erstellen, die die Grenzen der digitalen Kreativität erweitern.

Die neuesten Gen-2-Updates sind besonders bemerkenswert, weil sie die Wiedergabetreue und Konsistenz der produzierten Videos erheblich verbessern. Dieser Qualitätssprung hat in der KI-Community Aufsehen erregt und wird von den Nutzern als ein entscheidender Moment in der Entwicklung der generativen und multimodalen KI bezeichnet.

Die Fähigkeit des Tools, aus einfachen Textanweisungen, Bildern oder vorhandenen Videos vollständige Videos zu erstellen, ist eine bahnbrechende Funktion, die neue Möglichkeiten für das Geschichtenerzählen und die digitalen Medien bietet.

Die Zukunft der KI ist zweifellos multimodal, und Tools wie Runway und die anderen auf unserer Liste sind erst der Anfang einer Reise zu ganzheitlicheren, interaktiven und intelligenten Systemen.

Lesen Sie unseren Blog: "Die 5 wichtigsten multimodalen KI-Tools und -Plattformen“

Danke, dass Sie sich die Zeit genommen haben, AI & YOU zu lesen!

*Skim AI ist ein Beratungsunternehmen für Künstliche Intelligenz, das AI-Beratung & Entwicklungsdienstleistungen für Unternehmen seit 2017.

*Chatten Sie mit mir über Enterprise AI

*Für noch mehr Inhalt über Unternehmens-KIeinschließlich Infografiken, Statistiken, Anleitungen, Artikeln und Videos, folgen Sie Skim AI auf LinkedIn

BITTE MÖGEN, ABONNIEREN UND TEILEN!