メタのラマ3.1:オープンソースAIの限界に挑む

メタは最近、次のように発表した。 ラマ 3.1このリリースは、これまでで最も先進的なオープンソースの大規模言語モデル(LLM)です。このリリースは、AI技術の民主化における重要なマイルストーンであり、オープンソースとプロプライエタリモデルの間のギャップを埋める可能性があります。

Llama 3.1は、オープンソースのAI機能において大きな飛躍を遂げた。4,050億パラメータのフラッグシップモデルにより、Metaは最先端のAIはクローズドソースでプロプライエタリでなければならないという概念に挑戦している。このリリースは、最先端のAI機能が研究者、開発者、そしてあらゆる規模の企業にアクセス可能な新しい時代を告げるものです。

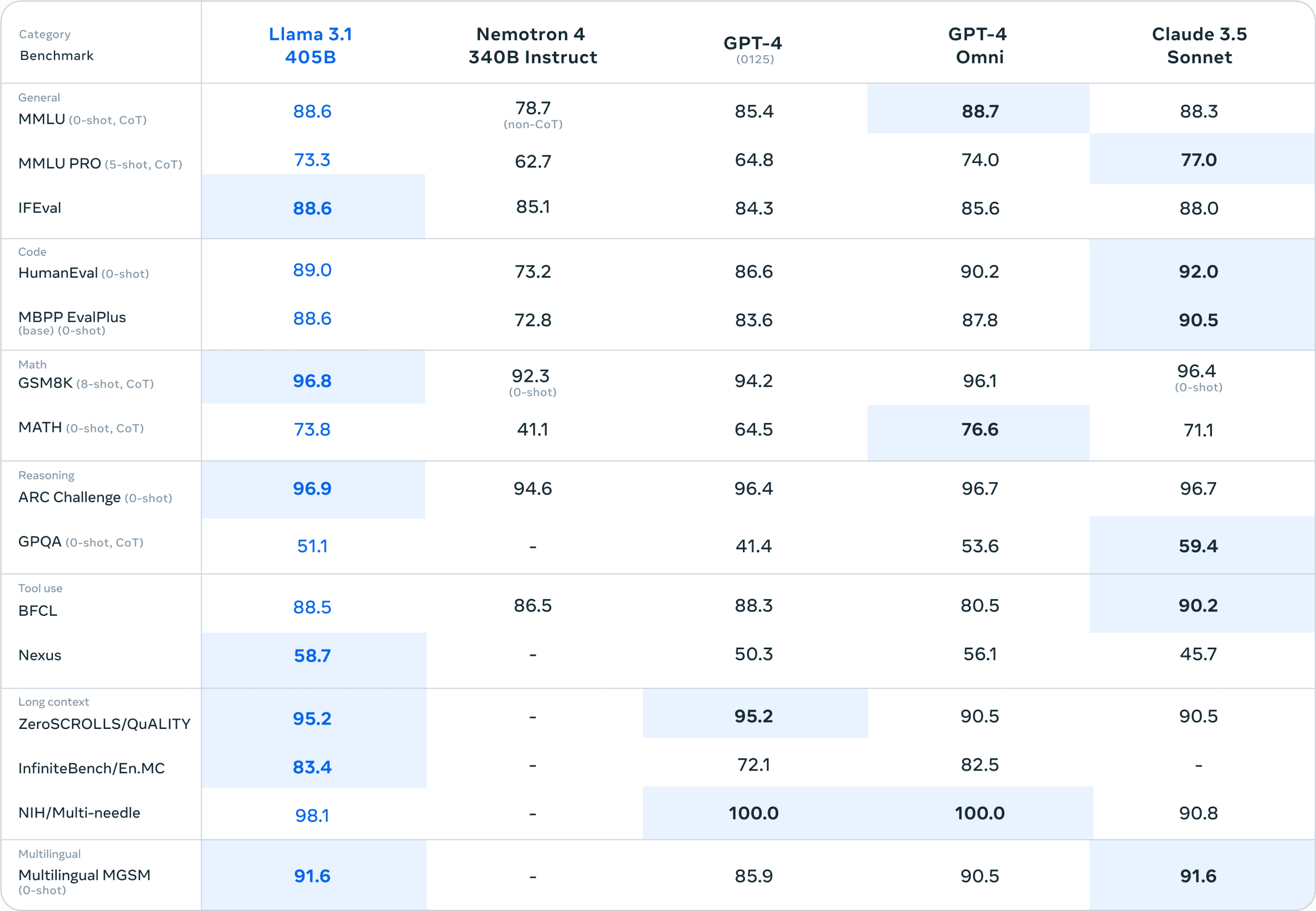

Llama 3.1の主な改良点には、128,000トークンに拡張されたコンテキスト長、8言語のサポート、推論、数学、コード生成などの分野における比類ないパフォーマンスが含まれます。これらの進歩により、Llama 3.1は、企業環境におけるさまざまなドメインにわたる複雑な実世界のタスクに取り組むことができる多用途ツールとして位置づけられます。

ラマの進化:2から3.1へ

Llama 3.1の重要性を理解するには、その前身を見直す価値がある。2023年にリリースされたLlama 2は、オープンソースのAIにおいてすでに大きな一歩を踏み出していた。7Bから70Bのパラメータを持つモデルを提供し、さまざまなベンチマークで競争力のあるパフォーマンスを示した。

Llama 3.1は、この基盤の上に、いくつかの重要な改良が加えられています:

モデルサイズの拡大: 405Bパラメータモデルの導入は、オープンソースAIで可能なことの限界を押し広げるものだ。

コンテキストの長さを延長: Llama 2の4KトークンからLlama 3.1の128Kトークンになり、より複雑でニュアンスのある長いテキストの理解が可能になりました。

多言語対応: 言語サポートが拡大されたことで、さまざまな地域やユースケースでより多様なアプリケーションに対応できるようになった。

推理力の向上と専門的な作業: 数学的推論やコード生成などの分野でパフォーマンスが向上。

GPT-4やクロード3.5ソネットのようなクローズドソースモデルと比較した場合、ラマ3.1 405Bはさまざまなベンチマークで独自の地位を保っている。オープンソースモデルでこのレベルの性能は前例がない。

ラマ3.1の技術仕様

技術的な詳細に飛び込むと、Llama 3.1は、さまざまなニーズや計算リソースに対応できるよう、さまざまなモデルサイズを提供している:

8Bパラメータモデル: 軽量アプリケーションやエッジデバイスに適している。

70Bパラメータモデル: パフォーマンスとリソース要件のバランス。

405Bパラメータモデル: オープンソースのAI能力の限界に挑むフラッグシップモデル。

Llama 3.1のトレーニング方法には、15兆トークンを超える膨大なデータセットが使用されました。この膨大な学習データが、洗練されたデータキュレーションと前処理技術と相まって、モデルの性能と汎用性の向上に寄与しています。

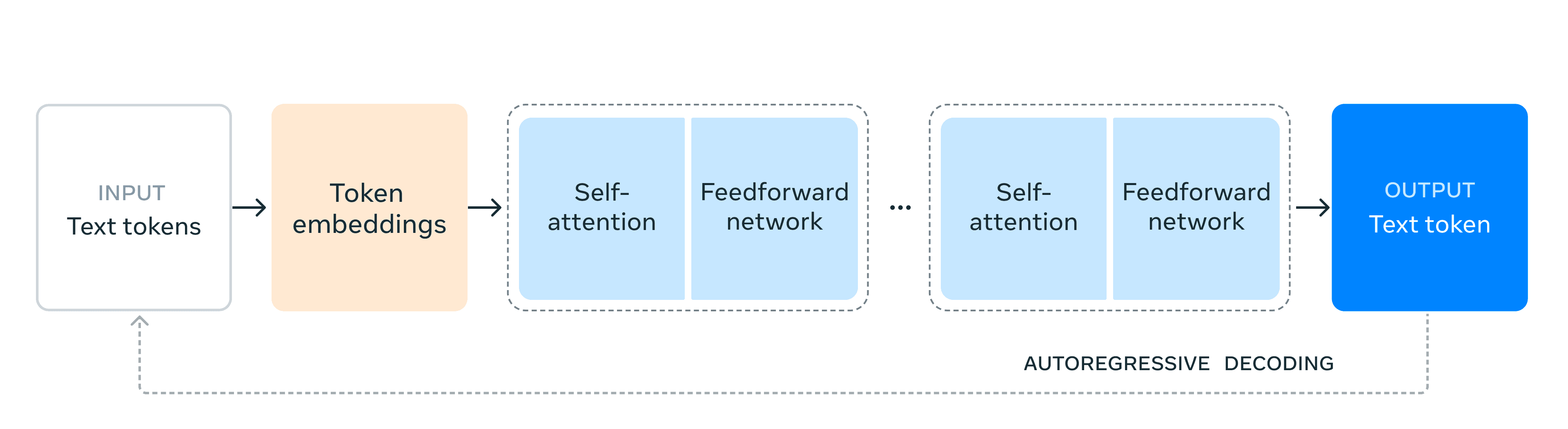

アーキテクチャ上、Llama 3.1はデコーダのみの変換モデルを維持し、mixture-of-expertsのような実験的アプローチよりも学習の安定性を優先している。しかし、Metaはこの前例のないスケールで効率的な学習と推論を可能にするためにいくつかの最適化を実装している:

スケーラブルなトレーニングインフラ: 405Bモデルのトレーニングに16,000以上のH100 GPUを使用。

反復的なポストトレーニングの手順: 特定の能力を強化するために、教師ありの微調整と直接選好最適化を採用。

量子化技術: より効率的な推論のためにモデルを16ビットから8ビットの数値に減らし、シングルサーバーノードでの展開を可能にした。

これらの技術的な選択は、モデルサイズの限界に挑戦することと、さまざまな配備シナリオにおいて実用的な使い勝手を確保することのバランスを反映したものである。

これらの高度なモデルをオープンにすることで、メタ社は単に製品を共有するだけでなく、イノベーションのためのプラットフォームを提供している。Llama 3.1の技術仕様は、研究者や開発者が最先端のAIアプリケーションを探求するための新たな可能性を開き、業界全体のAI進歩のペースを加速させます。

画期的な能力

Llama 3.1には、AI業界をリードする画期的な機能がいくつか導入されている:

拡張コンテキストの長さ

128Kのトークン・コンテキスト・ウィンドウへのジャンプは画期的だ。この拡張された容量によって、Llama 3.1はより長いテキストを処理し、理解することができるようになった:

包括的な文書分析

長編コンテンツの生成

よりニュアンスのある会話対応

この機能は、法的文書処理、文献分析、大量の情報を保持し合成する必要がある複雑な問題解決などの分野での応用に新たな可能性を開く。

多言語サポート

Llama 3.1は8ヶ国語をサポートし、そのグローバルな適用範囲を大幅に広げました。この多言語機能は

異文化コミュニケーションの強化

より包括的なAIアプリケーションを可能にする

グローバルな事業運営をサポート

言語の壁を取り払うことで、Llama 3.1はより多様でグローバル志向のAIソリューションへの道を開く。

高度な推論と道具の使用

このモデルは、洗練された推論能力と外部ツールを効果的に使用する能力を示している。この進歩は次のような形で現れる:

論理的推理力と問題解決力の向上

複雑な指示に従う能力の向上

外部のナレッジベースやAPIの有効活用

これらの機能により、Llama 3.1は、戦略的プランニングから複雑なデータ分析まで、高度な認知スキルを必要とするタスクに対応する強力なツールとなっている。

コード生成と数学の才能

ラマ3.1は、技術的な領域で目覚ましい能力を発揮している:

複数のプログラミング言語にわたる高品質で機能的なコードの生成

複雑な数学的問題を正確に解く

アルゴリズム設計と最適化の支援

これらの機能により、Llama 3.1は、ソフトウェア開発、科学計算、エンジニアリング・アプリケーションにとって価値ある資産となる。

オープンソースの優位性

Llama 3.1のオープンソースの性質は、いくつかの重要な利点をもたらす。

フロンティアレベルのAI能力を自由に利用できるようにすることで、メタはそうなる:

AI研究開発への参入障壁を下げる

小規模な組織や個人の開発者が高度なAIを活用できるようにする

より多様で革新的なAIエコシステムの育成

このような民主化は、様々な分野でのAIアプリケーションの普及につながり、技術の進歩を加速させる可能性がある。

Llama 3.1のモデルウェイトにアクセスし、変更することができるため、カスタマイズの機会がこれまでになく広がります:

特化した産業のための領域別適応

独自のユースケースやデータセットに合わせた微調整

新しいトレーニング技術とアーキテクチャの実験

この柔軟性により、組織はそれぞれのニーズに合わせてモデルを調整することができ、より効果的で効率的なAIソリューションにつながる可能性がある。

エコシステムと展開

Llama 3.1のリリースは、その展開と利用をサポートする強固なエコシステムを伴っている:

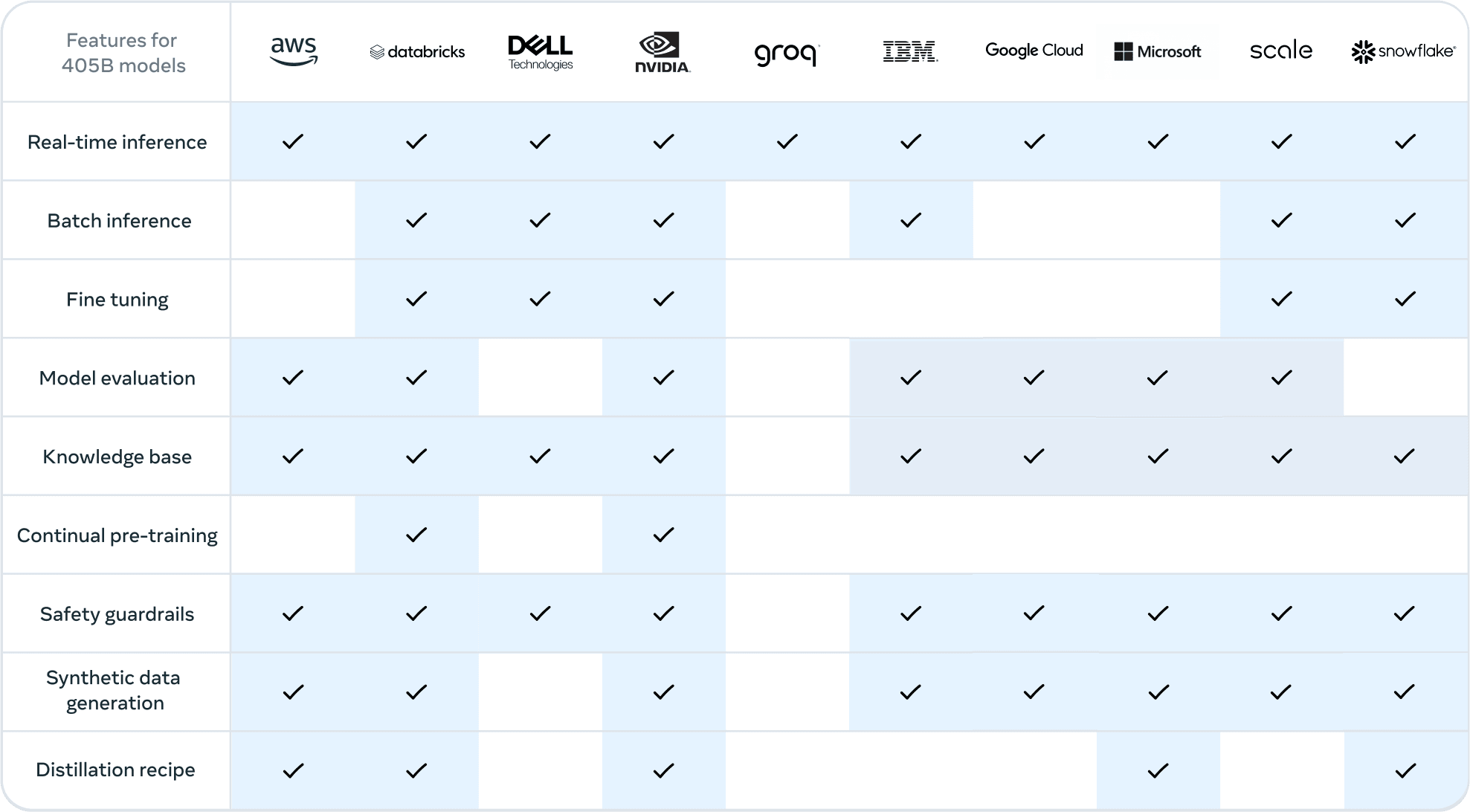

パートナーとの統合

Metaは、Llama 3.1を幅広くサポートするために、業界のリーダーたちと協力してきた:

AWS、Google Cloud、Azureなどのクラウドプロバイダーは、シームレスなデプロイメントオプションを提供します。

エヌビディアやデルなどのハードウェア・メーカーは、最適化されたインフラを提供する。

DatabricksやSnowflakeのようなデータプラットフォームは、効率的なデータ処理とモデル統合を可能にします。

これらのパートナーシップにより、組織は既存の技術スタック内でLlama 3.1を活用できるようになる。

推論の最適化とスケーラビリティ

Llama 3.1を実世界のアプリケーションで実用的なものにするために、いくつかの最適化が行われた:

量子化技術によりモデルの計算量を削減

vLLMやTensorRTのような最適化された推論エンジンがパフォーマンスを高める

エッジデバイスからデータセンターまで、さまざまなユースケースに対応するスケーラブルな導入オプション

これらの最適化により、405Bのパラメータ・モデルであっても本番環境での導入が可能になった。

ラマ・スタックと標準化への取り組み

メタはAIエコシステムの標準化を推進している:

提案されているLlama Stackは、AIコンポーネントの共通インターフェースを作ることを目的としている。

標準化されたAPIは、異なるAIツールやプラットフォーム間の統合や相互運用を容易にする。

このイニシアティブは、よりまとまりのある効率的なAI開発エコシステムにつながる可能性がある。

ラマ3.1の期待と可能性

MetaのLlama 3.1のリリースは、AIの展望において極めて重要な瞬間であり、フロンティアレベルのAI能力へのアクセスを民主化する。最先端のパフォーマンス、多言語サポート、拡張されたコンテキストの長さを持つ405Bのパラメータモデルを、すべてオープンソースのフレームワークで提供することで、Metaはアクセス可能でパワフルなAIの新たな基準を打ち立てた。この動きは、クローズドソースモデルの優位性に挑戦するだけでなく、AIコミュニティにおける前例のないイノベーションとコラボレーションへの道を開くものです。

AI開発の岐路に立つ私たちにとって、Llama 3.1は単なる技術的進歩にとどまらず、よりオープンで包括的、そしてダイナミックな人工知能の未来像を体現しています。このリリースの真のインパクトは、世界中の開発者、研究者、企業がその可能性を活用し、業界を再形成し、LLMで可能なことの限界を押し広げることで明らかになるでしょう。