¿Qué es el estímulo de la cadena de pensamiento?

Los grandes modelos lingüísticos (LLM) demuestran notables capacidades en el procesamiento y la generación de lenguaje natural (PLN). Sin embargo, cuando se enfrentan a tareas de razonamiento complejas, estos modelos pueden tener dificultades para producir resultados precisos y fiables. Aquí es donde entra en juego la inducción de la cadena de pensamiento (CoT), que ofrece una potente técnica para mejorar la capacidad de resolución de problemas de los LLM.

- Comprender el estímulo de la cadena de pensamiento

- Mecánica del estímulo de la cadena de pensamiento

- Aplicaciones del estímulo de la cadena de pensamiento

- Ventajas de la aplicación de CoT Prompting

- Limitaciones y consideraciones

- Conclusión sobre el fomento del TdC

- Preguntas más frecuentes (FAQ)

- 1. ¿Cómo mejora la cadena de pensamiento la precisión de los modelos lingüísticos?

- 2. ¿Se puede utilizar el estímulo de la cadena de pensamiento para otras tareas además de la aritmética y los puzzles lógicos?

- ¿Cuáles son algunos de los retos más comunes a la hora de poner en práctica la incitación a la cadena de pensamiento?

- ¿En qué se diferencia Auto-CoT de la inducción tradicional de la cadena de pensamiento?

- ¿Existe algún modelo lingüístico específico que funcione mejor con la inducción de la cadena de pensamiento?

Comprender el estímulo de la cadena de pensamiento

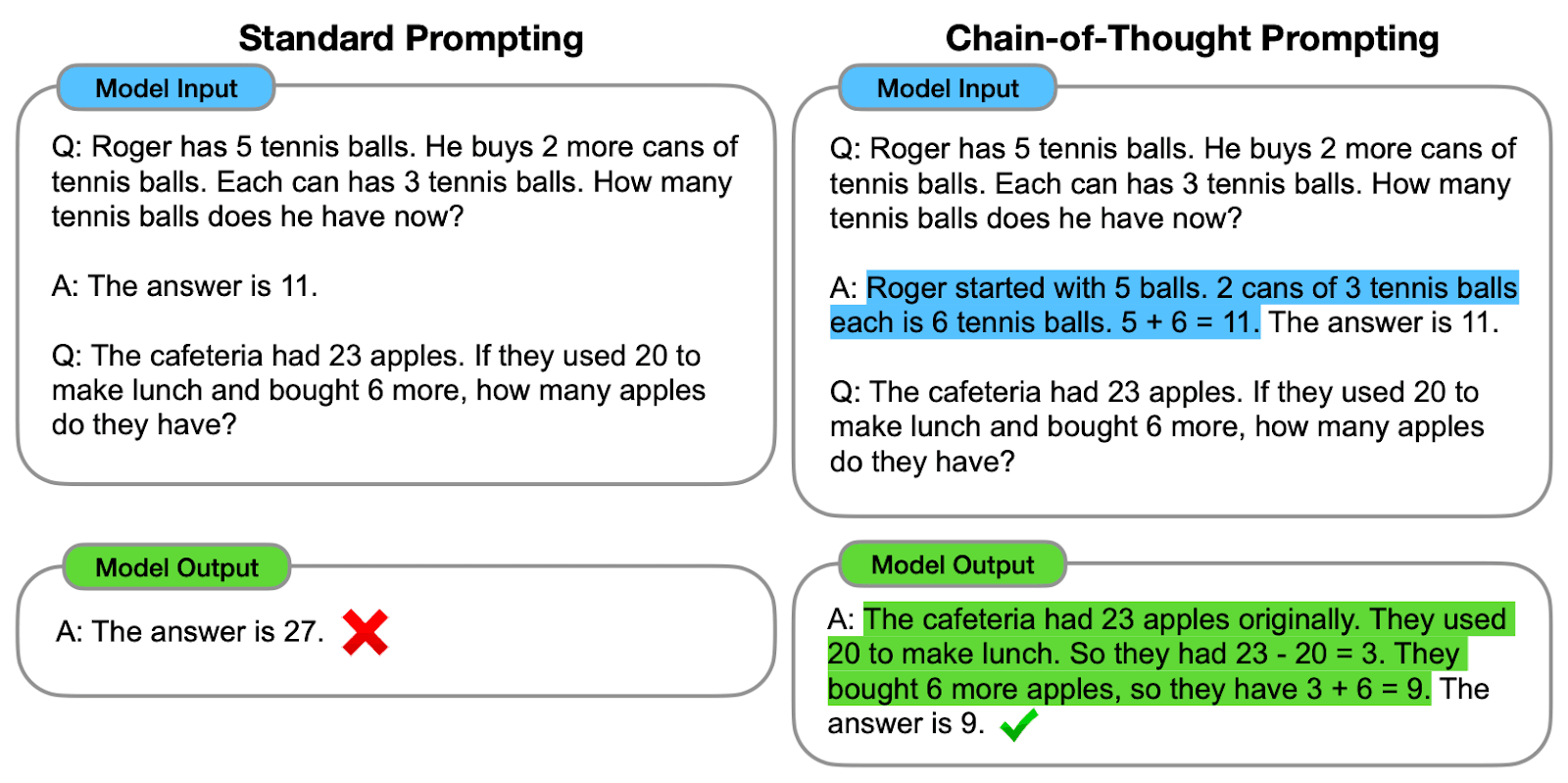

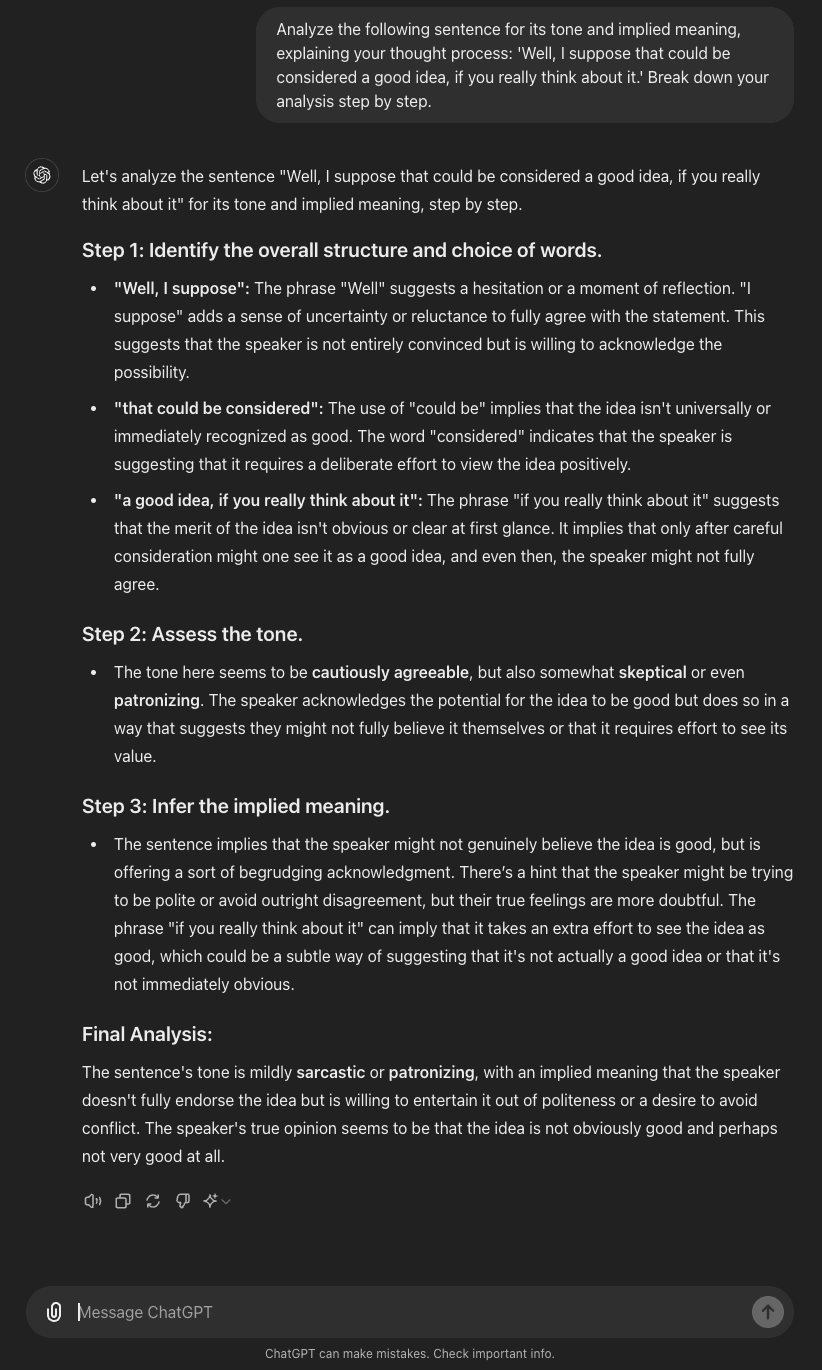

La incitación a la cadena de pensamiento es una ingeniería rápida diseñada para guiar a los LLM a través de un proceso de razonamiento paso a paso. A diferencia de los métodos estándar que buscan respuestas directas, el método CoT anima al modelo a generar pasos intermedios de razonamiento antes de llegar a una respuesta final. Este enfoque imita los patrones de razonamiento humano, lo que permite a los sistemas de IA abordar tareas complejas con mayor precisión y transparencia.

En esencia, las instrucciones de CoT consisten en estructurar las instrucciones de entrada de forma que se obtenga una secuencia lógica de pensamientos del modelo. Al dividir los problemas complejos en pasos más pequeños y manejables, CoT permite a los LLM navegar por rutas de razonamiento intrincadas de forma más eficaz. Esto es especialmente valioso para tareas que requieren la resolución de problemas en varios pasos, como problemas matemáticos de palabras, retos de razonamiento lógico y escenarios complejos de toma de decisiones.

La evolución de la inducción de la cadena de pensamiento en el campo de la IA está estrechamente ligada al desarrollo de modelos de lenguaje cada vez más sofisticados. A medida que los LLM crecían en tamaño y capacidad, los investigadores observaron que los modelos de lenguaje suficientemente grandes podían mostrar capacidades de razonamiento cuando se les incitaba adecuadamente. Esta observación condujo a la formalización de la TdC como una técnica de incitación distinta.

Inicialmente introducido por investigadores de Google en 2022La técnica CoT se impuso rápidamente en la comunidad de la IA. La técnica demostró mejoras significativas en el rendimiento del modelo en varias tareas de razonamiento complejas, entre ellas:

Razonamiento aritmético

Razonamiento de sentido común

Manipulación simbólica

Respuesta a preguntas multisalto

Lo que distingue a CoT de otras técnicas de ingeniería de avisos es que se centra en generar no sólo la respuesta, sino todo el proceso de pensamiento que lleva a esa respuesta. Este enfoque ofrece varias ventajas:

Mejora de la resolución de problemas: Al dividir las tareas complejas en pasos más pequeños, los modelos pueden abordar problemas que antes estaban fuera de su alcance.

Mejora de la interpretabilidad: El proceso de razonamiento paso a paso permite saber cómo llega el modelo a sus conclusiones, lo que hace más transparente la toma de decisiones de la IA.

Versatilidad: El CoT puede aplicarse a una amplia gama de tareas y dominios, lo que lo convierte en una valiosa herramienta de la IA.

A medida que profundizamos en la mecánica y las aplicaciones de la inducción de la cadena de pensamiento, queda claro que esta técnica representa un importante salto adelante en nuestra capacidad de aprovechar todo el potencial de los grandes modelos lingüísticos para tareas de razonamiento complejas.

Mecánica del estímulo de la cadena de pensamiento

Exploremos la mecánica que subyace a la incitación CoT, sus distintos tipos y en qué se diferencia de las técnicas de incitación estándar.

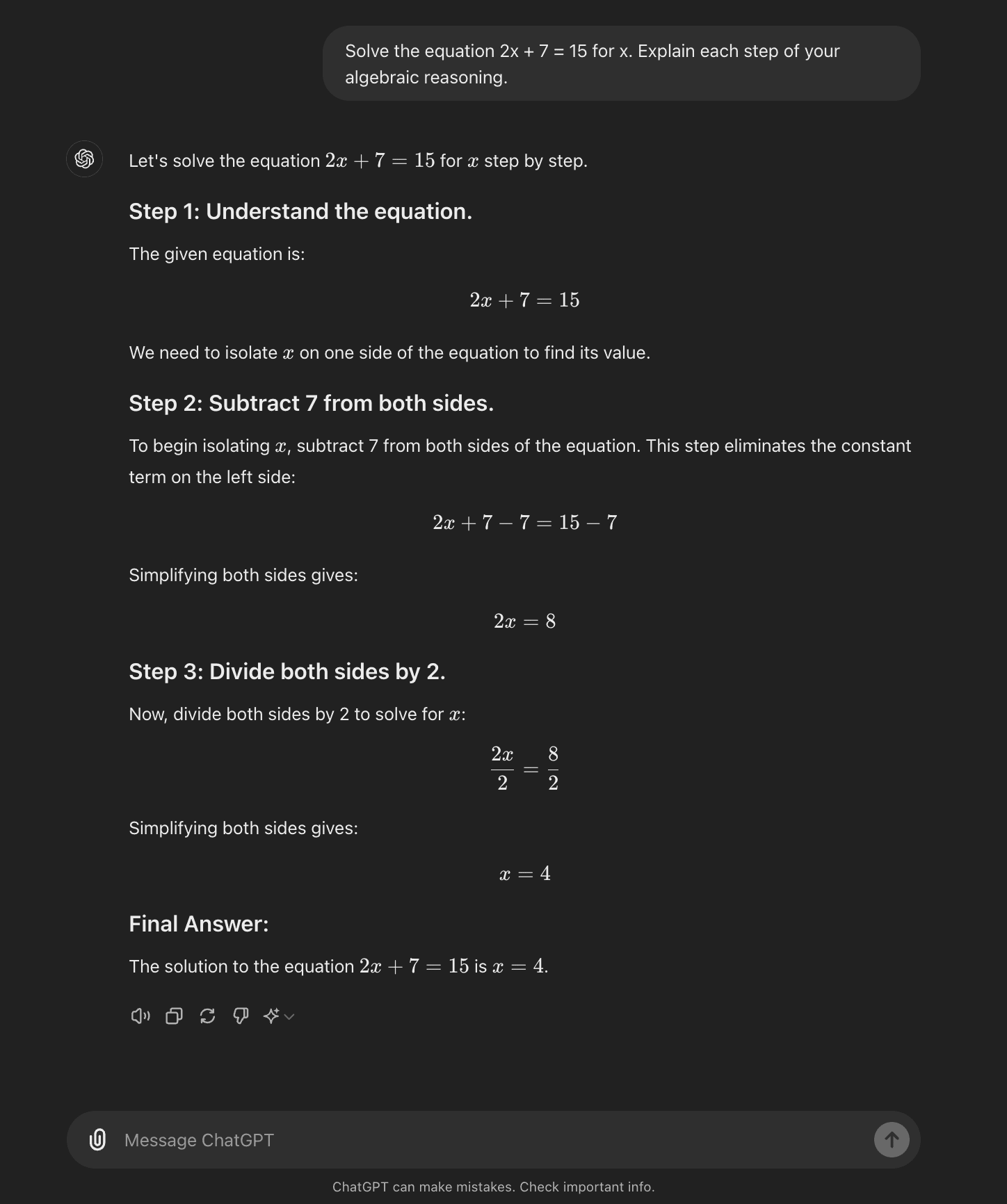

Cómo funciona CoT

En esencia, las instrucciones CoT guían a los modelos lingüísticos a través de una serie de pasos intermedios de razonamiento antes de llegar a una respuesta final. Este proceso suele implicar:

Descomposición del problema: La tarea compleja se descompone en pasos más pequeños y manejables.

Razonamiento paso a paso: Se pide al modelo que piense explícitamente en cada paso.

Progresión lógica: Cada paso se basa en el anterior, creando una cadena de pensamientos.

Conclusión: La respuesta final se obtiene a partir de los pasos de razonamiento acumulados.

Al animar al modelo a "mostrar su trabajo", la ayuda de CoT contribuye a mitigar los errores que pueden producirse cuando un modelo intenta llegar directamente a una conclusión. Este enfoque es especialmente eficaz en tareas de razonamiento complejas que requieren múltiples pasos lógicos o la aplicación de conocimientos específicos del dominio.

Tipos de CoT Prompting

La incitación a la cadena de pensamiento puede aplicarse de varias formas, entre las que destacan dos tipos principales:

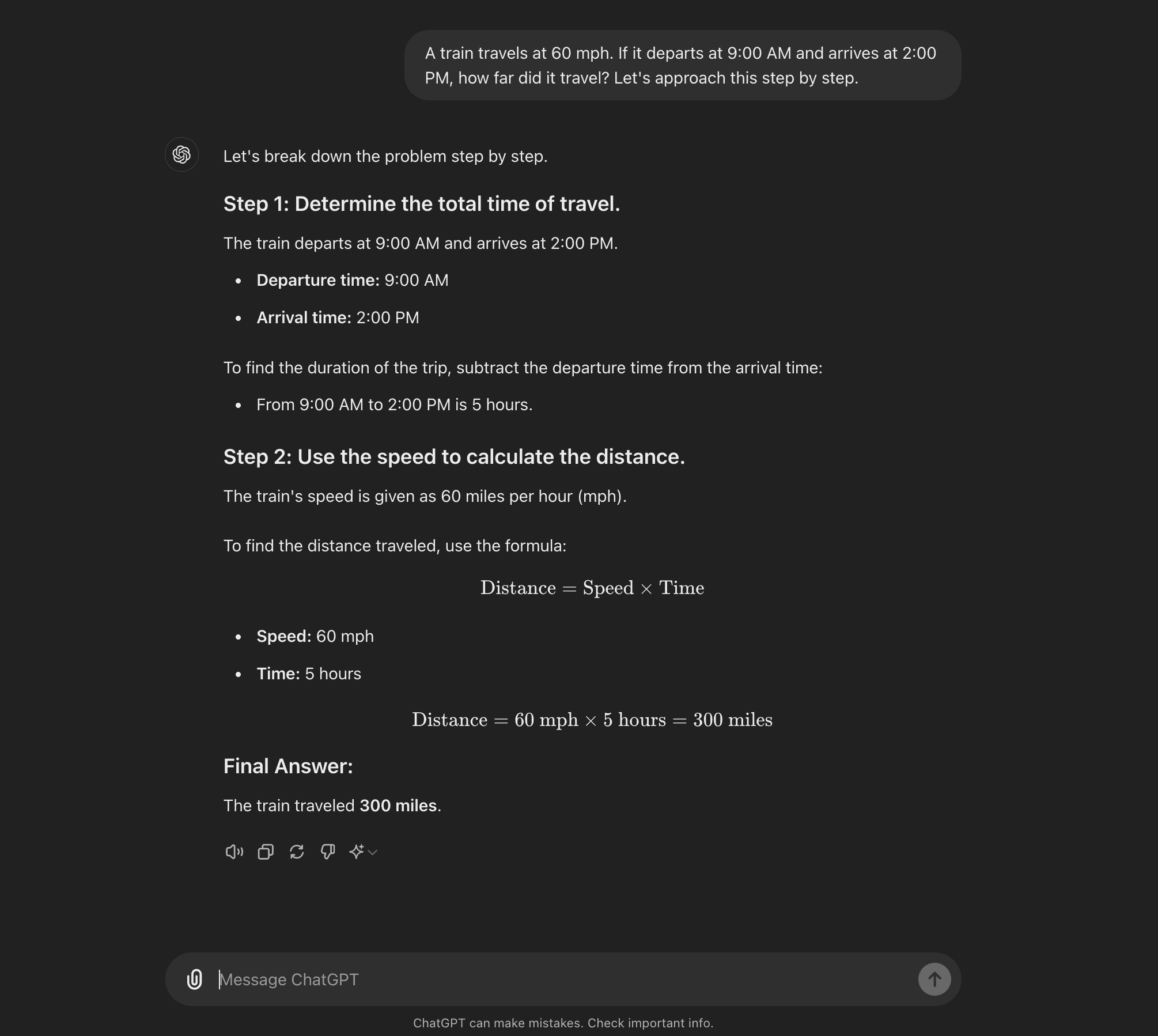

1. CoT de disparo cero

La CoT cero es una potente variante que no requiere ejemplos de tareas específicas. En su lugar, utiliza una simple indicación del tipo "Vamos a abordar esto paso a paso" para animar al modelo a desglosar su proceso de razonamiento. Esta técnica ha demostrado una notable eficacia en la mejora del rendimiento del modelo en una amplia gama de tareas sin necesidad de formación adicional o ajuste.

Características principales del CoT de disparo cero:

No requiere ejemplos de tareas específicas

Utiliza los conocimientos existentes del modelo

Gran versatilidad para distintos tipos de problemas

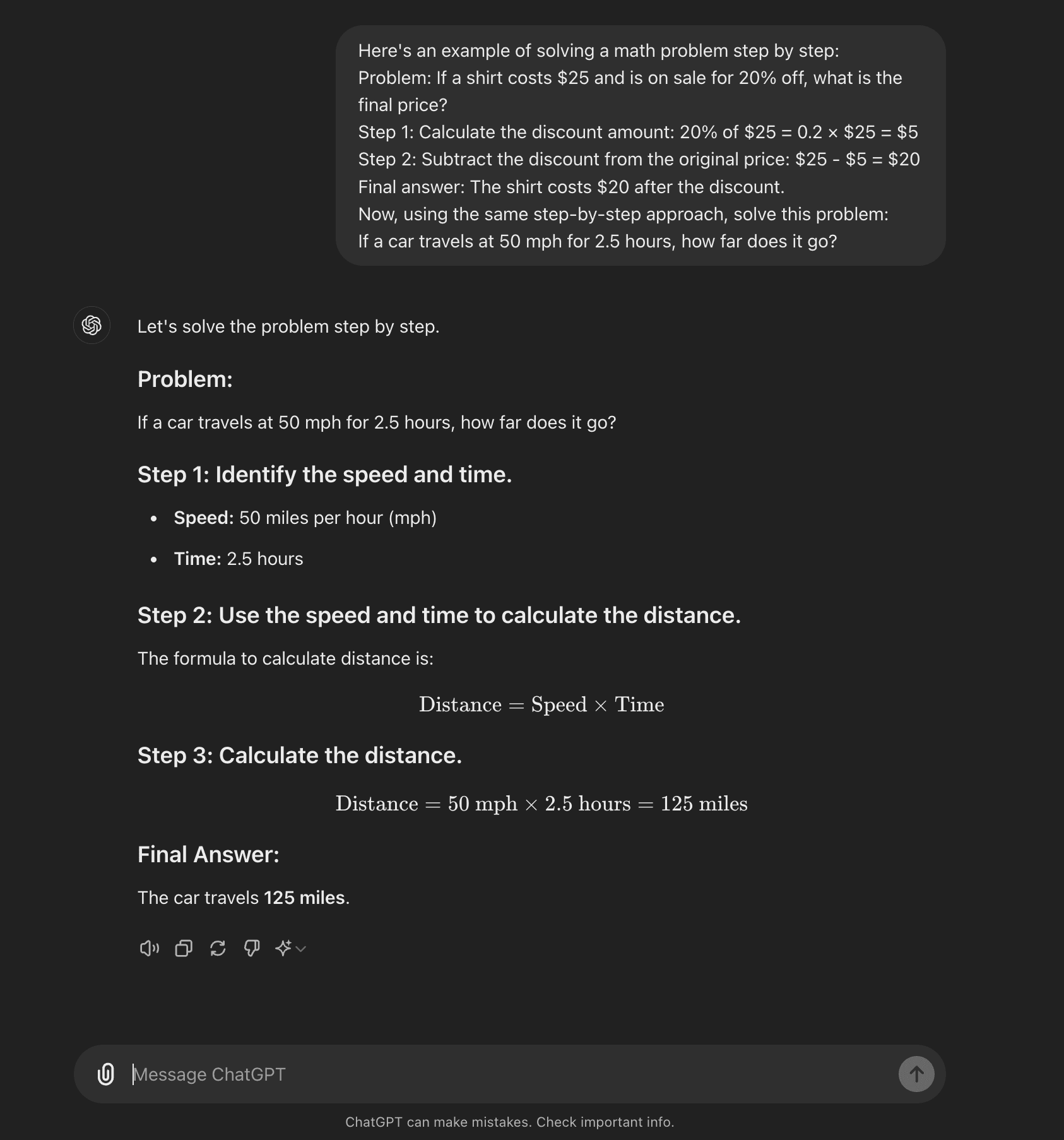

2. CoT de pocos disparos

La CoT de pocos intentos consiste en proporcionar al modelo un pequeño número de ejemplos que demuestren el proceso de razonamiento deseado. Estos ejemplos sirven de plantilla para que el modelo aborde problemas nuevos y desconocidos.

Características del CoT de pocos disparos:

Proporciona de 1 a 5 ejemplos del proceso de razonamiento

Ayuda a guiar el modelo de pensamiento de forma más explícita

Puede adaptarse a tipos de problemas o ámbitos específicos

Comparación con las técnicas estándar

Para apreciar el valor del estímulo de la cadena de pensamiento, es esencial comprender en qué se diferencia de las técnicas de estímulo habituales:

Transparencia en el razonamiento:

Prompting estándar: A menudo da lugar a respuestas directas sin explicación.

CoT Prompting: Genera pasos intermedios que permiten comprender el proceso de razonamiento.

Tratamiento de problemas complejos:

Prompting estándar: Puede tener dificultades con tareas de razonamiento complejo o de varios pasos.

CoT Prompting: Describe y resuelve problemas complejos de forma sistemática.

Detección de errores:

Prompting estándar: Los errores de razonamiento pueden ser difíciles de identificar.

CoT Prompting: Los errores se detectan más fácilmente en el proceso paso a paso.

Adaptabilidad:

Prompting estándar: Puede requerir indicaciones específicas para distintos tipos de problemas.

CoT Prompting: Más adaptable a diversos ámbitos problemáticos con un ajuste rápido mínimo.

Razonamiento similar al humano:

Prompting estándar: A menudo produce respuestas directas de tipo maquinal.

CoT Prompting: Imita los procesos de pensamiento humanos, lo que hace que los resultados sean más cercanos y comprensibles.

Aprovechando la potencia de los pasos intermedios del razonamiento, las instrucciones de cadena de pensamiento permiten a los modelos lingüísticos abordar tareas complejas con mayor precisión y transparencia. Tanto si se utilizan enfoques de cero disparos como de pocos disparos, CoT representa un avance significativo en las técnicas de ingeniería de avisos, ampliando los límites de lo que es posible con grandes modelos lingüísticos en escenarios de razonamiento complejos.

Aplicaciones del estímulo de la cadena de pensamiento

CoT prompting ha demostrado ser una técnica versátil con aplicaciones en diversos ámbitos que requieren un razonamiento complejo. Exploremos algunas áreas clave en las que destaca CoT prompting:

Tareas de razonamiento complejas

CoT prompting brilla en escenarios que exigen la resolución de problemas en varios pasos y la deducción lógica. Algunas aplicaciones notables son:

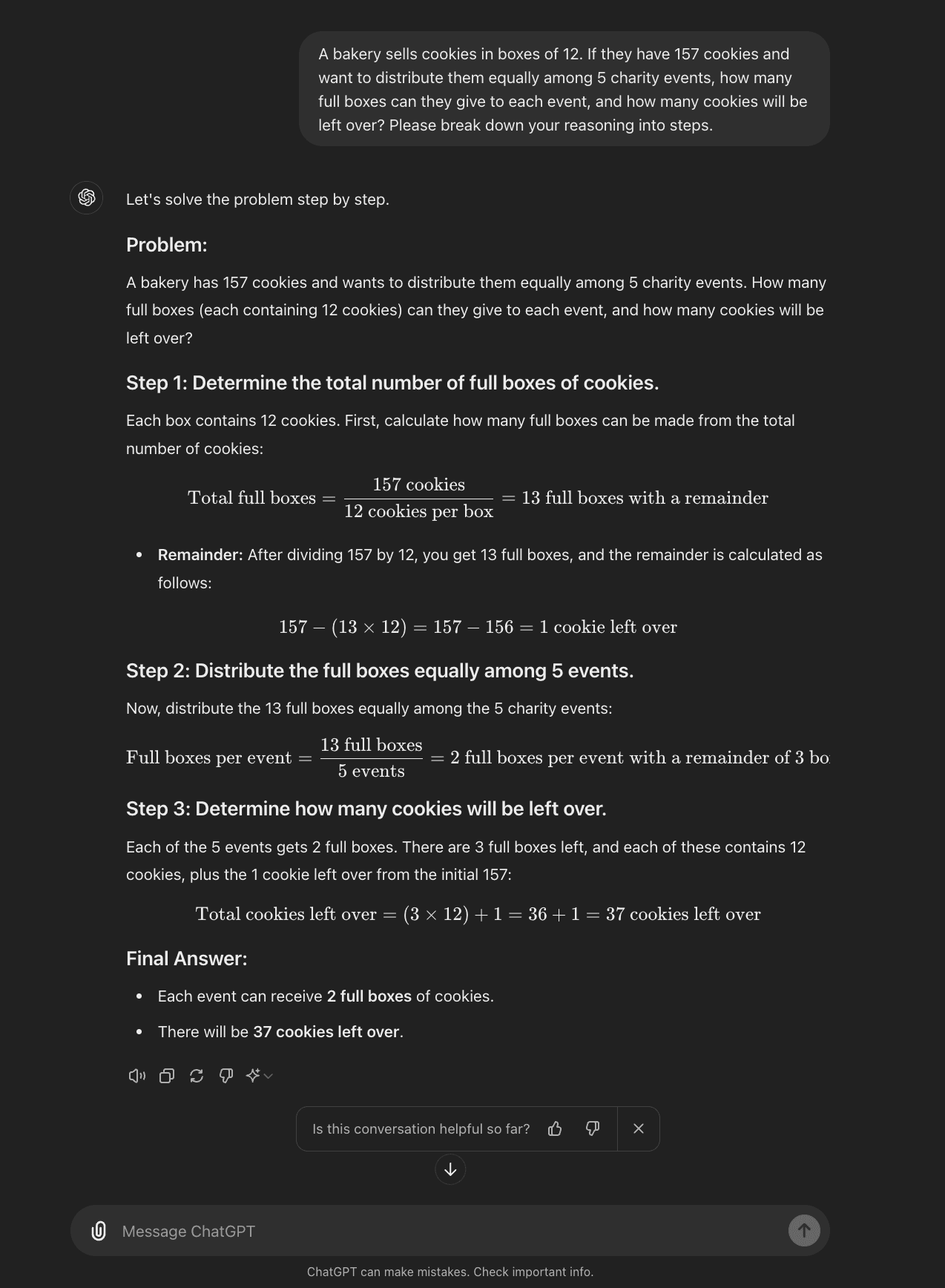

Problemas de matemáticas: CoT guía a los modelos a través de los pasos de interpretación del problema, identificación de la información relevante y aplicación de las operaciones matemáticas apropiadas.

Análisis científico: En campos como la física o la química, el CdT puede ayudar a los modelos a descomponer fenómenos complejos en principios fundamentales y pasos lógicos.

Planificación estratégica: Para tareas que implican múltiples variables y consecuencias a largo plazo, el CoT permite a los modelos considerar diversos factores de forma sistemática.

Proceso de razonamiento simbólico

Las tareas de razonamiento simbólico, que implican la manipulación de símbolos y conceptos abstractos, se benefician enormemente de la ayuda del TdC:

Álgebra y resolución de ecuaciones: CoT ayuda a los modelos a navegar por los pasos de simplificación y resolución de ecuaciones.

Pruebas lógicas: En la lógica formal o en las pruebas matemáticas, el CdT guía al modelo en cada paso del argumento.

Reconocimiento de patrones: Para las tareas que implican patrones o secuencias complejas, el CoT permite a los modelos articular las reglas y relaciones que identifican.

Retos del procesamiento del lenguaje natural

El sistema CoT ha demostrado ser prometedor a la hora de abordar algunos de los retos más complejos del procesamiento del lenguaje natural:

Razonamiento de sentido común: Al descomponer los escenarios en pasos lógicos, el TdC ayuda a los modelos a hacer inferencias basadas en conocimientos generales sobre el mundo.

Resumir textos: CoT puede guiar a los modelos en el proceso de identificar los puntos clave, organizar la información y generar resúmenes concisos.

Traducción de idiomas: En el caso de expresiones complejas o idiomáticas, CoT puede ayudar a los modelos a razonar el significado y el contexto antes de proporcionar una traducción.

Ventajas de la aplicación de CoT Prompting

La adopción de la incitación a la cadena de pensamiento ofrece varias ventajas significativas que mejoran las capacidades de los grandes modelos lingüísticos en tareas de razonamiento complejas.

Una de las principales ventajas es mayor precisión en la resolución de problemas. Al fomentar el razonamiento paso a paso, el guiado CoT suele conducir a resultados más precisos, especialmente en tareas complejas. Esta mejora se debe a la reducción de la propagación de errores, ya que es menos probable que éstos se agraven cuando se tiene en cuenta explícitamente cada paso. Además, CoT fomenta la exploración exhaustiva del problema, guiando al modelo para que considere todos los aspectos relevantes antes de concluir.

Otra ventaja crucial es la mayor interpretabilidad de las decisiones de la IA. Las indicaciones de CoT aumentan significativamente la transparencia de los procesos de toma de decisiones de la IA al proporcionar una ruta de razonamiento visible. Los usuarios pueden seguir el proceso de razonamiento del modelo y saber cómo ha llegado a una conclusión determinada. Esta transparencia no sólo facilita la depuración cuando se producen errores, sino que también fomenta una mayor confianza en los sistemas de IA entre los usuarios y las partes interesadas.

CoT prompting destaca especialmente a la hora de abordar problemas de razonamiento en varios pasos. En situaciones que requieren una serie de pasos lógicos, como árboles de decisión complejos o tareas secuenciales de resolución de problemas, CoT ayuda a los modelos a navegar sistemáticamente por las distintas posibilidades. En las tareas que se basan en resultados anteriores, CoT garantiza que cada paso se considere cuidadosamente y se base lógicamente en el anterior, lo que conduce a resultados más coherentes y fiables.

Limitaciones y consideraciones

Aunque la inducción de la cadena de pensamiento ofrece numerosas ventajas, es importante conocer sus limitaciones y posibles dificultades para utilizarla con eficacia.

Una limitación importante es dependencia del modelo. La eficacia de CoT puede variar considerablemente en función del modelo lingüístico subyacente. Por lo general, CoT suele funcionar mejor con modelos lingüísticos suficientemente grandes y con capacidad de razonamiento complejo. Los datos de preentrenamiento del modelo también pueden influir en su capacidad para generar cadenas de pensamiento significativas en ámbitos específicos. Esto significa que el éxito de las instrucciones CoT está estrechamente ligado a las capacidades y el entrenamiento del modelo lingüístico utilizado.

Ingeniería rápida presenta otro reto a la hora de aplicar el TdC. Elaborar instrucciones eficaces para el CdT requiere habilidad y a menudo implica ensayo y error. Las instrucciones deben proporcionar suficiente orientación sin ser excesivamente prescriptivas, y la creación de instrucciones eficaces para campos especializados puede requerir el conocimiento de expertos. Mantener la coherencia a lo largo de la cadena de pensamiento puede ser un reto, especialmente en las tareas de razonamiento más complejas.

También hay que tener en cuenta que la ayuda del TdC no siempre es la mejor solución. Para tareas sencillas, puede introducir complejidad y carga computacional innecesarias. También existe el riesgo de sobreexplicaciónEl proceso de razonamiento detallado puede ocultar la respuesta directa que busca el usuario. Además, una cadena de pensamiento coherente no garantiza una conclusión correcta, lo que puede llevar a exceso de confianza en resultados incorrectos.

Conclusión sobre el fomento del TdC

Las instrucciones de cadena de pensamiento representan un avance significativo en las técnicas de ingeniería de instrucciones y amplían las posibilidades de los grandes modelos lingüísticos. Al permitir procesos de razonamiento paso a paso, CoT mejora la capacidad de los sistemas de IA para abordar tareas de razonamiento complejas, desde el razonamiento simbólico hasta los retos del procesamiento del lenguaje natural. Aunque ofrece una mayor precisión, una mejor interpretabilidad y la capacidad de gestionar problemas de varios pasos, es crucial tener en cuenta sus limitaciones, como la dependencia del modelo y los retos de la ingeniería de instrucciones.

A medida que la IA sigue evolucionando, el estímulo CoT se erige en una poderosa herramienta para liberar todo el potencial de los modelos lingüísticos, tendiendo un puente entre la computación artificial y el razonamiento similar al humano. Su repercusión en campos que requieren la resolución de problemas complejos es crucial, pues allana el camino para aplicaciones de IA más sofisticadas y transparentes en diversos ámbitos.

Preguntas más frecuentes (FAQ)

1. ¿Cómo mejora la cadena de pensamiento la precisión de los modelos lingüísticos?

Anima a los modelos a descomponer los problemas complejos en pasos, lo que reduce los errores y mejora el razonamiento lógico. Este enfoque paso a paso permite manejar mejor las tareas polifacéticas.

2. ¿Se puede utilizar el estímulo de la cadena de pensamiento para otras tareas además de la aritmética y los puzzles lógicos?

Sí, es aplicable a una amplia gama de tareas, como el procesamiento del lenguaje natural, la toma de decisiones y el razonamiento científico. Cualquier tarea que requiera un pensamiento estructurado puede beneficiarse de las indicaciones de CoT.

¿Cuáles son algunos de los retos más comunes a la hora de poner en práctica la incitación a la cadena de pensamiento?

Entre los principales retos figuran la elaboración de instrucciones eficaces, la garantía de coherencia a lo largo de la cadena de razonamiento y la gestión del aumento de los requisitos informáticos. También hay que tener muy en cuenta las capacidades y limitaciones del modelo.

¿En qué se diferencia Auto-CoT de la inducción tradicional de la cadena de pensamiento?

Auto-CoT automatiza el proceso de generación de pasos de razonamiento, reduciendo la necesidad de ingeniería manual de indicaciones. Utiliza técnicas de agrupación y muestreo para crear automáticamente instrucciones diversas y específicas para cada tarea.

¿Existe algún modelo lingüístico específico que funcione mejor con la inducción de la cadena de pensamiento?

Por lo general, los modelos lingüísticos de mayor tamaño, como GPT-4 y Claude, obtienen mejores resultados con CoT. Los modelos con un amplio preentrenamiento en diversos dominios tienden a beneficiarse más de esta técnica.