Llama 3.1 de Meta: Superando los límites de la IA de código abierto

Meta ha anunciado recientemente Llama 3.1su modelo de gran lenguaje (LLM) de código abierto más avanzado hasta la fecha. Este lanzamiento marca un hito importante en la democratización de la tecnología de IA, ya que puede salvar la brecha entre los modelos de código abierto y los patentados.

Llama 3.1 es un gran paso adelante en las capacidades de la IA de código abierto. Con su emblemático modelo de 405.000 millones de parámetros, Meta desafía la noción de que la IA de vanguardia debe ser de código cerrado y patentada. Este lanzamiento marca el inicio de una nueva era en la que las capacidades de IA más avanzadas estarán al alcance de investigadores, desarrolladores y empresas de todos los tamaños.

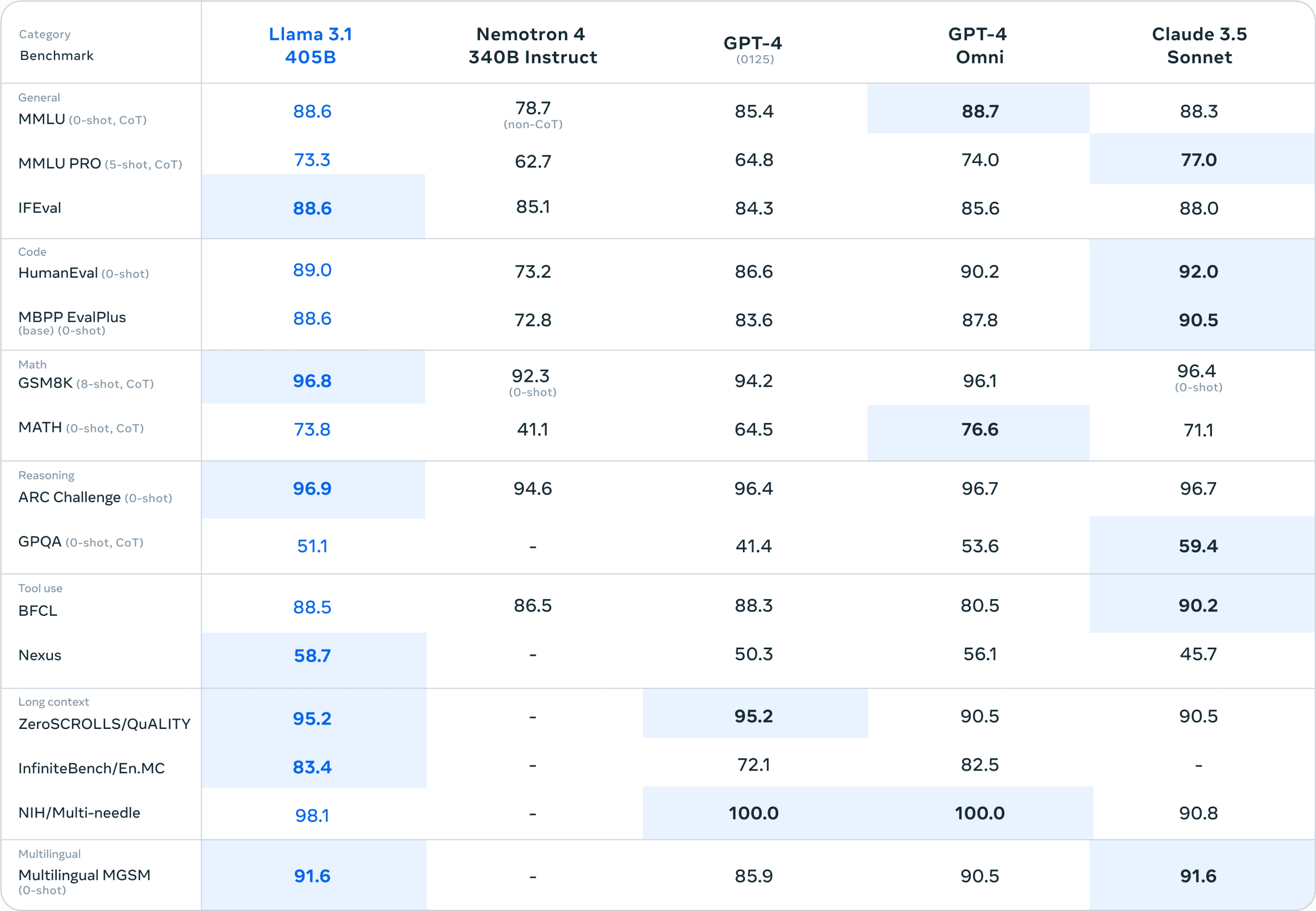

Las principales mejoras de Llama 3.1 incluyen una longitud de contexto ampliada a 128.000 tokens, compatibilidad con ocho idiomas y un rendimiento sin precedentes en áreas como el razonamiento, las matemáticas y la generación de código. Estos avances posicionan a Llama 3.1 como una herramienta versátil capaz de abordar tareas complejas del mundo real en diversos dominios del entorno empresarial.

La evolución de Llama: de 2 a 3.1

Para apreciar la importancia de Llama 3.1, merece la pena revisar sus predecesores. Llama 2, lanzada en 2023, ya supuso un gran paso adelante en la IA de código abierto. Ofrecía modelos que oscilaban entre 7B y 70B parámetros y demostró un rendimiento competitivo en varias pruebas comparativas.

Llama 3.1 parte de esta base con varios avances clave:

Mayor tamaño del modelo: La introducción del modelo de parámetros 405B amplía las posibilidades de la IA de código abierto.

Longitud de contexto ampliada: De 4K tokens en Llama 2 a 128K en Llama 3.1, lo que permite una comprensión más compleja y matizada de textos más largos.

Capacidad multilingüe: La mayor compatibilidad lingüística permite aplicaciones más diversas en distintas regiones y casos de uso.

Mejora del razonamiento y de las tareas especializadas: Mayor rendimiento en áreas como el razonamiento matemático y la generación de código.

Cuando se compara con modelos de código cerrado como GPT-4 y Claude 3.5 Sonnet, Llama 3.1 405B no tiene nada que envidiar en varios benchmarks. Este nivel de rendimiento en un modelo de código abierto no tiene precedentes.

Especificaciones técnicas de Llama 3.1

Entrando en los detalles técnicos, Llama 3.1 ofrece una gama de tamaños de modelo para adaptarse a diferentes necesidades y recursos computacionales:

Modelo de parámetros 8B: Adecuado para aplicaciones ligeras y dispositivos de borde.

Modelo de parámetros 70B: Un equilibrio entre los requisitos de rendimiento y recursos.

Modelo de parámetros 405B: El modelo insignia, que supera los límites de las capacidades de la IA de código abierto.

La metodología de entrenamiento de Llama 3.1 se basó en un enorme conjunto de datos de más de 15 billones de tokens, significativamente mayor que el de sus predecesores. Esta gran cantidad de datos de entrenamiento, combinada con técnicas refinadas de tratamiento y preprocesamiento de datos, contribuye a mejorar el rendimiento y la versatilidad del modelo.

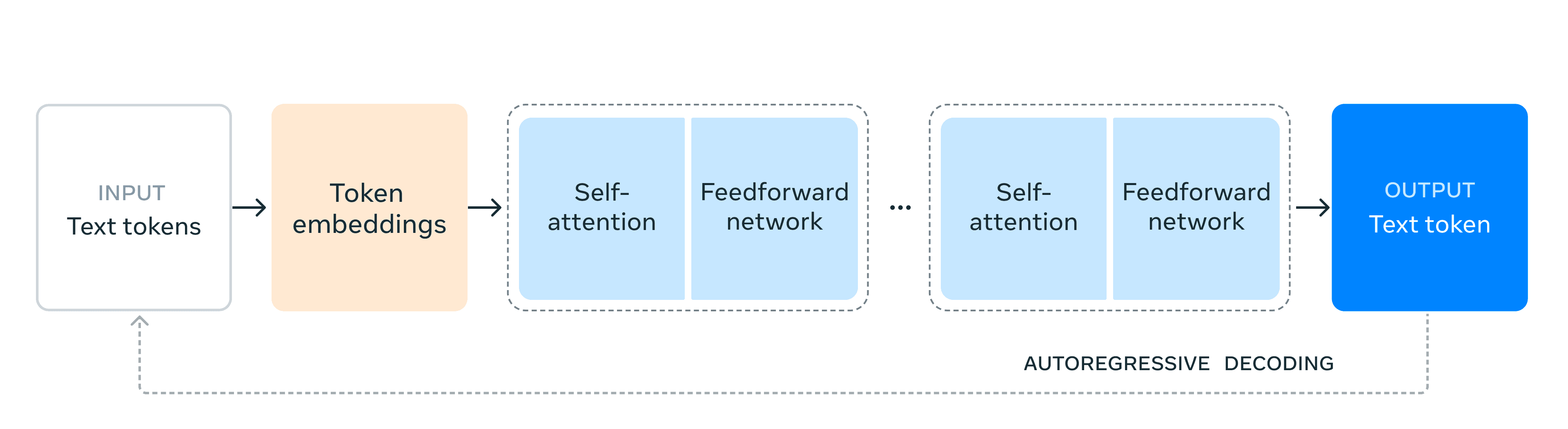

Arquitectónicamente, Llama 3.1 mantiene un modelo de transformador sólo decodificador, priorizando la estabilidad del entrenamiento sobre enfoques más experimentales como la mezcla de expertos. Sin embargo, Meta ha implementado varias optimizaciones para permitir un entrenamiento y una inferencia eficientes a esta escala sin precedentes:

Infraestructura de formación ampliable: Utilización de más de 16.000 GPU H100 para entrenar el modelo 405B.

Procedimiento iterativo de post-entrenamiento: Emplear el ajuste fino supervisado y la optimización directa de preferencias para mejorar capacidades específicas.

Técnicas de cuantificación: Reducción del modelo de 16 bits a 8 bits numéricos para una inferencia más eficaz, lo que permite la implantación en nodos de un solo servidor.

Estas decisiones técnicas reflejan un equilibrio entre la superación de los límites del tamaño del modelo y la garantía de una utilización práctica en una serie de escenarios de despliegue.

Al poner estos modelos avanzados a disposición del público, Meta no se limita a compartir un producto, sino que proporciona una plataforma para la innovación. Las especificaciones técnicas de Llama 3.1 abren nuevas posibilidades para que investigadores y desarrolladores exploren aplicaciones de IA de vanguardia, acelerando el ritmo de avance de la IA en toda la industria.

Capacidades revolucionarias

Llama 3.1 introduce varias funciones revolucionarias que la distinguen en el panorama de la IA:

Contexto ampliado Longitud

El salto a una ventana contextual de 128K cambia las reglas del juego. Esta capacidad ampliada permite a Llama 3.1 procesar y comprender fragmentos de texto mucho más largos:

Análisis exhaustivo de documentos

Generación de contenidos de formato largo

Manejo más matizado de la conversación

Esta característica abre nuevas posibilidades de aplicación en ámbitos como el tratamiento de documentos jurídicos, el análisis bibliográfico y la resolución de problemas complejos que requieren retener y sintetizar grandes cantidades de información.

Soporte multilingüe

La compatibilidad de Llama 3.1 con ocho idiomas amplía significativamente su aplicabilidad global. Esta capacidad multilingüe:

Mejora la comunicación intercultural

Permite aplicaciones de IA más inclusivas

Apoya las operaciones empresariales globales

Al derribar las barreras lingüísticas, Llama 3.1 allana el camino a soluciones de IA más diversas y orientadas al mundo.

Razonamiento avanzado y uso de herramientas

El modelo demuestra una capacidad de razonamiento sofisticada y la capacidad de utilizar herramientas externas con eficacia. Este avance se manifiesta en:

Mejora de la deducción lógica y la resolución de problemas

Mayor capacidad para seguir instrucciones complejas

Utilización eficaz de bases de conocimientos y API externas

Estas capacidades convierten a Llama 3.1 en una potente herramienta para tareas que requieren habilidades cognitivas de alto nivel, desde la planificación estratégica hasta el análisis de datos complejos.

Generación de código y destreza matemática

Llama 3.1 muestra notables habilidades en dominios técnicos:

Generación de código funcional de alta calidad en varios lenguajes de programación

Resolver problemas matemáticos complejos con precisión

Asistencia en el diseño y optimización de algoritmos

Estas características convierten a Llama 3.1 en un valioso activo para el desarrollo de software, la informática científica y las aplicaciones de ingeniería.

La ventaja del código abierto

La naturaleza de código abierto de Llama 3.1 aporta varias ventajas significativas.

Al hacer que las capacidades de IA de nivel fronterizo estén disponibles gratuitamente, Meta lo está:

Reducir las barreras de acceso a la investigación y el desarrollo de la IA

Permitir que organizaciones más pequeñas y desarrolladores individuales aprovechen la IA avanzada

Fomentar un ecosistema de IA más diverso e innovador

Esta democratización podría dar lugar a una proliferación de aplicaciones de IA en diversos sectores, lo que podría acelerar el progreso tecnológico.

La posibilidad de acceder a los pesos del modelo de Llama 3.1 y modificarlos abre posibilidades de personalización sin precedentes:

Adaptación específica para sectores especializados

Adaptación a casos de uso y conjuntos de datos únicos

Experimentación con nuevas técnicas y arquitecturas de formación

Esta flexibilidad permite a las organizaciones adaptar el modelo a sus necesidades específicas, lo que puede dar lugar a soluciones de IA más eficaces y eficientes.

Ecosistema y despliegue

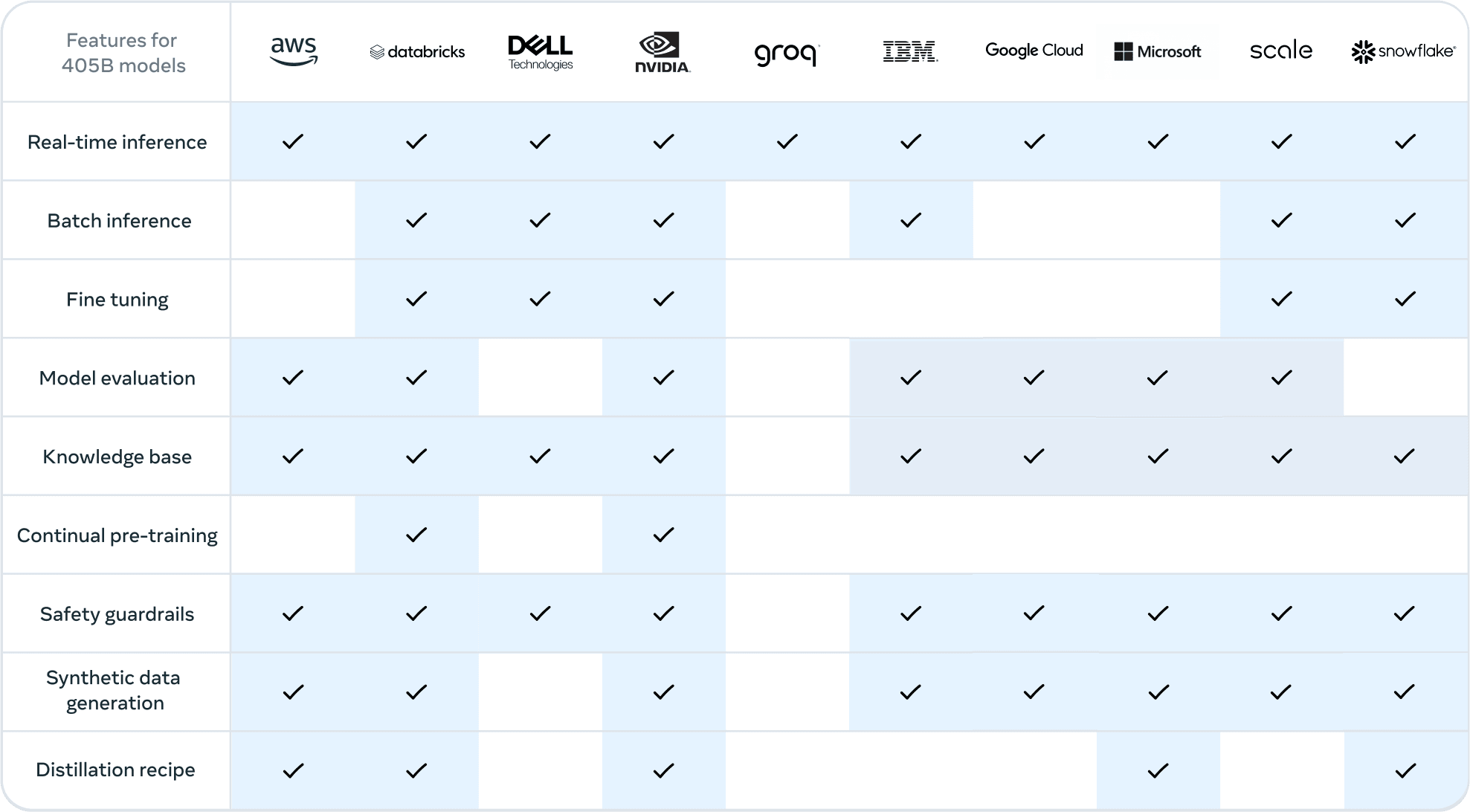

El lanzamiento de Llama 3.1 va acompañado de un sólido ecosistema para apoyar su despliegue y utilización:

Integración de socios

Meta ha colaborado con líderes del sector para garantizar un amplio apoyo a Llama 3.1:

Proveedores en la nube como AWS, Google Cloud y Azure ofrecen opciones de despliegue sin fisuras

Fabricantes de hardware como NVIDIA y Dell proporcionan infraestructura optimizada

Las plataformas de datos como Databricks y Snowflake permiten un procesamiento de datos y una integración de modelos eficientes.

Estas asociaciones garantizan que las organizaciones puedan aprovechar Llama 3.1 dentro de sus pilas tecnológicas existentes.

Optimización y escalabilidad de la inferencia

Para que Llama 3.1 resulte práctico en aplicaciones reales, se han implementado varias optimizaciones:

Las técnicas de cuantificación reducen los requisitos computacionales del modelo

Motores de inferencia optimizados como vLLM y TensorRT aumentan el rendimiento

Las opciones de implantación escalable se adaptan a diversos casos de uso, desde dispositivos periféricos hasta centros de datos.

Estas optimizaciones hacen que sea factible implantar incluso el modelo de parámetros 405B en entornos de producción.

La pila de llamas y los esfuerzos de normalización

Meta está impulsando la normalización en el ecosistema de la IA:

La pila Llama propuesta pretende crear una interfaz común para los componentes de IA

Unas API normalizadas facilitarían la integración y la interoperabilidad entre distintas herramientas y plataformas de IA.

Esta iniciativa podría dar lugar a un ecosistema de desarrollo de IA más cohesionado y eficiente.

La promesa y el potencial de Llama 3.1

El lanzamiento de Llama 3.1 por parte de Meta marca un momento crucial en el panorama de la IA, ya que democratiza el acceso a capacidades de IA de vanguardia. Al ofrecer un modelo de 405B parámetros con un rendimiento de última generación, soporte multilingüe y una longitud de contexto ampliada, todo ello dentro de un marco de código abierto, Meta ha establecido un nuevo estándar para una IA accesible y potente. Este paso no sólo desafía el dominio de los modelos de código cerrado, sino que también allana el camino para una innovación y colaboración sin precedentes en la comunidad de la IA.

En esta encrucijada del desarrollo de la IA, Llama 3.1 representa algo más que un avance tecnológico: encarna la visión de un futuro más abierto, inclusivo y dinámico para la inteligencia artificial. El verdadero impacto de esta versión se revelará a medida que los desarrolladores, investigadores y empresas de todo el mundo aprovechen su potencial, reconfigurando las industrias y ampliando los límites de lo que es posible con LLM.