Nuestras 10 voces de IA favoritas de ElevenLabs + Cómo clonar las tuyas + Casos de uso empresarial - AI&YOU #71

El dato de la semana: El tamaño del mercado mundial de clonación de voz de IA se valoró en 1,45 mil millones de dólares en 2022 y se espera que crezca a una CAGR de 26,1% de 2023 a 2030. (Grand View Research) A medida que los agentes de IA se hacen indispensables en diversos campos, la voz que los...

Cómo solicitar el modelo o1 de OpenAI

El modelo o1 de OpenAI no es una simple actualización en el mundo de los modelos lingüísticos. Supone un cambio de paradigma en la forma en que la IA procesa y responde a consultas complejas. A diferencia de sus predecesores, o1 está diseñado para "pensar" los problemas antes de generar una respuesta,...

¿Quién debería utilizar el modelo o1 de OpenAI?

A medida que empresas e investigadores se enfrentan a retos cada vez más complejos y al auge de nuevos modelos de LLM, surge la pregunta: ¿debería utilizar OpenAI o1 para mis necesidades específicas? El modelo o1, que forma parte de una nueva generación de IA conocida como modelos de razonamiento, está diseñado para abordar...

15 estadísticas y datos sobre el modelo o1 de OpenAI

El modelo o1 de OpenAI representa un importante salto adelante en la evolución de los grandes modelos lingüísticos, especialmente en el ámbito de las tareas de razonamiento complejas. A medida que las empresas y los investigadores se enfrentan a retos cada vez más sofisticados,...

10 maneras en que su empresa puede utilizar la tecnología de voz de inteligencia artificial de ElevenLabs

ElevenLabs, pionera en tecnología de voz AI, ofrece capacidades de clonación de voz y conversión de texto a voz de vanguardia que pueden revolucionar varios aspectos de las operaciones de su empresa. Exploremos diez potentes formas en que su empresa puede aprovechar las voces de IA de ElevenLabs para...

Cómo clonar tu voz con ElevenLabs: Guía paso a paso

La clonación de voz, un subconjunto de la tecnología de audio AI, es el proceso de creación de una réplica digital de una voz humana utilizando modelos avanzados de aprendizaje profundo. Esta innovadora tecnología ha cobrado cada vez más importancia en la comunicación digital moderna, ofreciendo nuevas posibilidades...

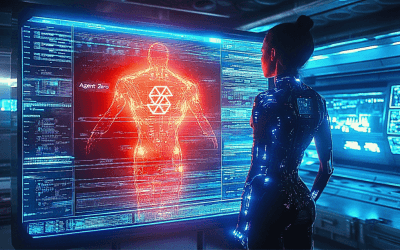

Cómo las personas no técnicas y técnicas utilizan el Agente Cero para crear agentes autónomos de IA y flujos de trabajo agenéticos - AI&YOU #70

La estadística de la semana: Los agentes de IA contribuyen significativamente a la productividad, con un aumento de la eficiencia de 61% declarado por los empleados que los utilizan. (Deloitte) Mientras seguimos explorando el potencial de los agentes de IA, ha surgido una nueva plataforma llamada Agent Zero, que ofrece...

¿Qué es el Agente Cero? Guía rápida

A medida que seguimos explorando el potencial de los agentes de IA, ha surgido una nueva plataforma llamada Agent Zero, que ofrece capacidades que amplían los límites de lo que es posible actualmente con los agentes de IA. Agent Zero representa un avance significativo en la tecnología de IA autónoma,...

Creación de herramientas de IA personalizadas con Agent Zero: el futuro del desarrollo de IA

Agent Zero ha surgido como una plataforma innovadora que amplía los límites de lo que es posible con los agentes autónomos de IA. Como hemos analizado en nuestros blogs anteriores, Agent Zero ofrece un conjunto único de capacidades que lo diferencian de las herramientas de IA tradicionales. Entre ellas...

Desbloquea el poder de la IA con el Agente Cero: 10 formas en que supera a los agentes tradicionales

El panorama de los agentes de IA ha evolucionado rápidamente en los últimos años, con diversas plataformas que ofrecen capacidades cada vez más sofisticadas. Estos agentes van desde simples chatbots a sistemas más complejos que pueden realizar tareas específicas o ayudar en la toma de decisiones....

Pocos estímulos, aprendizaje y ajuste para LLM - AI&YOU #67 Pocos estímulos, aprendizaje y ajuste para LLM - AI&YOU #67

Aprendizaje y ajuste fino para LLMs - AI&YOU #67 Aprendizaje y ajuste fino para LLMs - AI&YOU #67 Estadística de la semana: La investigación de MobiDev sobre el aprendizaje de pocos disparos para la clasificación de...

Nuestras 10 mejores voces de IA de ElevenLabs: Eleve su experiencia de usuario con agentes de IA

A medida que los agentes de IA se hacen indispensables en diversos campos, la voz que da vida a estos personajes digitales puede hacer que la experiencia del usuario sea decisiva. Para nuestra plataforma de agentes de IA, hemos seleccionado 10 voces destacadas que no solo suenan bien, sino que...

Debemos replantearnos la cadena de pensamiento (CdT) que impulsa la IA&YOU #68

La estadística de la semana: El rendimiento de la CoT a tiro cero fue de sólo 5,55% para GPT-4-Turbo, 8,51% para Claude-3-Opus y 4,44% para GPT-4. ("¿Cadena de irreflexión?") La inducción de la cadena de pensamiento (CoT) ha sido aclamada como un gran avance para desbloquear la capacidad de razonamiento de...

Elon Musk contra OpenAI podría definir la inteligencia artificial y perjudicar a Microsoft

En un movimiento al que la comunidad de la IA debería prestar atención, Elon Musk ha reavivado su batalla legal contra OpenAI, Sam Altman y Greg Brockman. Se trata de un caso que podría marcar el futuro de la inteligencia artificial, sobre todo en lo que respecta a...

Fuga de cerebros en OpenAI: una oportunidad de oro para las empresas de capital riesgo en busca de los próximos unicornios de la IA

En el arriesgado mundo de la inteligencia artificial, el talento es la moneda de cambio por excelencia. El reciente éxodo de OpenAI no es sólo una reorganización de la baraja: es una mina de oro potencial para los capitalistas de riesgo más astutos. Mientras asistimos a una de las...

Los 5 líderes actuales y anteriores de OpenAI que los inversores de capital riesgo deberían seguir

OpenAI está a la vanguardia de muchos avances revolucionarios en IA y es noticia constante, tanto por su innovación como por sus turbulencias. A medida que la empresa experimenta cambios en su reserva de talentos, incluida una reciente fuga de talentos al exterior, los inversores de capital riesgo deberían...

¿Qué es el estímulo de la cadena de pensamiento?

Los grandes modelos lingüísticos (LLM) demuestran notables capacidades en el procesamiento y la generación de lenguaje natural (PLN). Sin embargo, cuando se enfrentan a tareas de razonamiento complejas, estos modelos pueden tener dificultades para producir resultados precisos y fiables. Aquí es donde entra en juego la inducción de la cadena de pensamiento (CoT).

Resumen del trabajo de investigación sobre IA: "¿Cadena de pensamiento(menos)?" Sugerencia

Las instrucciones de cadena de pensamiento (CoT) han sido consideradas un gran avance en el desarrollo de las capacidades de razonamiento de los grandes modelos lingüísticos (LLM). Esta técnica, que consiste en proporcionar ejemplos de razonamiento paso a paso para guiar a los LLM, ha suscitado una gran atención en la comunidad de la IA. Muchos sitios web

Las 10 mejores técnicas para maximizar el rendimiento de la IA

El arte de elaborar instrucciones eficaces para modelos lingüísticos extensos (LLM) se ha convertido en una habilidad crucial para los profesionales de la IA. Unas instrucciones bien diseñadas pueden mejorar significativamente el rendimiento de un LLM, permitiendo resultados más precisos, relevantes y creativos. Esta entrada de blog explora diez de

¿Qué es Few Shot Learning?

En IA, la capacidad de aprender eficazmente a partir de datos limitados se ha vuelto crucial. El aprendizaje de pocos disparos es un método que está mejorando la forma en que los modelos de IA adquieren conocimientos y se adaptan a nuevas tareas. Pero, ¿qué es exactamente el aprendizaje de pocos disparos? Definición del aprendizaje de pocos...

LLM de pocos disparos frente a LLM de ajuste fino para soluciones de IA generativa

El verdadero potencial de los grandes modelos lingüísticos (LLM) reside no sólo en su amplia base de conocimientos, sino en su capacidad para adaptarse a tareas y dominios específicos con un entrenamiento adicional mínimo. Aquí es donde entran en juego los conceptos de estímulo de pocos...

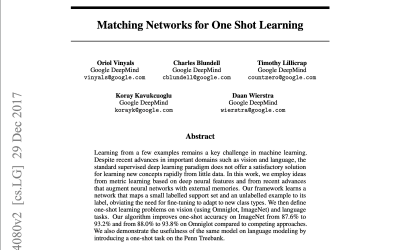

Los 5 mejores trabajos de investigación sobre el aprendizaje a pocos

El aprendizaje a partir de pocos datos ha surgido como un área crucial de investigación en el aprendizaje automático, con el objetivo de desarrollar algoritmos que puedan aprender a partir de ejemplos etiquetados limitados. Esta capacidad es esencial para muchas aplicaciones del mundo real en las que los datos son escasos, caros o requieren mucho tiempo.

¿Debería su empresa considerar Llama 3.1? - AI&YOU #66

La estadística de la semana: 72% de las organizaciones encuestadas han adoptado la IA en 2024, un salto significativo desde los alrededor de 50% de años anteriores. (McKinsey) El reciente lanzamiento de Llama 3.1 por parte de Meta ha causado conmoción en el mundo empresarial. Esta última iteración de los modelos Llama...

10 estrategias probadas para reducir los costes de su LLM - AI&YOU #65

La estadística de la semana: El uso de LLM más pequeños como GPT-J en cascada puede reducir el coste total en 80% y mejorar la precisión en 1,5% en comparación con GPT-4. (Dataiku) Las organizaciones confían cada vez más en los grandes modelos lingüísticos (LLM) para diversas aplicaciones,

¿Listo para hacer crecer su negocio con la IA? Póngase en contacto con nosotros

Llame a