4 Best Practices zur Verhinderung von OpenAI-API-Verboten und zur Sicherstellung der Compliance

Wenn Ihr Unternehmen in irgendeiner Form mit KI zu tun hat, ist die Einhaltung von Richtlinien wichtiger denn je, insbesondere wenn Sie KI-Modelle wie die von OpenAI nutzen. Was viele Unternehmen nicht wissen, ist, dass die Nichteinhaltung der OpenAI-Richtlinien durch die Nutzer dazu führen kann, dass ihr API-Zugang gesperrt wird, oft ohne Vorwarnung. Für Unternehmen, die mehrere Benutzer verwalten, ist die Einhaltung der OpenAI-Richtlinien von entscheidender Bedeutung, um einen ununterbrochenen Zugang zu diesen leistungsstarken Tools zu erhalten. Die Nichteinhaltung der Bedingungen kann zu schwerwiegenden Konsequenzen führen, einschließlich Sperren, die Ihren Geschäftsbetrieb erheblich stören könnten.

OpenAI hat eine umfassende Reihe von Richtlinien aufgestellt, um Missbrauch zu verhindern. Diese Richtlinien schützen nicht nur die Plattform, sondern gewährleisten auch die verantwortungsvolle Nutzung von KI-Technologien in allen Branchen. Unternehmen, die die APIs von OpenAI nutzen, müssen das Nutzerverhalten sorgfältig überwachen, um Verstöße zu vermeiden, die zu Strafen oder Verboten führen können. Das Verständnis und die effektive Handhabung dieser Richtlinien ist der Schlüssel zur Aufrechterhaltung des Zugangs und zur Erlangung eines Wettbewerbsvorteils im Bereich der KI.

OpenAIs API-Nutzungsrichtlinien verstehen

Die API-Nutzungsrichtlinien von OpenAI wurden entwickelt, um die ethische und angemessene Nutzung von KI zu gewährleisten. Der Missbrauch dieser APIs, insbesondere durch nutzergenerierte Inhalte, kann schnell zu Kontosperrungen oder -sperrungen führen. Das Fehlverhalten von Nutzern, wie das Einreichen unangemessener oder schädlicher Inhalte, verstößt nicht nur gegen die Bedingungen von OpenAI, sondern gefährdet auch ganze Konten.

OpenAI überwacht aktiv die Nutzungsmuster und bewertet versteckte Aktionen, die gegen die Richtlinien verstoßen könnten. So können zum Beispiel die Einreichung unangemessener Inhalte oder Versuche, Inhaltsfilter zu umgehen, zu erheblichen Konsequenzen führen. OpenAI verbirgt spezifische Details darüber, wie es Anfragen bewertet, und hält seine Moderationsprozesse so streng unter Verschluss, um sicherzustellen, dass die Richtlinien ohne Kompromisse eingehalten werden. Auf diese Weise stellt OpenAI sicher, dass seine Modelle in einer Weise verwendet werden, die mit seinen ethischen Standards übereinstimmt.

Um diese Probleme zu vermeiden, ist es für Entwickler und Unternehmen wichtig, die OpenAI-Richtlinien proaktiv durchzusetzen und integrierte Tools wie das Moderationsendpunktdie dabei helfen können, potenziell schädliche Inhalte herauszufiltern, bevor sie die API erreichen. Wenn Unternehmen die wichtigsten Aspekte des Missbrauchs verstehen und wissen, wie OpenAI Verstöße aufspürt, können sie Risiken effektiver verwalten.

Herausforderungen bei Multi-User-Anwendungen

Für Unternehmen, die Anwendungen mit mehreren Benutzern verwalten, sind die mit API-Missbrauch verbundenen Risiken deutlich höher. Jeder Benutzer kann versehentlich oder absichtlich gegen die OpenAI-Richtlinien verstoßen, was zu Konsequenzen führt, die das gesamte Unternehmen betreffen. Aus diesem Grund ist es für Entwickler unerlässlich, die besonderen Herausforderungen zu verstehen, die sich in Umgebungen mit mehreren Benutzern ergeben.

Die Verwaltung mehrerer Benutzer bringt besondere Herausforderungen mit sich, z. B. ein unterschiedliches Verständnis der akzeptablen Nutzung, eine uneinheitliche Einhaltung der Richtlinien und das Potenzial für böswilliges Verhalten einer kleinen Untergruppe von Benutzern. Jede Benutzerinteraktion muss sorgfältig überwacht werden, da ein einziger Verstoß den gesamten API-Zugang für eine Organisation gefährden kann. Darüber hinaus ist es bei der Skalierung einer Plattform mit mehreren Benutzern schwierig sicherzustellen, dass alle Benutzer die Richtlinien einhalten, ohne das System mit manuellen Überprüfungen zu überfordern.

Im Gegensatz zu früheren KI-Modellen, die möglicherweise weniger streng waren, ist das neueste KI-Modell von OpenAI mit strengeren Compliance-Richtlinien verbunden, die genau überwacht werden. Unternehmen müssen die Verantwortung für die Überwachung nutzergenerierter Inhalte übernehmen, um Verstöße zu verhindern, und dazu gehört die Implementierung automatischer Inhaltsfilter und Compliance-Prüfungen. Proaktive Maßnahmen wie die Integration des OpenAI-Moderationsendpunkts, die Festlegung klarer Nutzungsrichtlinien für die Endnutzer und die Bereitstellung von Bildungsressourcen für die Nutzer über akzeptable Inhalte können dazu beitragen, diese Risiken zu mindern und die weitere Verfügbarkeit der API zu gewährleisten.

Durch eine effektive Verwaltung des individuellen Nutzerverhaltens und die Implementierung robuster Überwachungstools können Unternehmen vermeiden, für die Handlungen einiger weniger schlechter Akteure bestraft zu werden. Investitionen in Benutzerverwaltungsprozesse und -tools helfen nicht nur bei der Einhaltung von Vorschriften, sondern schaffen auch eine vertrauenswürdigere Umgebung für alle Benutzer und unterstützen so letztlich die langfristigen Ziele des Unternehmens mit der KI-Integration.

Best Practices zur Verhinderung von OpenAI-API-Sperren

Um Verbote zu verhindern und sicherzustellen, dass Ihre API-Nutzung konform bleibt, ist es entscheidend, bestimmte bewährte Verfahren anzuwenden. Hier sind einige Strategien, die Entwickler und Unternehmen befolgen können:

Verwenden Sie den Moderationsendpunkt: OpenAI bietet einen kostenlosen Moderationsendpunkt, der dabei hilft, schädliche Inhalte zu identifizieren, bevor sie die API erreichen. Dieses Tool ist wichtig, um unangemessene Inhalte zu filtern und das Risiko von Strafen zu verringern.

Ratenbegrenzungen und eindeutige Benutzerkennungen: Die Implementierung von Ratenbeschränkungen und die Zuweisung eindeutiger Benutzerkennungen zu jeder API-Anfrage können helfen, das Benutzerverhalten zu verwalten und zu verfolgen. Durch die Kontrolle des Anfragevolumens und die Verknüpfung mit einzelnen Nutzern wird es einfacher, problematische Konten zu identifizieren und einzuschränken.

Überwachung und Protokollierung in Echtzeit: Richten Sie Echtzeit-Überwachungssysteme ein, um die API-Nutzung zu verfolgen. Die Protokollierung jeder Anfrage ermöglicht es Entwicklern, das Nutzerverhalten zu überprüfen und Anomalien frühzeitig zu erkennen.

Überprüfung der Eingaben: Stellen Sie sicher, dass alle Eingaben validiert werden, um zu verhindern, dass schädliche oder unangemessene Daten von der API verarbeitet werden. Eine ordnungsgemäße Eingabevalidierung kann Risiken mindern und die Compliance verbessern.

Diese Praktiken minimieren nicht nur das Risiko von Verstößen, sondern verschaffen Unternehmen auch einen Wettbewerbsvorteil, da sie ihr Engagement für eine verantwortungsvolle Nutzung von KI demonstrieren. Die Einführung eines strukturierten Ansatzes für die Einhaltung von Vorschriften, einschließlich der Nutzung der in OpenAI integrierten Tools, kann letztlich zu einer zuverlässigeren und effektiveren Nutzung von KI-Modellen führen.

OpenAIs Moderationsendpunkt verstehen

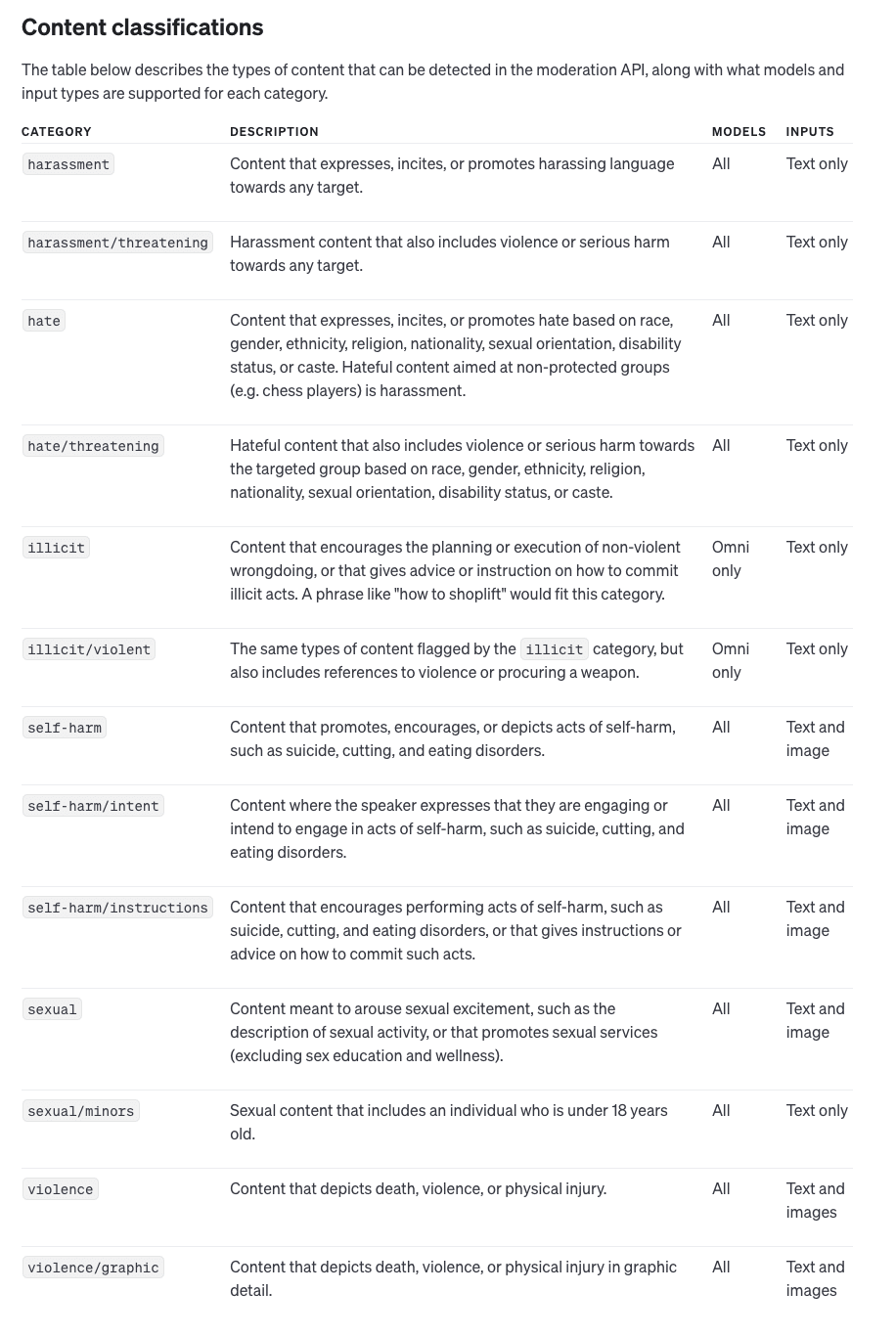

Der von OpenAI bereitgestellte Moderations-Endpunkt ist ein wichtiges Instrument, das sicherstellt, dass schädliche Inhalte nicht durch das System gelangen, und so dazu beiträgt, die Einhaltung der Vorschriften zu gewährleisten und Verbote zu verhindern. Der Endpunkt kann sowohl Text- als auch Bildeingaben analysieren und potenziell schädliche Kategorien wie Gewalt, Hassreden und mehr identifizieren.

Der OpenAI-Moderationsendpunkt bietet die folgenden Funktionen:

Omni-Moderationsmodell: Dies ist die neueste Version und unterstützt mehrere Kategorisierungsoptionen und multimodal Eingaben, so dass sie sowohl für Text als auch für Bilder geeignet ist.

Legacy-Text-Moderation: Ältere Modelle, die nur Texteingaben unterstützen, verfügen über weniger Kategorisierungsmöglichkeiten. Für neue Anwendungen wird jedoch das Omni-Moderationsmodell empfohlen.

Bei der Verwendung des Moderationsendpunkts werden Eingabedaten an die API von OpenAI übergeben, die dann eine detaillierte Antwort liefert. Diese Antwort umfasst:

Markierter Inhalt: Der Endpunkt setzt ein Flag auf "wahr", wenn die Eingabe schädliche oder unangemessene Inhalte enthält.

Kategorie Punktzahlen: Ein detailliertes Punktesystem, das den Vertrauensgrad des Modells bei der Einstufung von potenziell schädlichen Inhalten angibt.

Kategorie-spezifische Daten: Der Endpunkt gibt an, welche Art von Eingabe (z. B. Text oder Bild) die Kategorisierung ausgelöst hat, was eine genauere Moderation ermöglicht.

Durch die Implementierung des Moderationsendpunkts können Unternehmen proaktiv handeln und markierte Inhalte herausfiltern, bevor sie die Haupt-API von OpenAI erreichen. Dies schützt nicht nur die Integrität des KI-Modells, sondern minimiert auch das Risiko von Richtlinienverstößen, die zu einer API-Sperre führen könnten.

Sicherstellung von Compliance und Wettbewerbsvorteilen

Bei der Einhaltung der Richtlinien geht es nicht nur darum, Strafen zu vermeiden; sie kann auch als Wettbewerbsvorteil in der KI-Branche dienen. Unternehmen, die sich strikt an die OpenAI-Leitlinien halten, müssen seltener mit Unterbrechungen rechnen und können ihren Nutzern konsistente und zuverlässige Dienste anbieten.

Darüber hinaus bedeutet eine proaktive Einhaltung der Richtlinien, dass Unternehmen das volle Potenzial der KI-Modelle von OpenAI ausschöpfen können. Indem sie die Hintergründe der OpenAI-Richtlinien verstehen und Best Practices umsetzen, positionieren sich Unternehmen als verantwortungsbewusste Marktführer im Bereich der KI. Die Einhaltung der Richtlinien trägt dazu bei, Vertrauen zu schaffen, sowohl bei den Nutzern als auch bei den Partnern in der Branche, und ermöglicht es den Unternehmen, sich von Mitbewerbern zu unterscheiden, die möglicherweise nicht so sorgfältig vorgehen.

Die Quintessenz

Eine verantwortungsvolle API-Nutzung ist entscheidend für die Aufrechterhaltung des Zugangs zu den leistungsstarken Tools von OpenAI. Die Nichteinhaltung der OpenAI-Richtlinien kann zu schwerwiegenden Konsequenzen führen, einschließlich API-Sperren, die Ihren Geschäftsbetrieb erheblich stören können. Entwickler und Unternehmen müssen bei der Verwaltung des Nutzerverhaltens proaktiv vorgehen, Moderationsstrategien implementieren und sich an bewährte Verfahren halten, um Verstöße zu vermeiden.

Letztendlich verhindert die Befolgung der OpenAI-Richtlinien nicht nur Störungen, sondern positioniert Unternehmen auch als Vorreiter bei der ethischen Nutzung von KI. Indem sie ihr Engagement für die Einhaltung der Richtlinien demonstrieren, können Unternehmen ihren API-Zugang sichern, ihren Wettbewerbsvorteil verbessern und einen positiven Beitrag zur sich entwickelnden KI-Branche leisten.