L'exode des cerveaux de l'OpenAI : une occasion en or pour les sociétés de capital-risque à la recherche des prochaines licornes de l'IA

Dans le monde de l'intelligence artificielle, où les enjeux sont considérables, le talent est la monnaie d'échange par excellence. Le récent exode d'OpenAI n'est pas seulement une redistribution des cartes, c'est aussi une mine d'or potentielle pour les investisseurs en capital-risque avisés. Alors que nous assistons à l'une des plus importantes migrations de talents de l'histoire récente de la technologie, la question n'est pas seulement de savoir qui part, mais aussi où ils vont et ce qu'ils construiront ensuite.

OpenAI, qui était autrefois le leader incontesté de la recherche de pointe en matière d'IA, est en train de vivre un changement sismique. Il ne s'agit pas d'une simple rotation d'employés, mais d'un départ massif de certains des esprits les plus brillants de l'IA. Pour les sociétés de capital-risque, il s'agit d'une occasion rare d'entrer dans ce qui pourrait être la prochaine génération de licornes de l'IA.

Les implications de cet exode vont bien au-delà de l'OpenAI elle-même. En se dispersant dans le secteur, ces esprits brillants emportent avec eux non seulement des connaissances et de l'expertise, mais aussi le potentiel de susciter des innovations et des entreprises entièrement nouvelles. Pour les sociétés de capital-risque, il est essentiel de comprendre cette migration pour identifier les prochaines grandes opportunités dans le domaine de l'IA.

Le Grand Cash-Out : Suivre la trace de l'argent

Cet exode des talents s'explique en grande partie par le fait que l'entreprise OpenAI est devenue un acteur majeur du marché de l'emploi en Europe. revirement de politique sur les ventes secondaires d'actions.

Voici ce que les sociétés de capital-risque doivent savoir :

OpenAI a levé les restrictions sur les ventes d'actions, permettant aux employés actuels et anciens de participer à parts égales aux offres d'achat annuelles.

Le plafond de vente pour tous les vendeurs, y compris les anciens employés, a été uniformisé, ce qui élimine les disparités antérieures.

Les clauses de non-dénigrement ont été supprimées des contrats de travail pour les employés ayant acquis des droits, ce qui pourrait permettre d'obtenir des informations plus franches sur le fonctionnement interne d'OpenAI.

Pour les sociétés de capital-risque, ces changements créent une tempête parfaite d'opportunités. De nombreux ex-employés d'OpenAI disposent désormais d'importantes liquidités, ce qui leur donne les moyens de lancer de nouvelles entreprises. La suppression des clauses de non-dénigrement signifie que ces personnes peuvent parler plus librement de leurs expériences et de leurs idées, ce qui peut conduire à des startups plus transparentes et plus innovantes.

Mais pourquoi le suivi de ces encaissements est-il si crucial pour les sociétés de capital-risque ? Tout d'abord, il indique quels employés ont la liberté financière de prendre des risques dans de nouvelles entreprises. Il ne s'agit pas seulement de fondateurs potentiels, mais de fondateurs qui ont les moyens d'autofinancer les premières étapes de leur développement, ce qui peut les amener à présenter des projets plus aboutis lorsqu'ils cherchent à obtenir un financement de capital-risque.

Deuxièmement, le calendrier des départs peut fournir des informations précieuses. Un groupe d'employés de haut niveau qui se retirent simultanément peut signaler des changements technologiques à venir ou des changements d'orientation de l'entreprise qui pourraient influencer les stratégies d'investissement.

Enfin, ces salariés licenciés constituent un réseau précieux. Même s'ils ne fondent pas eux-mêmes des entreprises, ils sont susceptibles de devenir des investisseurs providentiels ou des conseillers pour les nouvelles entreprises d'IA. En nouant des relations avec eux dès maintenant, les sociétés de capital-risque pourraient avoir un accès précoce à des opérations prometteuses à l'avenir.

En suivant de près ces mouvements financiers et ces changements de politique, les sociétés de capital-risque peuvent se positionner pour tirer parti de la prochaine vague d'innovation en matière d'IA, en identifiant potentiellement les fondateurs et les idées qui façonneront l'avenir du secteur.

Suivre les talents : Où vont-ils ?

L'exode de l'OpenAI n'est pas seulement dû au départ de certains individus, mais aussi à leur destination et à ce qu'ils sont en train de construire. Il est essentiel de comprendre ces mouvements pour les sociétés de capital-risque qui cherchent à garder une longueur d'avance en matière d'investissements dans l'IA.

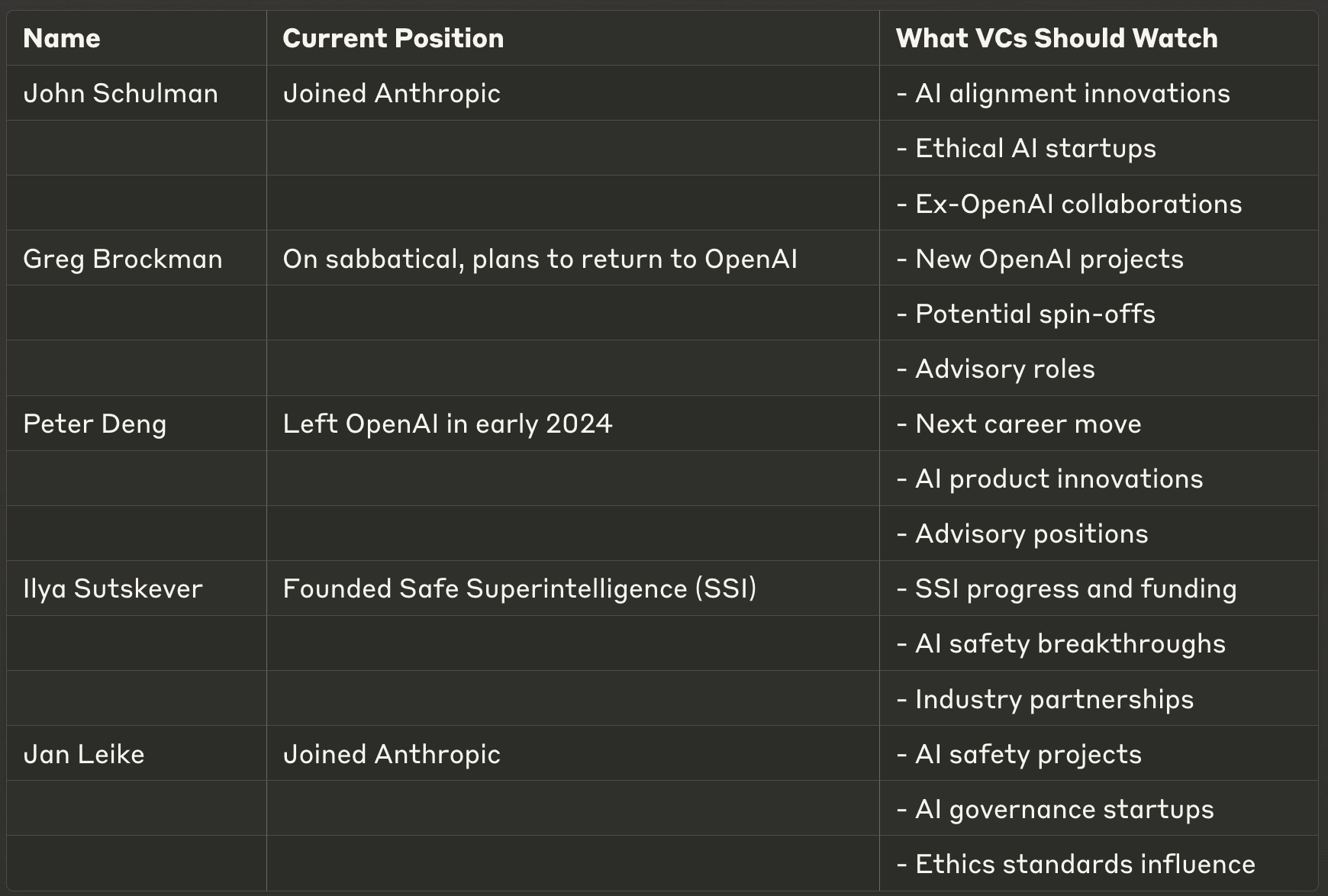

John Schulman, cofondateur d'OpenAI, a fait parler de lui en rejoignant Anthropic. L'accent qu'il met sur l'alignement et la sécurité de l'IA témoigne de l'importance croissante accordée au développement éthique de l'IA, un marché potentiellement énorme dans les années à venir. Les sociétés de capital-risque devraient en prendre note : l'arrivée de John Schulman suggère que la sécurité de l'IA n'est pas seulement une préoccupation académique, mais une opportunité commerciale viable.

Ilya Sutskever, ancien scientifique en chef d'OpenAI, a pris une mesure encore plus audacieuse en fondant Superintelligence sûre (SSI). Sa nouvelle entreprise, axée sur le développement de technologies d'IA sûres, pourrait être à l'avant-garde d'un créneau critique dans le développement de l'IA. Pour les sociétés de capital-risque, SSI représente non seulement une opportunité d'investissement potentielle, mais aussi un indicateur de l'orientation de la recherche en matière d'IA.

Jan Leike, qui a dirigé l'équipe d'alignement d'OpenAI, a également rejoint Anthropic. Son expertise en matière de sécurité et d'alignement de l'IA pourrait déboucher sur des protocoles de sécurité révolutionnaires, qui deviennent de plus en plus cruciaux à mesure que les systèmes d'IA deviennent plus puissants et omniprésents.

Ces mouvements mettent en évidence une tendance claire : de nombreux cerveaux de l'OpenAI gravitent autour d'entreprises et de projets axés sur la sécurité et l'éthique de l'IA. Ce changement nous aide à comprendre la direction que prend le domaine de l'IA. Les sociétés de capital-risque qui reconnaissent cette tendance et y investissent rapidement pourraient se retrouver à soutenir les entreprises qui définiront la prochaine ère du développement de l'IA.

En outre, ces mouvements très médiatisés ne sont probablement que la partie émergée de l'iceberg. Pour chaque départ très médiatisé, il y a probablement de nombreuses autres personnes talentueuses qui se déplacent sans que l'on s'en aperçoive. Les sociétés de capital-risque qui peuvent suivre cette migration des talents et s'y intéresser peuvent découvrir des opportunités d'investissement avant qu'elles ne soient connues de tous dans le secteur.

Le phénomène de la "mafia de l'OpenAI

Le monde de la technologie a déjà connu ce phénomène : un groupe de personnes talentueuses issues d'une même entreprise se dispersent pour avoir un impact considérable sur le secteur. L'exemple le plus célèbre est celui de la "PayPal Mafia", un terme qui désigne le groupe d'anciens employés et fondateurs de PayPal qui ont ensuite créé et investi dans de nombreuses entreprises technologiques prospères.

Pour comprendre le potentiel d'une "OpenAI Mafia", regardons ce que la PayPal Mafia a réalisé :

Elon Musk a fondé SpaceX et Tesla

Peter Thiel a cofondé Palantir et est devenu un important investisseur en capital-risque.

Reid Hoffman a fondé LinkedIn et est devenu partenaire de Greylock.

Steve Chen, Chad Hurley et Jawed Karim fondent YouTube

Jeremy Stoppelman et Russel Simmons ont fondé Yelp

David Sacks a fondé Yammer

Ces personnes ont non seulement créé des entreprises d'un milliard de dollars, mais sont également devenues des investisseurs et des conseillers influents dans la Silicon Valley. Leur expérience commune chez PayPal a créé un puissant réseau qui a continué à collaborer, à investir dans les entreprises des uns et des autres et à façonner le secteur technologique pour les années à venir.

Nous assistons peut-être à la naissance d'un phénomène similaire avec la "mafia de l'OpenAI". Les anciens élèves de l'OpenAI se dispersent dans le paysage de l'IA et ne se contentent pas de rejoindre des entreprises existantes, ils en fondent de nouvelles, deviennent des investisseurs providentiels et déterminent l'orientation de la recherche et du développement dans le domaine de l'IA.

Pour les sociétés de capital-risque, il s'agit d'une opportunité unique. En exploitant ce réseau à un stade précoce, vous pouvez accéder à un pipeline de startups et de fondateurs à fort potentiel. La "OpenAI Mafia" est le potentiel collectif d'un groupe qui a été à l'avant-garde du développement de l'IA.

Ces initiatives ne sont probablement qu'un début. À l'instar de la mafia PayPal, nous pourrions voir ces personnes créer plusieurs entreprises dans les années à venir, investir dans les projets des uns et des autres et continuer à collaborer de diverses manières.

Rappelez-vous que l'impact de la mafia PayPal n'a pas été immédiatement visible - il s'est déroulé sur plusieurs années. Il pourrait en être de même pour les anciens de l'OpenAI. En investissant aujourd'hui dans ce réseau, vous ne pariez pas seulement sur des startups individuelles, mais sur un groupe de personnes qui ont le potentiel de façonner l'avenir de l'IA pour les années à venir.

Identifier les prochaines licornes de l'IA

En suivant les mouvements des anciens élèves de l'OpenAI, soyez attentifs aux problèmes qu'ils choisissent de résoudre et aux approches qu'ils adoptent. Ces choix peuvent fournir des indications précieuses sur la direction que prend le domaine.

Recherchez des fondateurs qui ne sont pas seulement brillants sur le plan technique, mais qui ont aussi une vision claire de la manière dont leur technologie peut être appliquée à des problèmes concrets. Les entreprises d'IA les plus prospères seront probablement celles qui sauront combler le fossé entre la recherche de pointe et les applications pratiques.

Gardez également un œil sur les startups qui s'attaquent aux défis du développement de l'IA elle-même - des outils pour une meilleure formation, des modèles plus efficaces ou des mesures de sécurité améliorées. L'IA devenant de plus en plus omniprésente, les jeux de pioches dans ce domaine pourraient s'avérer tout aussi précieux que les applications de l'IA qui font les gros titres.

La vision à long terme : Remodeler l'écosystème de l'IA

L'exode de l'OpenAI aura des effets durables sur l'écosystème de l'IA. Comme ces personnes se répartissent entre différentes entreprises et startups, nous pourrions assister à un modèle d'innovation en matière d'IA plus distribué, plutôt qu'à une concentration des progrès dans quelques grands laboratoires.

Cela pourrait conduire à un écosystème de l'IA plus robuste et plus diversifié, avec l'émergence de multiples centres d'excellence. Pour les sociétés de capital-risque, cela signifie qu'il faut élargir son réseau et potentiellement regarder au-delà des centres technologiques traditionnels pour trouver la prochaine grande innovation en matière d'IA.

En outre, l'accent mis sur la sécurité et l'éthique de l'IA par de nombreux anciens de l'OpenAI dans leurs nouvelles entreprises pourrait façonner le paysage réglementaire de l'IA. Les sociétés de capital-risque doivent se préparer à un avenir où le développement responsable de l'IA n'est pas seulement un avantage, mais un facteur essentiel de la réussite et de la longévité d'une entreprise.

À long terme, l'exode de l'OpenAI sera considéré comme un moment charnière dans le développement de l'IA - le moment où le domaine a véritablement commencé à mûrir et à se diversifier. En comprenant et en tirant parti de cette évolution, les sociétés de capital-risque peuvent se positionner à l'avant-garde de la prochaine vague d'innovations et d'opportunités d'investissement dans le domaine de l'IA.