por Greggory Elias | 29 de agosto de 2024 | IA empresarial, LLMs / PNL, Ingeniería Prompt

Los grandes modelos lingüísticos (LLM) demuestran notables capacidades en el procesamiento y la generación de lenguaje natural (PLN). Sin embargo, cuando se enfrentan a tareas de razonamiento complejas, estos modelos pueden tener dificultades para producir resultados precisos y fiables. Aquí es donde entra en juego la inducción de la cadena de pensamiento (CoT).

por Greggory Elias | 29 de agosto de 2024 | IA Generativa, LLMs / PNL, Ingeniería Prompt

Las instrucciones de cadena de pensamiento (CoT) han sido consideradas un gran avance en el desarrollo de las capacidades de razonamiento de los grandes modelos lingüísticos (LLM). Esta técnica, que consiste en proporcionar ejemplos de razonamiento paso a paso para guiar a los LLM, ha suscitado una gran atención en la comunidad de la IA. Muchos sitios web

por Greggory Elias | 29 de agosto de 2024 | IA empresarial, IA Generativa, Ingeniería Prompt

El arte de elaborar instrucciones eficaces para modelos lingüísticos extensos (LLM) se ha convertido en una habilidad crucial para los profesionales de la IA. Unas instrucciones bien diseñadas pueden mejorar significativamente el rendimiento de un LLM, permitiendo resultados más precisos, relevantes y creativos. Esta entrada de blog explora diez de

por Greggory Elias | 19 de agosto de 2024 | IA empresarial, IA Generativa, Integración LLM

En IA, la capacidad de aprender eficazmente a partir de datos limitados se ha vuelto crucial. El aprendizaje de pocos disparos es un método que está mejorando la forma en que los modelos de IA adquieren conocimientos y se adaptan a nuevas tareas. Pero, ¿qué es exactamente el aprendizaje de pocos disparos? Definición del aprendizaje de pocos...

por Greggory Elias | 19 de agosto de 2024 | IA empresarial, IA Generativa, LLMs / PNL

El verdadero potencial de los grandes modelos lingüísticos (LLM) reside no sólo en su amplia base de conocimientos, sino en su capacidad para adaptarse a tareas y dominios específicos con un entrenamiento adicional mínimo. Aquí es donde entran en juego los conceptos de estímulo de pocos...

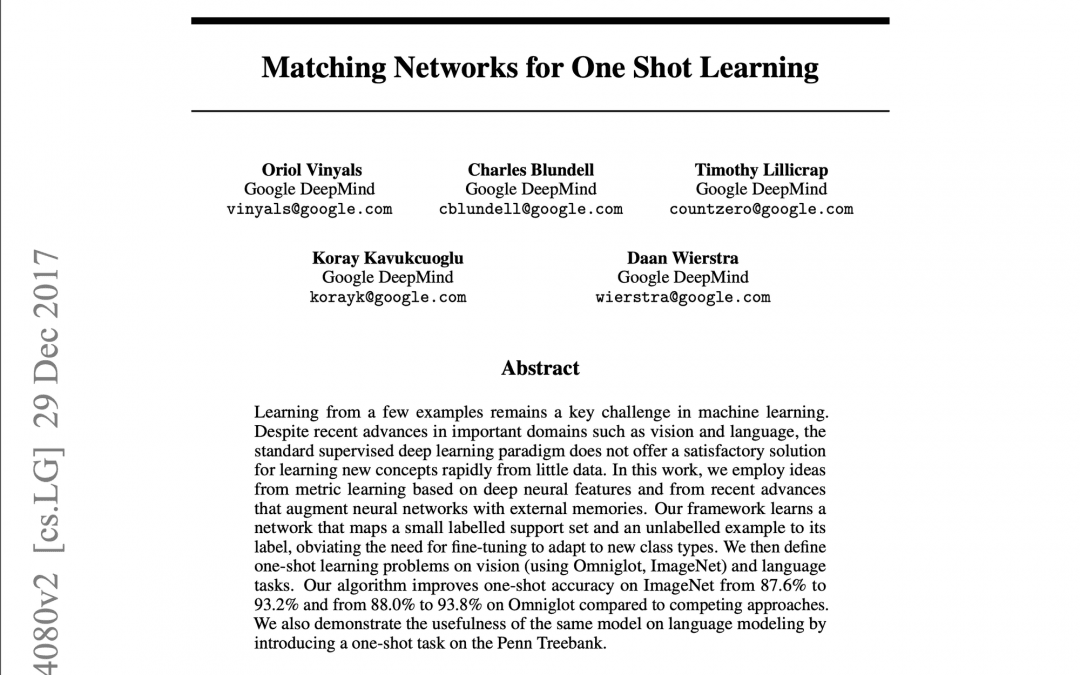

por Greggory Elias | 19 de agosto de 2024 | IA Generativa, LLMs / PNL, Investigación / Estadísticas

El aprendizaje a partir de pocos datos ha surgido como un área crucial de investigación en el aprendizaje automático, con el objetivo de desarrollar algoritmos que puedan aprender a partir de ejemplos etiquetados limitados. Esta capacidad es esencial para muchas aplicaciones del mundo real en las que los datos son escasos, caros o requieren mucho tiempo.

por Greggory Elias | 19 de agosto de 2024 | IA Generativa, LLMs / PNL, Boletín

La estadística de la semana: 72% de las organizaciones encuestadas han adoptado la IA en 2024, un salto significativo desde los alrededor de 50% de años anteriores. (McKinsey) El reciente lanzamiento de Llama 3.1 por parte de Meta ha causado conmoción en el mundo empresarial. Esta última iteración de los modelos Llama...

por Greggory Elias | 19 de agosto de 2024 | IA empresarial, IA Generativa, Integración LLM

La estadística de la semana: El uso de LLM más pequeños como GPT-J en cascada puede reducir el coste total en 80% y mejorar la precisión en 1,5% en comparación con GPT-4. (Dataiku) Las organizaciones confían cada vez más en los grandes modelos lingüísticos (LLM) para diversas aplicaciones,

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, IA Generativa, LLMs / PNL

A medida que las organizaciones confían cada vez más en los grandes modelos lingüísticos (LLM) para diversas aplicaciones, desde los chatbots de atención al cliente hasta la generación de contenidos, el reto de la gestión de costes de los LLM ha pasado a primer plano. Los costes operativos asociados al despliegue y...

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, Integración LLM

Para las estrategias empresariales de IA, comprender las estructuras de precios de los grandes modelos lingüísticos (LLM) es crucial para una gestión eficaz de los costes. Los costes operativos asociados a los LLM pueden aumentar rápidamente sin una supervisión adecuada, lo que puede dar lugar a picos de costes inesperados que pueden hacer descarrilar los presupuestos.

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, IA Generativa, LLMs / PNL

Meta acaba de anunciar Llama 3.1, su modelo de grandes lenguajes (LLM) de código abierto más avanzado hasta la fecha. Este lanzamiento marca un hito importante en la democratización de la tecnología de IA, ya que tiende un puente entre los modelos de código abierto y los propietarios. Llama...

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, Integración LLM, Gestión de proyectos

El reciente lanzamiento de Llama 3.1 por parte de Meta ha causado sensación en el mundo empresarial. Esta última iteración de los modelos Llama representa un salto significativo en el ámbito de los grandes modelos lingüísticos (LLM), ofreciendo una mezcla de rendimiento y accesibilidad que...

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, Integración LLM

El panorama de los grandes modelos lingüísticos (LLM) se ha convertido en un campo de batalla entre los modelos de peso abierto como Llama 3.1 de Meta y las ofertas propietarias de gigantes tecnológicos como OpenAI. A medida que las empresas navegan por este complejo terreno, la decisión entre adoptar un modelo abierto

por Greggory Elias | 4 de Ago de 2024 | IA empresarial, Integración LLM

Llama 3.1 de Meta ha surgido como una impresionante opción LLM, ofreciendo una mezcla única de rendimiento, flexibilidad y rentabilidad. Mientras las empresas navegan por el complejo mundo de la implementación de la IA, Llama 3.1 presenta...

por Greggory Elias | 3 de agosto de 2024 | Publicidad y marketing, Boletín

Estadística de la semana: En mayo de 2024, Perplexity AI recibió 67,42 millones de visitas con una duración media de sesión de 10 minutos y 51 segundos. El tráfico aumentó en 20,71% en comparación con abril. (Semrush) En marketing digital, mantenerse a la vanguardia es crucial. Como

por Greggory Elias | Ago 2, 2024 | Sin categoría

En este artículo, vamos a desglosar un importante trabajo de investigación que aborda uno de los retos más acuciantes a los que se enfrentan los grandes modelos lingüísticos (LLM): las alucinaciones. El artículo, titulado "ChainPoll: A High Efficacy Method for LLM Hallucination Detection" (Encuesta en cadena: un método de alta eficacia para la detección de alucinaciones en los LLM).

por Greggory Elias | Ago 2, 2024 | IA empresarial, IA Generativa, LLMs / PNL

Los grandes modelos lingüísticos (LLM) están transformando las aplicaciones empresariales, ofreciendo capacidades sin precedentes en el procesamiento y la generación del lenguaje natural. Sin embargo, antes de que su empresa se suba al carro de los LLM, hay un reto crítico que debe...

por Greggory Elias | Ago 2, 2024 | IA empresarial, IA Generativa, LLMs / PNL

A medida que los grandes modelos lingüísticos (LLM) siguen trastornando casi todos los campos e industrias, traen consigo un reto único: las alucinaciones. Estas imprecisiones generadas por la IA suponen un riesgo significativo para la fiabilidad de los resultados de los LLM. ¿Qué son los LLM...

Comentarios recientes