Was ist Stable Audio 2.0? + die Technik hinter dem generativen AI Text-to-Audio-Modell von Stable Diffusion

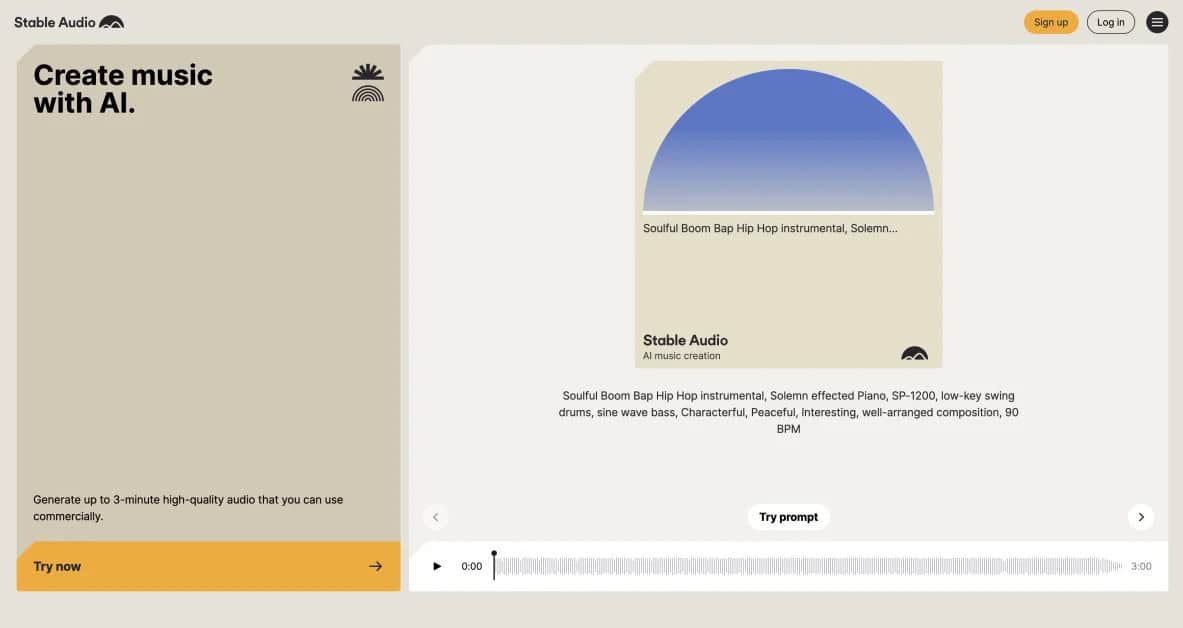

Die künstliche Intelligenz hat in verschiedenen kreativen Branchen große Fortschritte gemacht und bietet neue Werkzeuge und Techniken für die Produktion von Inhalten. Stabilität AIein Unternehmen, das für seine Arbeit im Bereich der KI-generierten Inhalte bekannt ist, hat vor kurzem die Stabiles Audio 2.0, eine aktualisierte Version ihrer KI-generierten Audioplattform. Diese neue Version verspricht eine Reihe von fortschrittlichen Funktionen für den Bereich der Audiogenerierung und könnte die Art und Weise, wie Musik, Soundeffekte und Audioinhalte erstellt werden, verändern.

Stabilität AI Stability AI hat bereits in der Vergangenheit innovative KI-gestützte Tools entwickelt, wie z. B. Stable Diffusion, das für seine Fähigkeit, qualitativ hochwertige Bilder aus Textbeschreibungen zu generieren, großen Anklang gefunden hat. Mit der Veröffentlichung von Stable Audio 2.0 möchte das Unternehmen sein Know-how auf den Audiobereich ausweiten und eine Plattform bereitstellen, die auf die Bedürfnisse von Musikern, Sounddesignern und Content-Erstellern zugeschnitten ist.

Erforschung der Möglichkeiten von Stable Audio 2.0

Stable Audio 2.0 bietet eine Reihe von Funktionen, die die Audioerzeugung und -bearbeitung verbessern:

Erweiterte Trackerzeugung: Stable Audio 2.0 kann im Vergleich zu seinen Vorgängerversionen längere, zusammenhängendere Audiospuren erzeugen. Mit dieser Funktion können Benutzer komplette Musikkompositionen mit mehreren Abschnitten erstellen, z. B. Intros, Strophen, Refrains und Outros. Die Möglichkeit, längere Tracks zu erstellen, kann für Musiker und Komponisten von Vorteil sein, die mit neuen Ideen experimentieren oder ihren Arbeitsablauf optimieren möchten.

Audio-zu-Audio-Umwandlung mit natürlichsprachlichen Ansagen: Die Plattform ermöglicht es den Nutzern, ihre eigenen Audiosamples hochzuladen und sie mit Hilfe von natürlichsprachlichen Anweisungen zu verändern. So kann ein Nutzer beispielsweise eine Klavieraufnahme eingeben und Stable Audio 2.0 anweisen, "eine Ebene mit Synth-Pads hinzuzufügen" oder "das Klavier in einen Geigenklang zu verwandeln". Diese Funktion zielt darauf ab, die Audiobearbeitung intuitiver und zugänglicher zu machen und Benutzer mit unterschiedlichen technischen Kenntnissen anzusprechen.

Produktion von Soundeffekten: Stable Audio 2.0 kann eine Vielzahl von Soundeffekten erzeugen, die von Umgebungsgeräuschen bis zu komplexen Klanglandschaften reichen. Diese Fähigkeit kann für Spieleentwickler, Filmemacher und Multimediaschöpfer nützlich sein, die hochwertige Soundeffekte für ihre Projekte benötigen. Die Plattform ermöglicht es den Benutzern, Audio-Designs zu wiederholen und Feinabstimmung die Ergebnisse an ihre spezifischen Bedürfnisse anpassen.

Stilübertragung: Die Stilübertragungsfunktion in Stable Audio 2.0 ermöglicht es den Benutzern, die Merkmale eines Referenz-Audiotracks oder -Genres auf ihre eigene Audioeingabe anzuwenden. Durch die Analyse der stilistischen Elemente der Referenz kann das Modell die Audiodaten des Benutzers so umwandeln, dass sie dem gewünschten Stil entsprechen. Diese Funktion kann für Autoren von Inhalten hilfreich sein, die projektübergreifend für Konsistenz sorgen oder mit verschiedenen Musikgenres experimentieren möchten.

Stable Audio 2.0 zielt darauf ab, eine umfassende und benutzerfreundliche Plattform für die Audioerzeugung und -bearbeitung zu bieten. Die Kombination aus erweiterter Trackerzeugung, Audio-zu-Audio-Transformation, Soundeffekt-Produktion und Style-Transfer-Funktionen macht es zu einem potenziell wertvollen Werkzeug für Profis und Enthusiasten in der Audioindustrie.

Die Technologie hinter Stable Audio 2.0

Stable Audio 2.0 stützt sich auf fortschrittliche KI-Technologien, die die Audioerzeugung und -bearbeitung ermöglichen. Den Kern der Plattform bildet eine latente Diffusionsmodellarchitektur, die aus zwei Hauptkomponenten besteht: einem hochkomprimierten Autoencoder und einem Diffusionstransformator.

Der Autoencoder ist für die Komprimierung der rohen Audiowellenformen in eine kompakte, latente Darstellung verantwortlich. Dieser Komprimierungsprozess ermöglicht es dem Modell, die wesentlichen Merkmale des Audios zu erfassen und gleichzeitig die Rechenanforderungen zu reduzieren. Die komprimierte Darstellung dient als Grundlage für die nachfolgenden Aufgaben der Audioerzeugung und -bearbeitung.

Der Diffusionstransformator, eine Schlüsselkomponente von Stable Audio 2.0, wurde entwickelt, um die zeitlichen Aspekte von Audiodaten zu verarbeiten. Er nimmt die komprimierte latente Repräsentation und generiert neue Audio-Samples auf der Grundlage der bereitgestellten Prompts oder Transformationen. Die Architektur des Diffusionstransformators ermöglicht es dem Modell, weitreichende Abhängigkeiten zu erfassen und die Kohärenz der generierten Audiodaten zu erhalten.

Stable Audio 2.0 zielt darauf ab, ein Gleichgewicht zwischen Berechnungseffizienz und Ausgabequalität herzustellen. Die Kombination des komprimierten Autoencoders und des Diffusionstransformators ermöglicht es der Plattform, qualitativ hochwertiges Audio zu erzeugen und dabei die Rechenanforderungen überschaubar zu halten. Dieses Gleichgewicht ist entscheidend dafür, dass die Plattform für eine Vielzahl von Benutzern mit unterschiedlichen Rechenressourcen zugänglich ist.

Im Vergleich zu seinem Vorgänger und anderen KI-generierten Audioplattformen bietet Stable Audio 2.0 mehrere technologische Neuerungen. Die verbesserte Architektur des latenten Diffusionsmodells und die Integration des Diffusionstransformators tragen zur Fähigkeit der Plattform bei, längere, kohärentere Audiospuren zu erzeugen. Außerdem ermöglichen die effizienten Komprimierungstechniken der Plattform eine schnellere Verarbeitung und Manipulation von Audiodaten.

Ermächtigung der Schöpfer unter Wahrung ihrer Rechte

Stabilität AI Stability AI weiß, wie wichtig es ist, lizenzierte Datensätze für die Entwicklung von KI-Modellen zu verwenden. Stable Audio 2.0 wird auf einem sorgfältig kuratierten Datensatz trainiert, der eine breite Palette von Audio-Samples wie Musik, Soundeffekte und Instrumentenaufnahmen enthält. Das Unternehmen hat sich bemüht, sicherzustellen, dass der Datensatz aus lizenzierten und zulässigen Quellen stammt und die geistigen Eigentumsrechte der ursprünglichen Urheber respektiert werden.

Um die Rechte der Urheber weiter zu stärken und zu schützen, bietet Stable Audio 2.0 einen Opt-out-Mechanismus für Künstler, deren Werke in den Trainingsdatensatz aufgenommen wurden. Dies ermöglicht den Urhebern die Kontrolle über ihren Beitrag zum Modell und stellt sicher, dass ihre Werke nur mit ihrer Zustimmung verwendet werden. Stability AI ist bestrebt, offene Kommunikationskanäle mit den Künstlern zu unterhalten und auf alle Bedenken einzugehen, die sie hinsichtlich der Verwendung ihrer Werke haben.

Zusätzlich zum Opt-Out-Mechanismus hat Stability AI Maßnahmen ergriffen, um eine faire Entschädigung für Urheber sicherzustellen, deren Arbeit zur Entwicklung von Stable Audio 2.0 beiträgt. Das Unternehmen erkennt den Wert der Arbeit der Urheber an und ist bestrebt, ein faires und transparentes Vergütungssystem zu schaffen. Dies kann Tantiemen, Lizenzvereinbarungen oder andere Formen der Entschädigung umfassen, je nach dem spezifischen Anwendungsfall und den Präferenzen der Urheber.

Um Urheberrechtsverletzungen zu verhindern und die Rechte der Eigentümer von Inhalten zu schützen, enthält Stable Audio 2.0 Technologien zur Inhaltserkennung. Diese Technologien helfen bei der Identifizierung und Kennzeichnung von urheberrechtlich geschütztem Material, das auf die Plattform hochgeladen wird, und verhindern so die unbefugte Nutzung und Verbreitung. Stability AI arbeitet mit führenden Anbietern von Inhaltserkennungstechnologien zusammen, um die Wirksamkeit und Zuverlässigkeit dieser Maßnahmen zu gewährleisten.

Stability AI versucht, sich einen Platz in der Zukunft von AI Audio zu sichern

Die Einführung von Stable Audio 2.0 hat das Potenzial, die Art und Weise, wie Audioinhalte erstellt und produziert werden, zu verändern. Durch die Nutzung der KI bietet die Plattform neue Möglichkeiten für Musiker, Sounddesigner und Content-Ersteller und erlaubt ihnen, neue kreative Wege zu beschreiten.

Eine der wichtigsten Auswirkungen von Stable Audio 2.0 ist das Potenzial, Musikproduktion und Sounddesign-Workflows zu rationalisieren und zu beschleunigen. Mit der Möglichkeit, erweiterte musikalische Kompositionen zu generieren und Audiosamples mit Hilfe von natürlichsprachlichen Eingabeaufforderungen zu manipulieren, können Kreative schnell auf Ideen zurückgreifen und mit verschiedenen Sounds und Stilen experimentieren. Dies kann zu schnelleren und effizienteren Produktionsprozessen führen, die es den Künstlern ermöglichen, sich mehr auf ihre kreative Vision und weniger auf technische Zwänge zu konzentrieren.

Darüber hinaus eröffnet Stable Audio 2.0 neue Möglichkeiten für die Erstellung von Inhalten in verschiedenen Branchen. Filmemacher, Spieleentwickler und Multimediaproduzenten können die Funktionen der Plattform zur Erzeugung von Soundeffekten nutzen, um das Audioerlebnis ihrer Projekte zu verbessern. Durch die Generierung von realistischen Soundeffekten können sie ihren visuellen Inhalten mehr Tiefe und Dimension verleihen und so für ihr Publikum fesselndere und einprägsamere Erlebnisse schaffen.

Die Style-Transfer-Funktionen von Stable Audio 2.0 bieten auch interessante Möglichkeiten für die Audioanpassung. Ersteller von Inhalten können Audiostile problemlos an die Ästhetik und den Ton ihrer Projekte anpassen und so ein kohärentes und konsistentes audiovisuelles Erlebnis gewährleisten. Diese Funktion ist besonders wertvoll für Branding- und Werbezwecke, bei denen die Beibehaltung einer bestimmten Klangidentität über verschiedene Medien hinweg entscheidend ist.

Da die KI immer weiter voranschreitet, haben Plattformen wie Stable Audio 2.0 das Potenzial, die Zusammenarbeit zwischen KI und menschlicher Kreativität zu fördern. Anstatt menschliche Künstler zu ersetzen, kann KI als leistungsstarkes Werkzeug dienen, das ihren kreativen Prozess ergänzt und verbessert. Durch die Zusammenarbeit mit KI können Kreative die Grenzen des Möglichen in der Audiokreation verschieben, neue Klanglandschaften entdecken und die Grenzen ihrer Vorstellungskraft ausreizen.